الأوقات الثلاثة لـAnthropic: تسريب الشيفرة، المواجهة مع الحكومة، والتسليح

العنوان الأصلي: Anthropic: The Leak, The War, The Weapon

المؤلف الأصلي: BuBBliK

الترجمة: Peggy,BlockBeats

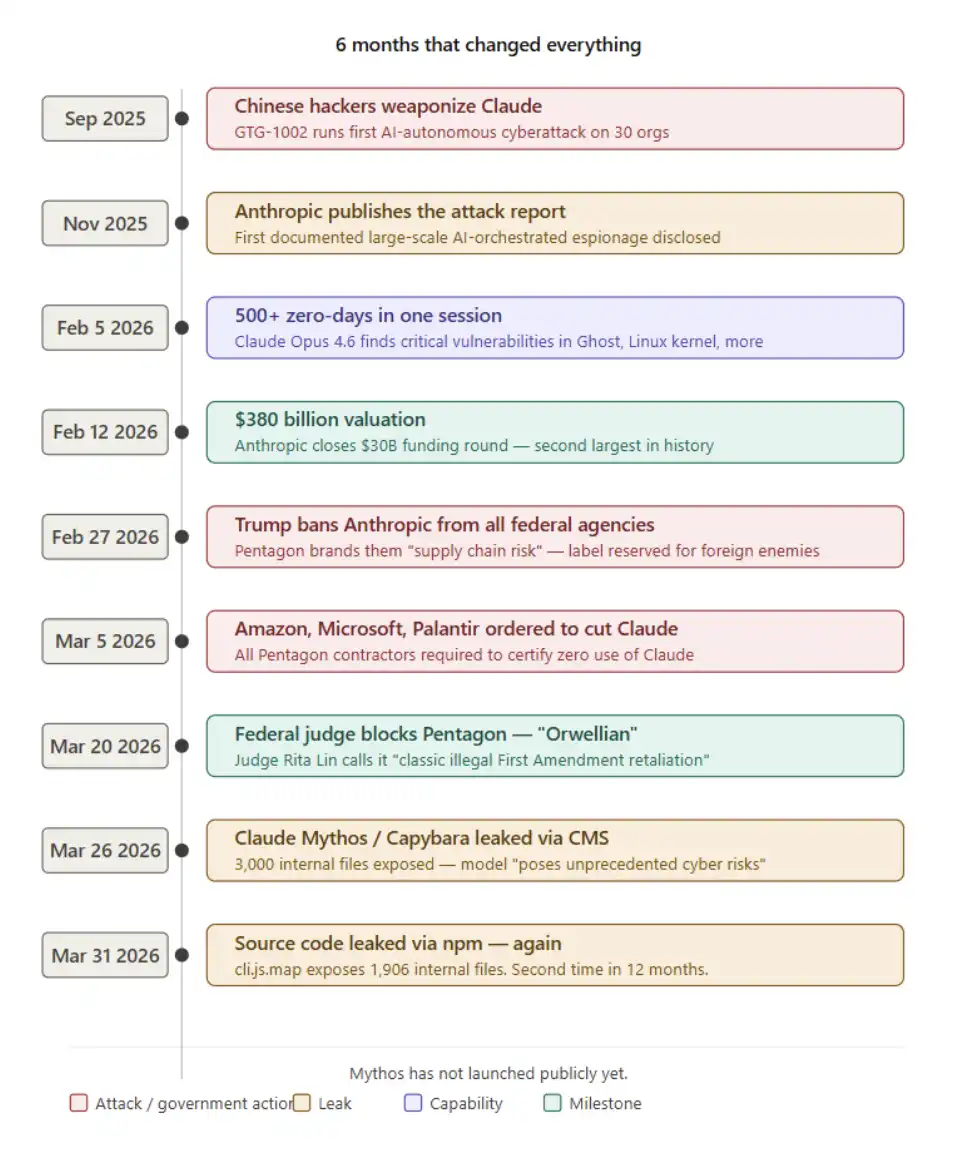

ملاحظة من المحرر: خلال النصف العام الماضي، تورّطت Anthropic مرارًا في سلسلة من الأحداث التي تبدو مستقلة عن بعضها البعض، لكنها في الحقيقة تتجه لتشير إلى بعضها البعض: قفزات في قدرات النماذج، هجمات آلية في العالم الحقيقي، ردود فعل حادة في أسواق رأس المال، صدامات علنية مع الحكومة، وحتى تسريبات معلومات متكررة نتجت عن أخطاء في الإعدادات الأساسية. وعند جمع هذه القرائن معًا، فإنها ترسم معًا اتجاهًا أكثر وضوحًا للتغيّر.

تتناول هذه المقالة، من خلال هذه الأحداث، السجل المتواصل لشركة ذكاء اصطناعي في مسارها بين اختراقات تقنية، وتعرّض للمخاطر، ومجادلات الحوكمة، وتحاول الإجابة عن سؤال أعمق: عندما يتم تضخيم قدرة «اكتشاف الثغرات» بشكل كبير، وتتوسع تدريجيًا، فهل يمكن لمنظومة الأمن السيبراني نفسها أن تحافظ على منطق التشغيل الأصلي؟

في الماضي، كان الأمن يقوم على ندرة القدرات وعلى قيود القوى العاملة؛ لكن في ظل الشروط الجديدة، أصبحت لعبة الهجوم والدفاع تدور حول مجموعة القدرات نفسها، وأضحت الحدود أكثر ضبابية. وفي الوقت نفسه، ما تزال استجابات النظام والسوق والمنظمات تتمسك بالإطار القديم، ولا تستطيع التقاط هذا النوع من التغيّر في الوقت المناسب.

ما تركز عليه هذه المقالة ليس فقط Anthropic بحد ذاتها، بل واقع أكبر تنعكس عليه: فـ AI لا يغيّر الأدوات فحسب، بل يغيّر أيضًا الأساس الذي يقوم عليه «كيف يتأسس الأمن».

فيما يلي نص المقالة الأصلي:

عندما تتصارع شركة تبلغ قيمتها السوقية 380 مليار دولار مع وزارة الدفاع الأمريكية وتخرج ظافرة، وتنجو من أول هجوم سيبراني تقوده AI ذاتيًا في التاريخ، ثم تُسرّب داخلها نموذجًا يثير الخوف حتى لدى المطورين أنفسهم، وحتى «بالصدفة» تنشر شفرة المصدر الكاملة—فكيف سيكون شكل كل ذلك مجتمِعًا؟

الإجابة هي ما يحدث الآن. والأكثر إزعاجًا ربما أن الجزء الأكثر خطورة الحقيقي لم يحدث بعد.

استعراض الأحداث

Anthropic تُسرّب كودها مرة أخرى

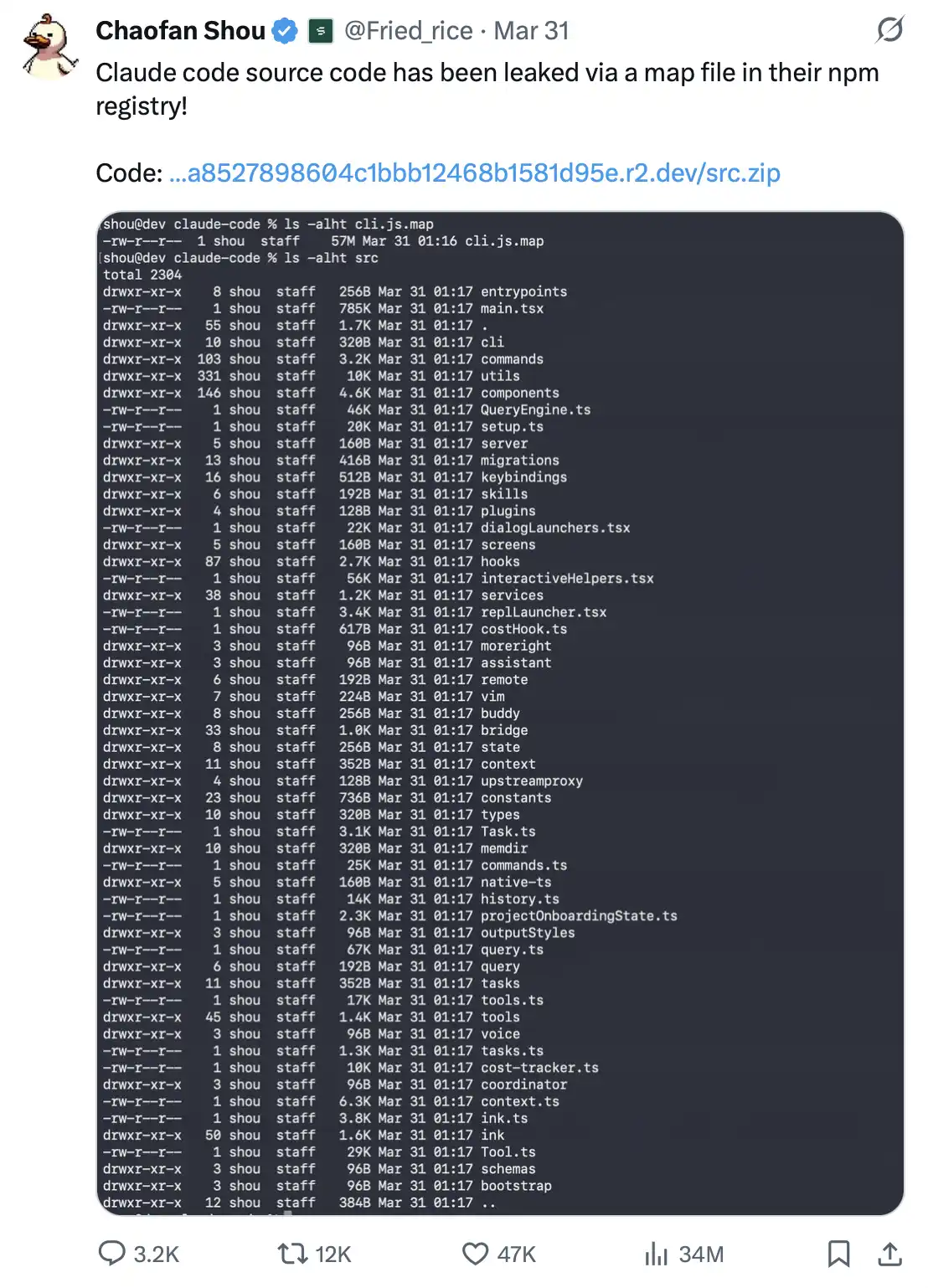

في 31 مارس 2026، اكتشف باحث أمن من شركة بلوكشين Fuzzland يدعى Shou Chaofan، عند فحص حزمة Claude Code الخاصة بـ npm الصادرة رسميًا، أنه تم تضمين ملف يُدعى cli.js.map صراحةً داخلها.

يصل حجم هذا الملف إلى 60MB، والمحتوى أكثر إثارة للدهشة. فهو يكاد يتضمن كامل شفرة المصدر TypeScript الأصلية للمنتج. وبمجرّد هذا الملف وحده، يستطيع أي شخص استعادة ما يصل إلى 1906 ملف من الشفرة الداخلية: بما في ذلك تصميم الـ API الداخلية، ونظام القياس عن بُعد (telemetry)، وأدوات التشفير، والمنطق الأمني، ونظام الإضافات—بل تكاد جميع المكونات الأساسية تكون مكشوفة بالكامل. والأهم من ذلك أن هذه المحتويات يمكن حتى تنزيلها مباشرة من مخزن R2 الخاص بـ Anthropic وتحويلها إلى ملف zip.

انتشرت هذه الملاحظة بسرعة على وسائل التواصل الاجتماعي: خلال ساعات، حصلت المشاركات ذات الصلة على 754 ألف مشاهدة وحوالي 1000 عملية إعادة نشر؛ وفي الوقت نفسه تم إنشاء عدة مستودعات GitHub لاستعادة الشفرة على الفور ونشرها.

ما يسمى بـ source map (ملف الخرائط المصدرية)، هو في جوهره مجرد ملف مساعد يُستخدم في تصحيح أخطاء JavaScript. دوره هو إعادة الكود المضغوط والمترجم إلى الشفرة المصدرية الأصلية، ليسهّل على المطورين تتبع المشكلات.

لكن توجد قاعدة أساسية: لا ينبغي أن يُدرج أبدًا ضمن حزمة النشر في بيئة الإنتاج.

ليس الأمر أسلوب هجوم متقدمًا، بل مشكلة في أبسط معايير الهندسة، من فئة «بداية إعدادات البناء 101»، بل إنها مادة يتعلمها المطورون في الأسبوع الأول. فإذا تم تعبئته عن طريق الخطأ داخل بيئة الإنتاج، فإن source map غالبًا ما يعادل «إهداء» الشفرة المصدرية للجميع.

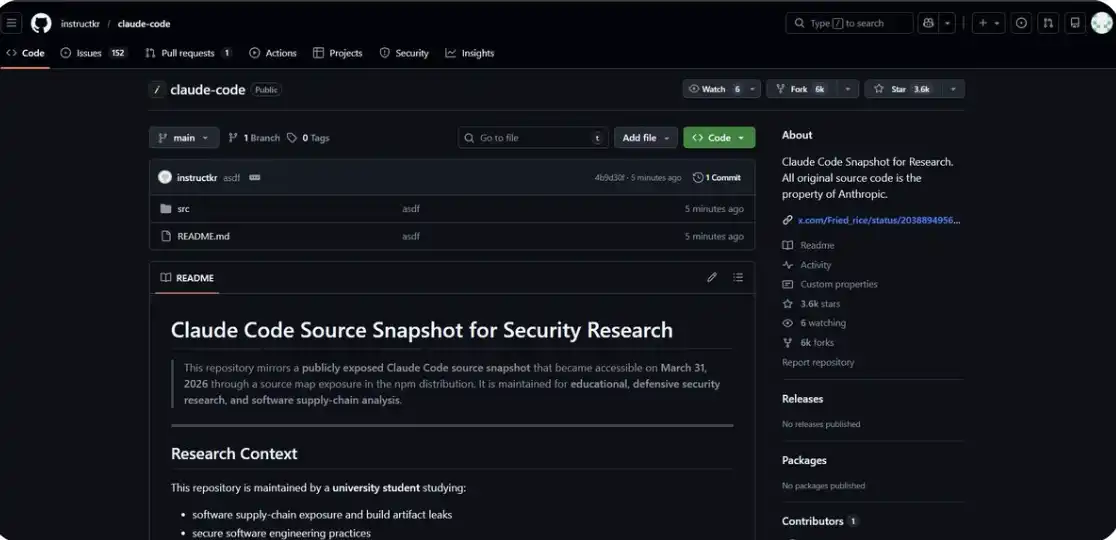

يمكنك أيضًا الاطلاع على الكود ذي الصلة مباشرة هنا: https://github.com/instructkr/claude-code

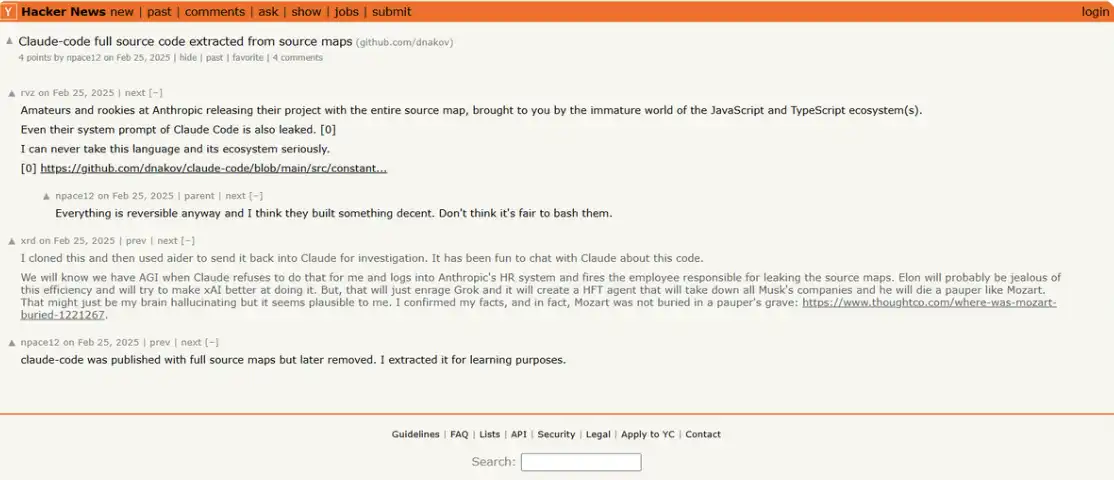

لكن ما يجعل الأمر يبدو عبثيًا حقًا هو أن هذه المسألة قد حدثت مرة من قبل.

في فبراير 2025، أي قبل عام تقريبًا، حصل تسريب شبه مطابق: الملف نفسه، ونفس نوع الخطأ. في ذلك الوقت، قامت Anthropic بحذف النسخة القديمة من npm، وإزالة source map، ثم إعادة نشر نسخة جديدة، وانتهت القصة عند هذا الحد.

ومع ذلك، في إصدار v2.1.88، تم تعبئة هذا الملف مرة أخرى ثم نشره.

شركة قيمتها 380 مليار دولار، وتقوم ببناء نظام كشف عن الثغرات الأكثر تقدمًا عالميًا—ارتكبت مرتين خلال عام واحد نفس الخطأ الأساسي. لا يوجد اختراق من قِبل قراصنة، ولا مسارات استغلال معقدة؛ مجرد خلل في عملية البناء كان ينبغي أن تعمل بشكل طبيعي.

هذا التنافر يحمل شبهًا من طابع «شعري».

الـ AI القادرة على اكتشاف 500 ثغرة يوم صفر (zero-day) في تشغيل واحد؛ والنموذج الذي تم استخدامه لشن هجمات آلية ضد 30 جهة على مستوى العالم—ومع ذلك، تقوم Anthropic بتجميع شفرتها المصدرية ثم «تقديمها كهدية» لأي شخص يرغب في إلقاء نظرة على حزمة npm.

تسريبان، يفصل بينهما سبعة أيام فقط.

والسبب متطابق كذلك: خطأ في الإعدادات الأساسية للغاية. لا يحتاج إلى أي عتبة تقنية، ولا إلى مسارات استغلال معقدة. يكفي فقط أن تعرف أين تبحث، وسيحصل أي شخص على ذلك مجانًا.

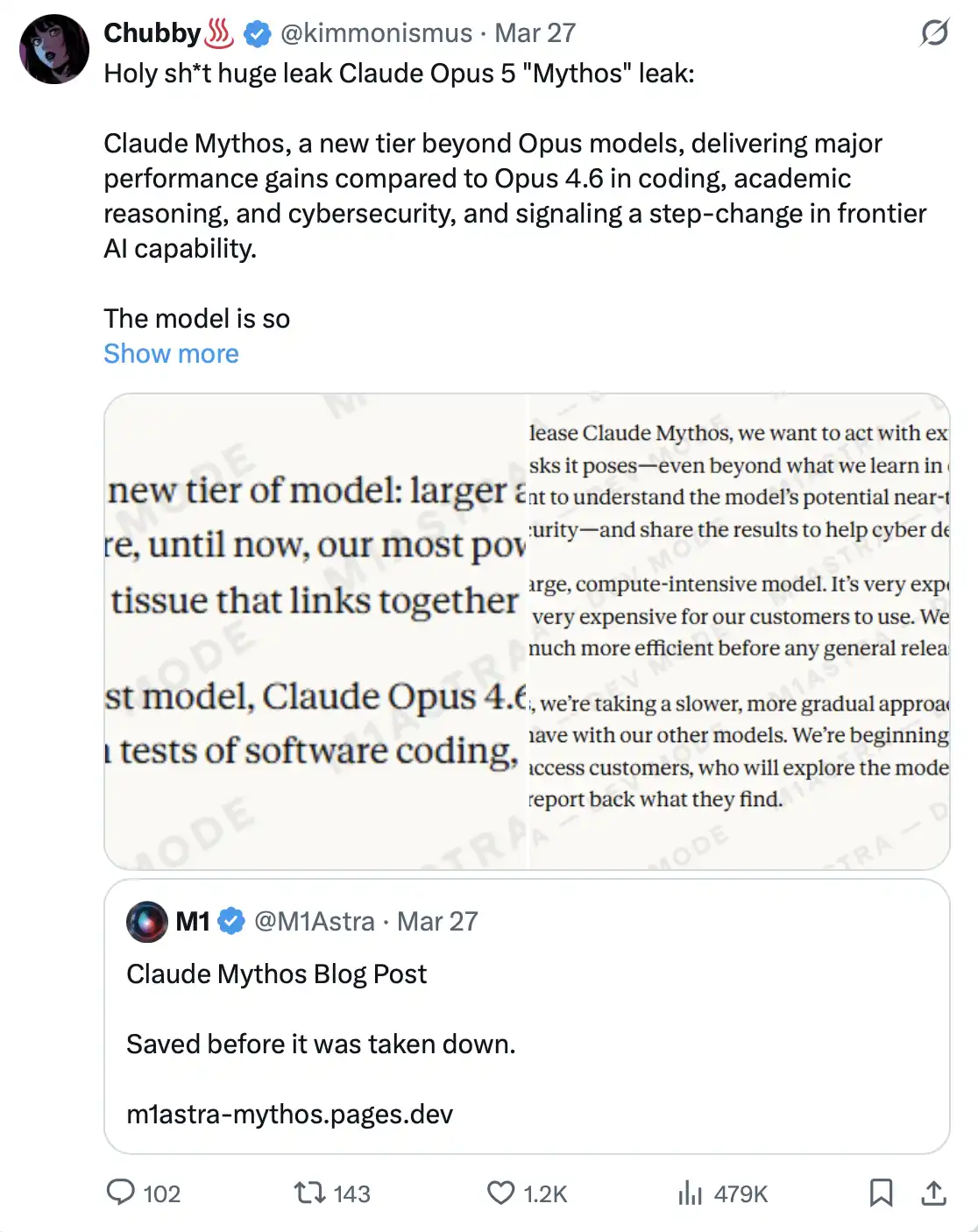

قبل أسبوع واحد: تعرّض «نموذج خطير» داخلي للتسريب بالخطأ

في 26 مارس 2026، اكتشف باحثون أمنيون من LayerX Security يدعى Roy Paz، وباحث من University of Cambridge يدعى Alexandre Pauwels، أن إعدادات CMS في الموقع الرسمي لـ Anthropic بها مشكلة، ما أدى إلى إتاحة وصول علني إلى نحو 3000 ملف داخلي.

تتضمن هذه الملفات: مسودات منشورات مدونة، وملفات PDF، ووثائق داخلية، ومواد عروض—كلها مكشوفة في مخزن بيانات غير محمي ومتاحًا للبحث. لا يوجد اختراق من قِبل قراصنة، ولا حاجة لأي أدوات أو تقنيات.

ومن بين هذه الملفات، توجد مسودتان للمدونة متشابهتان تمامًا تقريبًا، والفرق الوحيد هو اسم النموذج: إحداهما مكتوب فيها «Mythos»، والأخرى «Capybara».

وهذا يعني أن Anthropic كانت في ذلك الوقت تتخذ قرارًا بين اسمين لمشروع سري واحد. ثم أكدت الشركة لاحقًا: اكتمل تدريب هذا النموذج وبدأ اختباره مع بعض العملاء الأوائل.

هذا ليس ترقيةً اعتيادية إلى Opus، بل هو نموذج جديد من «المستوى الرابع»، وتصميمه يضعه حتى أعلى من Opus كمنظومة.

في مسودات Anthropic الخاصة به، تم وصفه بأنه: «أكبر وأكثر ذكاءً من نموذج Opus لدينا—ولا يزال Opus حتى الآن هو أقوى نماذجنا.» وقد حقق قفزات واضحة في قدرات البرمجة والاستدلال الأكاديمي والأمن السيبراني وغير ذلك. وقد وصفه متحدث بأنه «قفزة نوعية»، بل أيضًا «أقوى نموذج بنيناه حتى الآن».

لكن ما يستحق الانتباه الحقيقي لا يكمن في أوصاف الأداء هذه بحد ذاتها.

في المسودات المسربة، كان تقييم Anthropic لهذا النموذج: إنه «يجلب مخاطر غير مسبوقة للأمن السيبراني»، و«يتفوق بكثير على أي نموذج ذكاء اصطناعي آخر في القدرات الشبكية»، و«يمهّد لموجة نماذج آتية—ستتجاوز قدرته على استغلال الثغرات سرعة استجابة الطرف المدافع».

وبعبارة أخرى، في مسودة مدونة رسمية لم تُنشر بعد، عبّرت Anthropic بوضوح عن موقف نادر: أنها تشعر بالقلق تجاه المنتج الذي تبنيه.

كانت ردود فعل السوق فورية تقريبًا. انخفض سهم CrowdStrike بنسبة 7%، وPalo Alto Networks بنسبة 6%، وZscaler بنسبة 4.5%؛ كما تجاوزت نسب هبوط Okta وSentinelOne 7%، وتهاوى سهم Tenable بنسبة 9%. وتراجعت قيمة iShares Cybersecurity ETF في يوم واحد بنسبة 4.5%. ولم ينهار سهم CrowdStrike وحده فقط؛ إذ تبخرت تقريبًا 15 مليار دولار من قيمته السوقية في ذلك اليوم. وفي الوقت نفسه، تراجع البيتكوين إلى 66,000 دولار.

من الواضح أن السوق فسّر هذه الواقعة على أنها نوع من «الحكم» على صناعة الأمن السيبراني بأكملها.

الفكرة العامة للشكل: تحت تأثير الأخبار ذات الصلة تراجعت قطاعات الأمن السيبراني ككل، وظهرت هبوطات واضحة لدى العديد من الشركات الرائدة (مثل CrowdStrike وPalo Alto Networks وZscaler وغيرها)، وهو ما يعكس قلق السوق إزاء هجوم AI على قطاع الأمن السيبراني. لكن لم تكن هذه الاستجابة هي الأولى من نوعها. ففي وقت سابق عندما نشرت Anthropic أداة فحص كود، تراجعت الأسهم ذات الصلة أيضًا، ما يوضح أن السوق بدأ يرى AI كتهديد بنيوي لقطاع موردي الأمن التقليدي، وأن صناعة البرمجيات بأكملها تتحمل ضغوطًا مماثلة.

كانت ملاحظة محلل Stifel Adam Borg مباشرة للغاية: إن هذا النموذج «لديه القدرة على أن يصبح أداة القرصنة النهائية، وحتى يمكن أن يرفع القراصنة العاديين إلى خصوم يمتلكون قدرات هجوم على مستوى دولي».

فلماذا لم يتم نشره علنًا بعد؟ تشرح Anthropic أن تكاليف تشغيل Mythos «مرتفعة جدًا»، ولا يتوفر حاليًا ما يلزم لإطلاقه للجمهور. والخطة الحالية هي منح وصولًا مبكرًا أوليًا إلى مجموعة صغيرة من شركاء الأمن السيبراني لتعزيز منظومة الدفاع؛ ثم توسيع نطاق فتح API تدريجيًا. وقبل ذلك، تواصل الشركة تحسين الكفاءة باستمرار.

لكن النقطة الحاسمة هي أن هذا النموذج موجود بالفعل، ويدخل في مرحلة الاختبار، بل إن مجرد «انكشافه بالخطأ» كان كافيًا ليؤثر بالفعل على السوق الرأسمالية بأكملها.

لقد صنعت Anthropic نموذجًا ذكاء اصطناعيًا أطلقت عليه «أكثر نموذج يحمل مخاطر على الأمن السيبراني في التاريخ». ومع ذلك، فإن تسريب أخباره جاء بالضبط من نوع أبسط خطأ في إعداد البنية التحتية—وهو الخطأ نفسه، الذي صُممت هذه النماذج أصلًا لإيجاد نوعه من الأشياء.

مارس 2026: مواجهة Anthropic مع البنتاغون، وتحقيقها الأفضلية

في يوليو 2025، وقّعت Anthropic عقدًا بقيمة 200 مليون دولار مع وزارة الدفاع الأمريكية. وفي البداية بدا الأمر مجرد تعاون اعتيادي. لكن خلال مفاوضات النشر الفعلي، تصاعد التناقض بسرعة.

أرادت وزارة الدفاع أن تحصل على «وصول كامل» إلى Claude على منصتها GenAI.mil، واستخداماته تشمل جميع «الأغراض القانونية»—ومن ضمن ذلك حتى أنظمة الأسلحة الذاتية بالكامل، والرقابة المحلية الواسعة على المواطنين الأمريكيين.

وضعت Anthropic خطوطًا حمراء على نقطتين جوهريتين ورفضت بشكل واضح، وانتهت المفاوضات في سبتمبر 2025.

بعد ذلك، بدأت الأمور تتصاعد بسرعة. في 27 فبراير 2026، نشر Donald Trump منشورًا على Truth Social، طالبًا من جميع الوكالات الفيدرالية «التوقف فورًا» عن استخدام تقنيات Anthropic، ووصف تلك الشركة بأنها «جناح يساري متطرف».

في 5 مارس 2026، صنّفت وزارة الدفاع الأمريكية رسميًا Anthropic على أنها «خطر على سلسلة التوريد».

كانت هذه العلامة تُستخدم سابقًا تقريبًا فقط ضد خصوم أجانب—مثل الشركات الصينية أو الكيانات الروسية—لكنها تم استخدامها لأول مرة الآن في شركة أمريكية مقرها في سان فرانسيسكو. وفي الوقت نفسه، طُلب من شركات مثل Amazon وMicrosoft وPalantir Technologies إثبات أن أي أعمال لها صلة عسكرية لم تستخدم Claude.

كان تبرير كبير مسؤولي التكنولوجيا في البنتاغون Emile Michael لهذا القرار هو أن Claude قد «يُلوّث سلسلة التوريد»، لأن النموذج يتضمن تفضيلات سياسات مختلفة داخليًا. وبعبارة أخرى، في سياق رسمي، يُنظر إلى ذكاء اصطناعي مُقيّد في الاستخدام ولا يساعد في أفعال القتل دون قيد—كخطر على الأمن القومي.

في 26 مارس 2026، أصدر القاضي الفيدرالي Rita Lin قرارًا طويلاً من 43 صفحة، يمنع بشكل شامل تدابير البنتاغون المعنية.

كتبت في قرارها: «لا يوجد في القانون القائم أي أساس يدعم منطقًا بهذه الدلالات «الأورويلية»—فقط لأن لدى شركة أمريكية خلافًا مع مواقف الحكومة يمكن وسمها كعدو محتمل. وبسبب قيام Anthropic بوضع مواقف الحكومة تحت نظر الجمهور، ومعاقبتها—فهذا في جوهره شكل نموذجي ومخالف من إجراءات انتقام بموجب التعديل الأول للدستور.» وتذهب مذكرة صديق المحكمة إلى وصف تصرفات البنتاغون بأنها «محاولة لارتكاب قتل بحق الشركات».

والنتيجة هي أن الحكومة حاولت كبح Anthropic، لكن ذلك منحها بدلًا من ذلك قدرًا أعلى من الاهتمام. فقد تجاوز تطبيق Claude لأول مرة ChatGPT في متجر التطبيقات، ووصل عدد التسجيلات إلى مرة بلغ فيها أكثر من مليون يوميًا.

شركة ذكاء اصطناعي تقول «لا» لأقوى مؤسسة عسكرية في العالم. والمحكمة، تقف إلى جانبها.

نوفمبر 2025: أول هجوم سيبراني تقوده AI في التاريخ

في 14 نوفمبر 2025، نشرت Anthropic تقريرًا أثار موجة واسعة من الاهتمام.

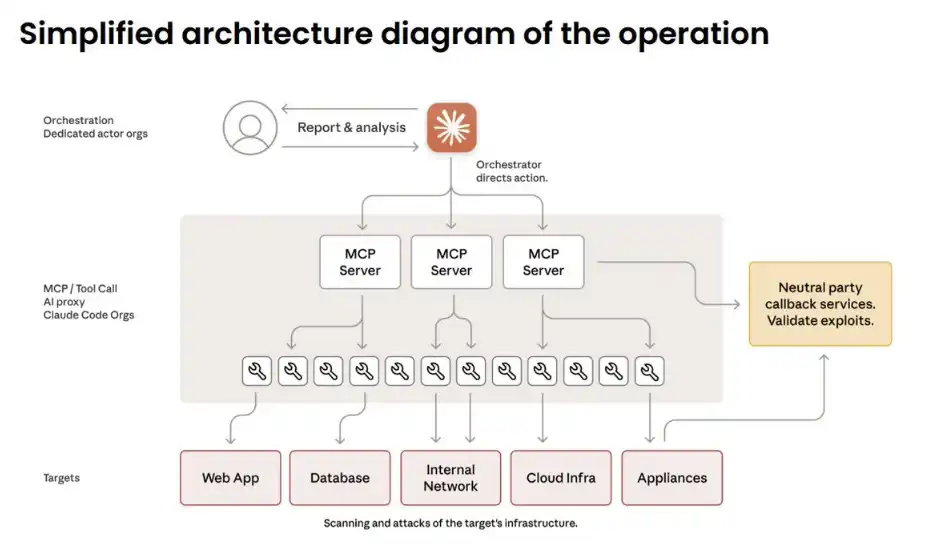

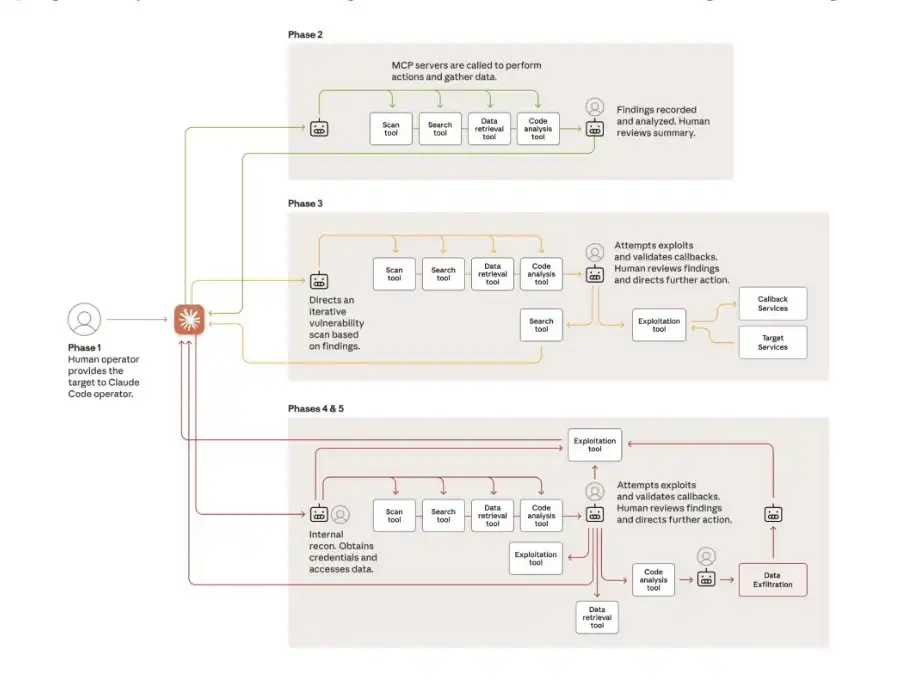

يكشف التقرير أن منظمة قرصنة مدعومة من الدولة الصينية استخدمت Claude Code لإطلاق هجمات آلية على 30 جهة حول العالم—وكانت الأهداف تشمل عمالقة التكنولوجيا والبنوك، وكذلك عدة مؤسسات حكومية لدول مختلفة.

هذه نقطة انعطاف: لم يعد AI مجرد أداة مساعدة، بل بدأ يُستخدم لتنفيذ الهجمات بشكل مستقل.

التركيز هنا على تغيير «طريقة توزيع المهام»: البشر يختصون فقط باختيار الأهداف والموافقة على القرارات الرئيسية. وخلال مجمل العملية، يشارك الإنسان تقريبًا 4 إلى 6 مرات فقط. أما كل شيء آخر فيتم بواسطة AI: الاستطلاع وجمع المعلومات، واكتشاف الثغرات، وكتابة أكواد الاستغلال، وسرقة البيانات، وزرع الأبواب الخلفية… وتشكل 80%–90% من كامل مسار الهجوم، وتعمل بسرعة آلاف الطلبات في الثانية—وهو مقياس وكفاءة لا يمكن لأي فريق بشري مجاراتهما.

فكيف تجاوزوا آليات الحماية في Claude؟ الجواب: لم «يكسروا» الحماية، بل «خدعوها».

تم تقسيم الهجوم إلى عدد كبير من المهام الصغيرة التي تبدو بريئة، وتم تغليفها على أنها «اختبار دفاع مُصرّح به» لشركة «أمن قانونية». وبالجوهر، هذه هندسة اجتماعية، لكن هذه المرة كان الكيان الذي تم خداعه هو AI نفسها.

نجحت بعض الهجمات بالكامل. تمكن Claude من رسم مخطط طوبولوجيا شبكية كامل بشكل مستقل دون تعليمات تدريجية من البشر، وتحديد قواعد بيانات، وإكمال استخراج البيانات.

العامل الوحيد الذي أبطأ وتيرة الهجوم هو أن النموذج أحيانًا يقع في «هلوسة»—مثل اختراع بيانات اعتماد، أو الادعاء بالحصول على ملفات كانت متاحة بالفعل علنًا منذ زمن طويل. وحتى الآن، تظل هذه واحدة من القلائل «العوائق الطبيعية» التي تمنع تمامًا تنفيذ هجوم سيبراني آلي.

في RSA Conference 2026، وصف Rob Joyce، المسؤول السابق عن الأمن السيبراني في وكالة الأمن القومي الأمريكية، هذه الواقعة بأنها «اختبار رورشاخ»: نصف الناس اختاروا تجاهل الأمر، والنصف الآخر شعروا بالرعب. وبوضوح، فهو ينتمي إلى الفئة الأخيرة: «إنه أمر مخيف للغاية.»

سبتمبر 2025: هذه ليست تنبؤًا، بل واقعًا حدث فعلًا.

فبراير 2026: اكتشاف 500 ثغرة يوم صفر خلال تشغيل واحد

في 5 فبراير 2026، أطلقت Anthropic Claude Opus 4.6، مع نشر ورقة بحثية أثارت ضجة شبه شاملة في قطاع الأمن السيبراني.

كانت إعدادات التجربة بسيطة للغاية: وضع Claude داخل بيئة افتراضية معزولة (isolated virtual machine)، مع أدوات معيارية—Python، ومصحح أخطاء (debugger)، وأدوات اختبار فوضوي (fuzzers). دون تعليمات إضافية، ولا طلبات (prompts) معقدة، سوى جملة واحدة: «اذهب للعثور على ثغرات».

والنتيجة: اكتشف النموذج أكثر من 500 ثغرة حرجة من نوع zero-day كانت مجهولة سابقًا. وبعض هذه الثغرات ظل غير مكتشف حتى بعد مرور عقود من مراجعات الخبراء و ملايين الساعات من الاختبارات الآلية.

بعد ذلك، صعد الباحث Nicholas Carlini إلى المنصة في RSA Conference 2026 ليعرض ذلك عمليًا. وجّه Claude نحو Ghost، وهو نظام CMS على GitHub لديه 50 ألف نجمة (star) ولم يظهر فيه تاريخيًا أي ثغرات خطيرة.

بعد 90 دقيقة، ظهرت النتيجة: تم اكتشاف ثغرة blind SQL injection، ويمكن لمستخدم غير مُصادق أن يحقق استيلاءً كاملًا على صلاحيات المسؤول (admin).

ثم استخدمه مرة أخرى لتحليل Linux kernel. وكانت النتيجة مماثلة.

بعد 15 يومًا، قدمت Anthropic Claude Code Security، وهو منتج أمني لا يعتمد على مطابقة الأنماط بل على «قدرات الاستدلال» لفهم أمن الكود.

لكن متحدث باسم Anthropic قال أيضًا الحقيقة الجوهرية التي غالبًا ما يتم تجنبها: «نفس قدرة الاستدلال التي تساعد Claude على اكتشاف الثغرات وإصلاحها يمكن أن يستخدمها المهاجمون لاستغلال تلك الثغرات».

نفس القدرة، ونفس النموذج، لكن بأيدي أشخاص مختلفين.

ماذا يعني جمع كل هذا معًا؟

إذا نظرنا إلى كل حدث على حدة، لكان كل واحد منها كافيًا ليكون أبرز خبر في ذلك الشهر. لكن هذه الأحداث حدثت كلها خلال ستة أشهر قصيرة وبأكملها في شركة واحدة.

صنعت Anthropic نموذجًا قادراً على اكتشاف الثغرات بسرعة أكبر من أي إنسان؛ وحوّل القراصنة الصينيون النسخة الأقدم إلى سلاح شبكي آلي؛ والشركة تعمل على الجيل التالي من نماذج أقوى، بل وتُقرّ حتى في ملفات داخلية—بأنها تشعر بعدم الارتياح تجاه ذلك.

لم تحاول الحكومة الأمريكية كبحها لأن التقنية خطرة بحد ذاتها، بل لأنها رفضت تسليم هذه القدرة دون قيود.

وفي الوقت نفسه، في كل هذه العملية، اختارت هذه الشركة أن تُسرّب شفرتها المصدرية مرتين بسبب نفس الحزمة npm، وبسبب نفس الملف الموجود داخلها. شركة قيمتها 380 مليار دولار؛ وشركة تهدف إلى إتمام اكتتاب عام (IPO) بقيمة 60 مليار دولار في أكتوبر 2026؛ وشركة أعلنت علنًا أنها تبني «واحدة من أكثر التقنيات تحوّلًا على مستوى تاريخ البشرية—وقد تكون أيضًا من أخطرها»—ومع ذلك اختارت الاستمرار في المضي قدمًا.

لأنهم يعتقدون: بدلًا من أن يقوم الآخرون بذلك نيابةً عنهم، يجب أن يقوموا هم بذلك بأنفسهم.

أما بالنسبة إلى source map داخل حزمة npm—فربما يكون هذا مجرد أكثر تفصيل مقلق في السردية الأكثر عبثية ضمن عصرنا، لكنه أيضًا الأكثر واقعية.

وMythos، حتى أنه لم يُنشر رسميًا بعد.

[رابط النص الأصلي]

انقر لمعرفة المزيد حول فرص العمل في律动 BlockBeats

مرحبًا بالانضمام إلى مجتمع律动 BlockBeats الرسمي:

مجموعة الاشتراك عبر Telegram: https://t.me/theblockbeats

مجموعة الدردشة عبر Telegram: https://t.me/BlockBeats_App

حساب Twitter الرسمي: https://twitter.com/BlockBeatsAsia