L'élu demande : "Qui est responsable si l'élevage de homards par le secteur financier pose problème ?" La Commission de surveillance financière répond : "Les mandataires IA seront intégrés à la réglementation"

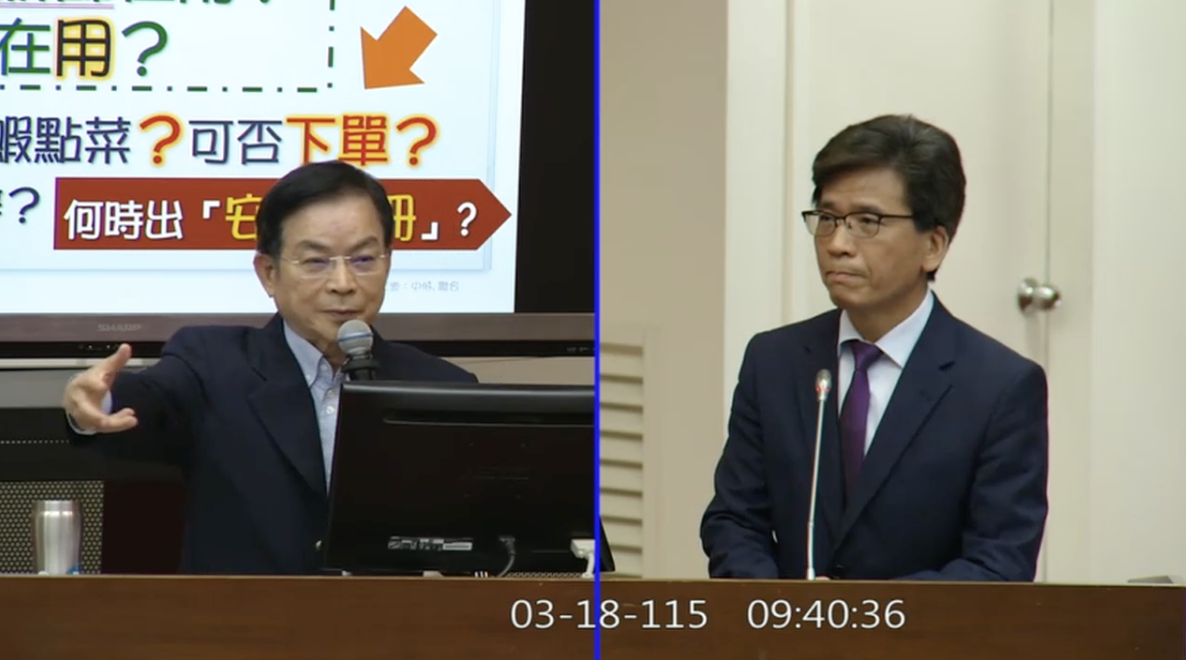

Le député Lai Shih-po a mentionné lors de la commission des finances de la Yuan législative l’outil d’IA agent OpenClaw (communément appelé « Langouste »), en demandant à la FSC si la responsabilité serait engagée si une erreur survenait lors d’une commande automatique par IA dans le secteur financier. Le président de la FSC, Peng Jinlong, a répondu qu’en cas d’impact sur la sécurité opérationnelle des institutions financières, l’autorité de supervision interviendrait, et que la technologie d’IA agent serait à l’avenir intégrée officiellement dans les directives.

(Précédent : Clawdbot, un assistant IA 24/7 qui a saturé les ventes du Mac mini)

(Contexte supplémentaire : Huang Renxun annonce l’entrée de NVIDIA dans le calcul spatial : Vera Rubin Space-1 construit un centre de données orbital)

Le 18 mars, lors de la commission des finances de la Yuan, le député Lai Shih-po est monté à la tribune avec une capture d’écran d’un outil d’IA à motif de langouste rouge. Il s’agit d’OpenClaw, un logiciel d’IA open source capable de prendre le contrôle d’un ordinateur via des commandes en langage naturel, d’accéder au navigateur et aux fichiers locaux, avec une méthode d’opération très différente des chatbots traditionnels.

Le problème est maintenant posé. Lai Shih-po a indiqué que des analystes boursiers et des courtiers locaux avaient déjà commencé à l’utiliser, et il a lancé une hypothèse à Peng Jinlong : « Si on lui demande d’acheter une action, comme une action TSMC, mais qu’il en achète dix, comment calcule-t-on la responsabilité ? »

La FSC : si cela impacte la sécurité opérationnelle, cela entre dans la supervision

Peng Jinlong n’a pas évité la question. Il a déclaré que si l’application d’IA concernée affecte la sécurité opérationnelle des institutions financières, « l’autorité de supervision doit bien sûr intervenir ». La FSC a publié en juin 2024 des « Directives pour l’utilisation de l’IA dans le secteur financier », couvrant la gouvernance des données, les risques liés aux modèles et la sécurité de l’information. Mais il a aussi reconnu que la vitesse d’évolution des technologies d’IA agent est trop rapide, et que les directives actuelles doivent suivre.

Peng Jinlong est resté calme, précisant qu’il faut d’abord étudier et tester avec prudence pour élaborer des réglementations de supervision précises et réalisables. Il a insisté sur le fait qu’il ne faut pas établir de règles à la hâte, mais qu’il ne faut pas non plus laisser faire n’importe quoi.

Le « manuel de sécurité pour l’élevage de langoustes » est pris au sérieux

Lai Shih-po a plaisanté en disant que le ministère chinois de la Sécurité d’État a publié officiellement un « manuel de sécurité pour l’élevage de langoustes », et il a demandé à la FSC que les institutions financières utilisant cet outil produisent également un document de sécurité opérationnelle similaire.

Lecture complémentaire : Le ministère chinois de la Sécurité d’État met en garde contre « l’élevage de langoustes » : OpenClaw cache quatre mines antipersonnel de sécurité, votre appareil pourrait être pris en otage

L’icône d’OpenClaw est une langouste rouge. Huang Renxun a déclaré lors du GTC 2026 qu’il s’agissait du « prochain ChatGPT », et NVIDIA a également lancé la version entreprise NemoClaw. De la Silicon Valley à la Yuan, cette langouste progresse plus vite que prévu.

La supervision financière face à des outils comme l’IA agent ne pose pas seulement des défis techniques, mais surtout la question de la responsabilité. À terme, le secteur financier pourrait devoir mettre en place un mécanisme de responsabilité homme-machine pour l’IA.