Un juge fédéral américain bloque temporairement l'interdiction d'Anthropic par le Pentagone

Un juge fédéral américain à San Francisco a accordé la demande d’Anthropic pour un répit temporaire après la désignation de l’entreprise par le Pentagone comme un risque de chaîne d’approvisionnement.

Dans un ordre jeudi, la juge Rita Lin du tribunal de district du district nord de Californie a ordonné une injonction préliminaire contre le Pentagone concernant cette étiquette. Cela suspend également temporairement une directive du président américain Donald Trump ordonnant aux agences fédérales de cesser d’utiliser le chatbot d’Anthropic, Claude.

« Rien dans le statut en vigueur ne soutient la notion orwellienne selon laquelle une entreprise américaine peut être étiquetée comme un adversaire potentiel et un saboteur des États-Unis pour avoir exprimé un désaccord avec le gouvernement », a déclaré la juge Lin.

Anthropic était le principal acteur sur les marchés de l’IA d’entreprise avec 32 %, devant OpenAI avec 25 %, en 2025, selon Menlo Ventures. Une interdiction à l’échelle gouvernementale sur Anthropic ferait chuter cette position.

La juge a déclaré que ces « mesures punitives larges » prises contre Anthropic par l’administration Trump et le secrétaire à la Défense Pete Hegseth semblaient « arbitraires, capricieuses, [et] un abus de pouvoir ».

L’ordre est intervenu après qu’Anthropic a déposé une plainte dans un tribunal fédéral de Columbia le 9 mars, alléguant que Hegseth avait outrepassé son autorité en désignant l’entreprise comme un risque de chaîne d’approvisionnement pour la sécurité nationale.

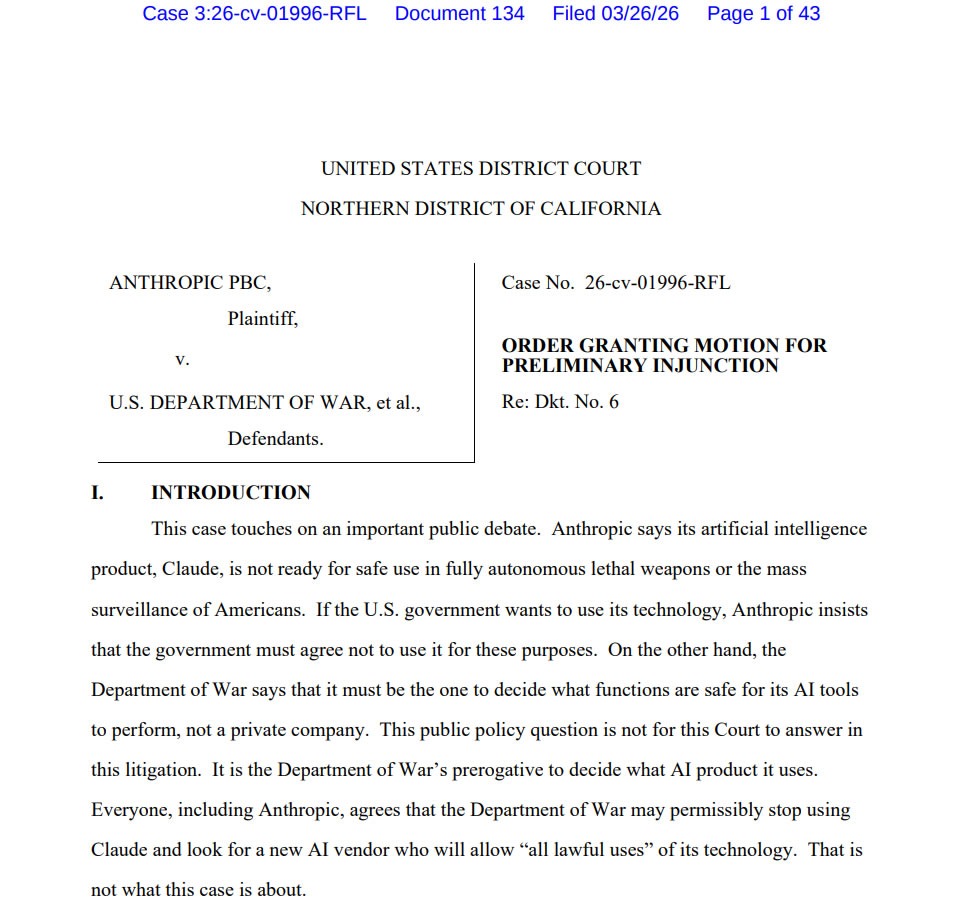

Capture d’écran de la décision du tribunal. Source : Courtlistener

Anthropic s’est opposé aux armes autonomes et à la surveillance de masse

Le différend découle d’un accord en juillet 2025 entre la société d’IA et le Pentagone concernant un contrat pour faire de Claude le premier modèle d’IA de frontière approuvé pour une utilisation sur des réseaux classifiés.

Les négociations se sont effondrées en février, le Pentagone cherchant à renégocier, insistant pour qu’Anthropic autorise l’utilisation militaire de Claude « à toutes fins légales » et sans restrictions.

Anthropic a soutenu que sa technologie ne devrait pas être utilisée pour des armes autonomes létales et pour la surveillance domestique de masse des Américains.

Le 27 février, Trump a ordonné à toutes les agences fédérales de cesser d’utiliser les produits d’Anthropic. « Les fous de gauche chez Anthropic ont commis une ERREUR CATASTROPHIQUE en essayant de METTRE LA PRESSION sur le Département de la Guerre », a-t-il écrit sur Truth Social.

Une audience judiciaire de 90 minutes s’est tenue à San Francisco le 24 mars, au cours de laquelle la juge Lin a pressé les avocats du gouvernement sur la question de savoir si Anthropic était puni pour avoir critiqué publiquement le Pentagone.

Classic illegal First Amendment retaliation

« Punir Anthropic pour avoir attiré l’attention du public sur la position contractuelle du gouvernement est une classique représailles illégales au premier amendement », a déclaré la décision du 26 mars.

Anthropic a déclaré dans un communiqué qu’il était « reconnaissant envers le tribunal pour avoir agi rapidement, et heureux qu’ils conviennent qu’Anthropic est susceptible de réussir sur le fond ».

**Magazine : **__Personne ne sait si la cryptographie sécurisée quantique fonctionnera même

Cointelegraph s’engage à un journalisme indépendant et transparent. Cet article de news est produit conformément à la politique éditoriale de Cointelegraph et vise à fournir des informations précises et opportunes. Les lecteurs sont encouragés à vérifier les informations de manière indépendante. Lisez notre politique éditoriale https://cointelegraph.com/editorial-policy

- #IA

- #Tribunal

- #Donald Trump

- #Réglementation