Os três momentos de Anthropic: fuga de código, confronto com o governo e militarização

Título original: Anthropic: The Leak, The War, The Weapon

Autor original: BuBBliK

Compilação: Peggy,BlockBeats

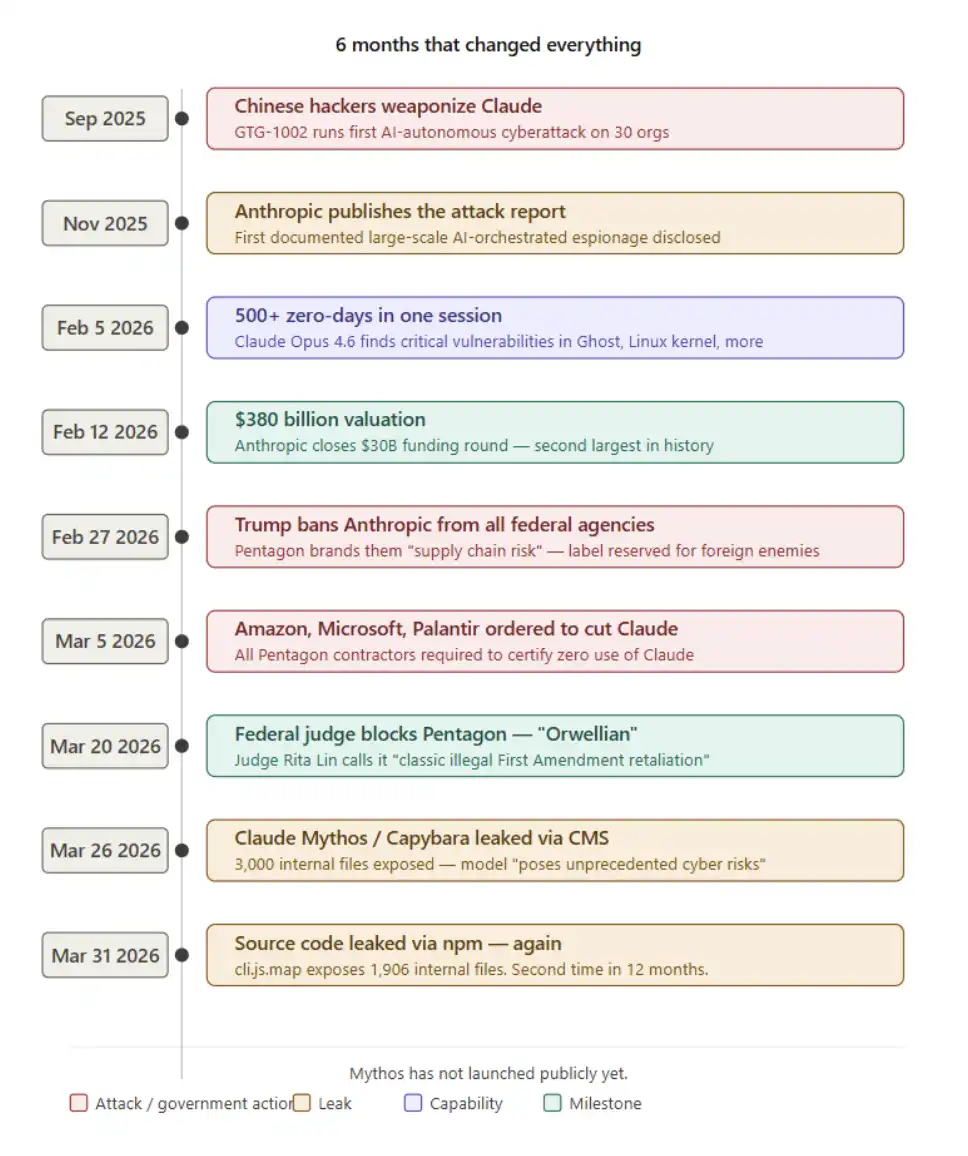

Nota do editor: Nos últimos seis meses, a Anthropic tem sido sucessivamente arrastada para uma série de acontecimentos que parecem independentes entre si, mas que na verdade apontam na mesma direção: um salto nas capacidades do modelo, ataques automatizados no mundo real, uma reação intensa do mercado de capitais, um confronto público com o governo e, por diversas vezes, fugas de informação causadas por falhas de configuração na base. Ao colocarmos estes indícios lado a lado, eles traçam em conjunto um rumo de mudança mais nítido.

Este artigo, tendo estes acontecimentos como ponto de entrada, revisita a trajetória contínua de uma empresa de IA na rutura entre avanços técnicos, exposição a riscos e jogos de governação — e tenta responder a uma questão mais profunda: quando a capacidade de “descobrir vulnerabilidades” é ampliada de forma extrema e vai-se difundindo, ainda pode o próprio sistema de segurança da informação manter a lógica de funcionamento original?

No passado, a segurança assentava na escassez de capacidades e nas limitações de recursos humanos; mas nas novas condições, ataque e defesa estão a convergir em torno do mesmo conjunto de capacidades do modelo, e as fronteiras ficam cada vez mais difusas. Ao mesmo tempo, as reações das instituições, do mercado e das organizações continuam presas em estruturas antigas, incapazes de acomodar atempadamente esta mudança.

O foco desta peça não é apenas a Anthropic em si, mas também uma realidade maior que ela reflete: a IA não está apenas a mudar ferramentas — está a mudar o próprio pressuposto de como “a segurança se sustenta”.

Segue-se o texto original:

Quando uma empresa com uma avaliação de 380 mil milhões de dólares, em disputa com o Pentágono e saindo por cima, sobrevive ao primeiro ataque cibernético da história lançado por uma IA autónoma, e ao mesmo tempo, no interior, vaza um modelo que até os próprios programadores desenvolvedores acham assustador, e até “acidentalmente” publica o código-fonte completo — somando tudo isto, que cenário se cria?

A resposta é exatamente como é agora. E o que é ainda mais inquietante é que, na verdade, a parte mais perigosa ainda poderá não ter acontecido.

Recapitulação dos acontecimentos

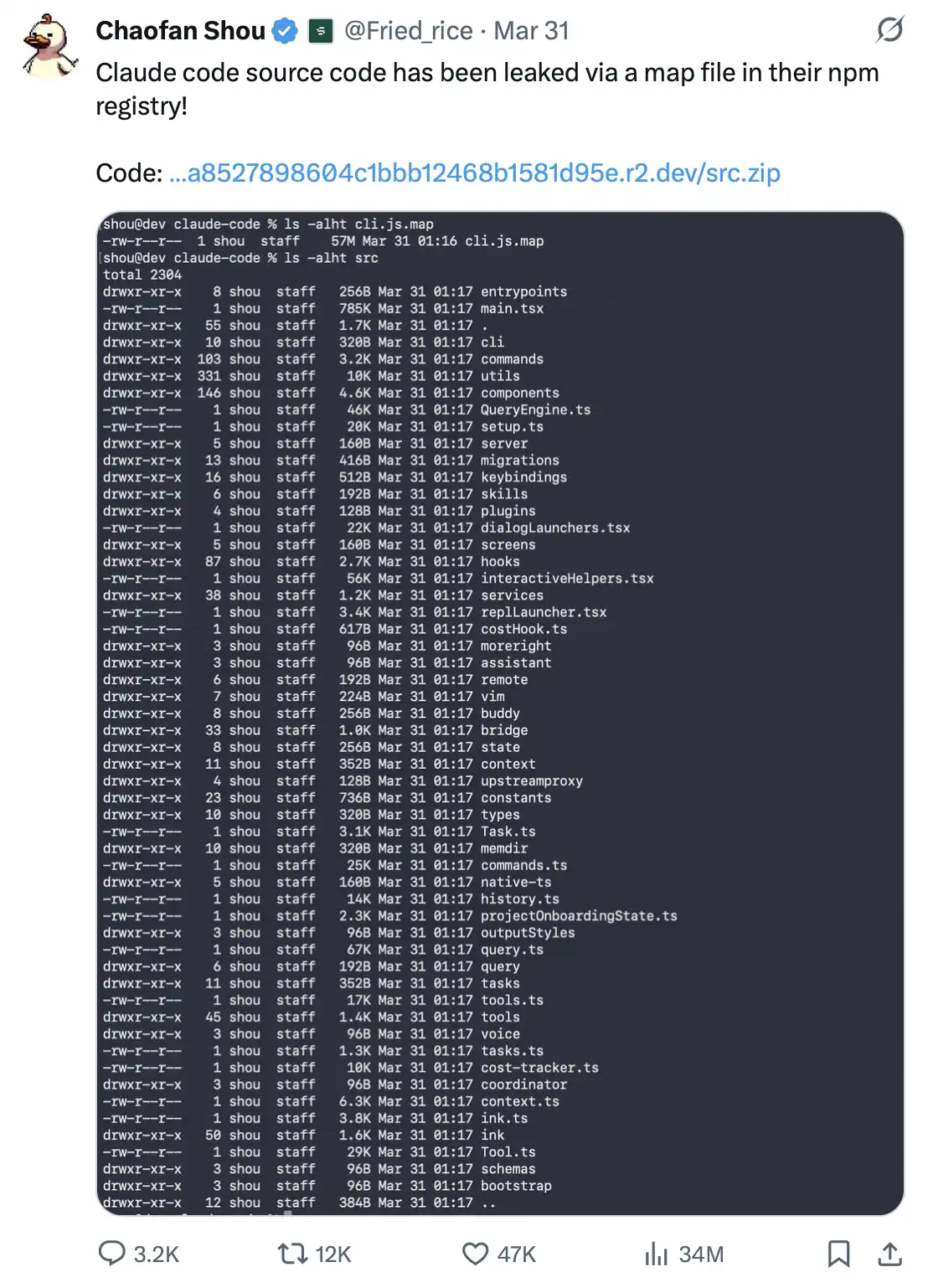

A Anthropic volta a vazar o próprio código

Em 31 de março de 2026, o investigador de segurança Shou Chaofan, da empresa de blockchain Fuzzland, ao verificar o pacote oficial do Claude Code npm, detetou que nele estava, afinal, incluído de forma explícita um ficheiro chamado cli.js.map.

Este ficheiro tem 60MB de tamanho; o conteúdo é ainda mais surpreendente. Ele praticamente contém todo o código-fonte TypeScript completo do produto. Só com este ficheiro, qualquer pessoa consegue reconstruir até 1906 ficheiros internos de código-fonte: incluindo design de APIs internas, sistema de telemetria, ferramentas de criptografia, lógica de segurança, sistema de plugins — praticamente todos os componentes centrais estão à vista. Mais importante ainda, estes conteúdos podem até ser descarregados diretamente dos próprios buckets de armazenamento R2 da Anthropic como um ficheiro zip.

A descoberta espalhou-se rapidamente nas redes sociais: em poucas horas, as publicações relacionadas alcançaram 754 mil visualizações e quase 1000 partilhas; entretanto, vários repositórios no GitHub que reconstruíram o código-fonte também foram criados e divulgados de imediato.

O chamado source map (ficheiro de mapeamento de origem) é, na essência, apenas um ficheiro auxiliar para debug de JavaScript; o seu papel é reconstituir o código original a partir do código comprimido e compilado, para facilitar aos programadores a deteção de problemas.

Mas existe um princípio básico: ele nunca deve ser incluído nos pacotes de distribuição em ambiente de produção.

Isto não é um tipo de ataque sofisticado; é um problema de normas de engenharia no mais básico, algo de “introdução à configuração de build 101”, até o que o programador aprende na primeira semana. Se for empacotado por engano no ambiente de produção, o source map acaba, em muitos casos, por equivaler a oferecer o código-fonte “de borla” a toda a gente.

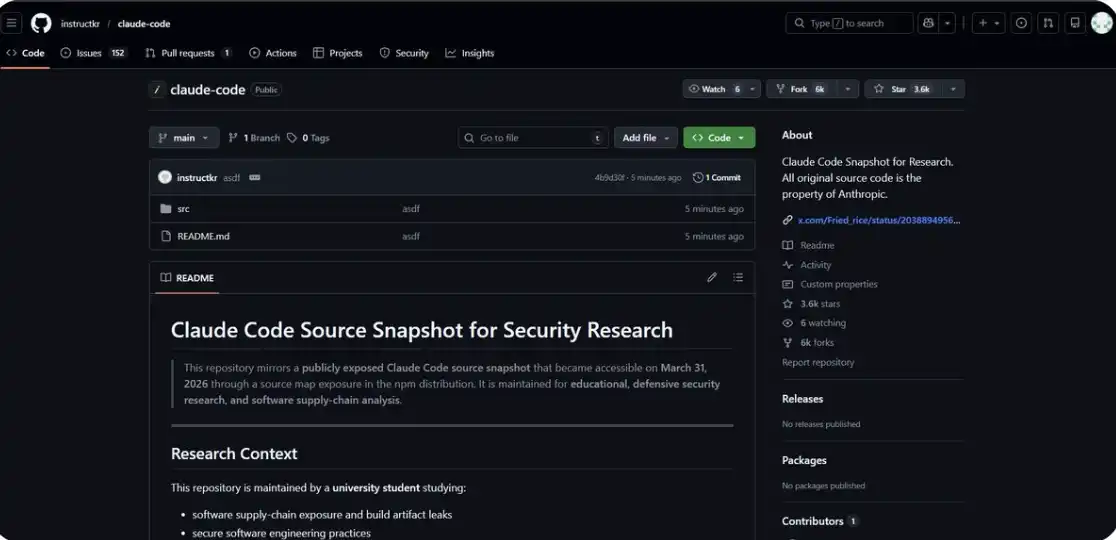

Pode também consultar diretamente o código relevante aqui: https://github.com/instructkr/claude-code

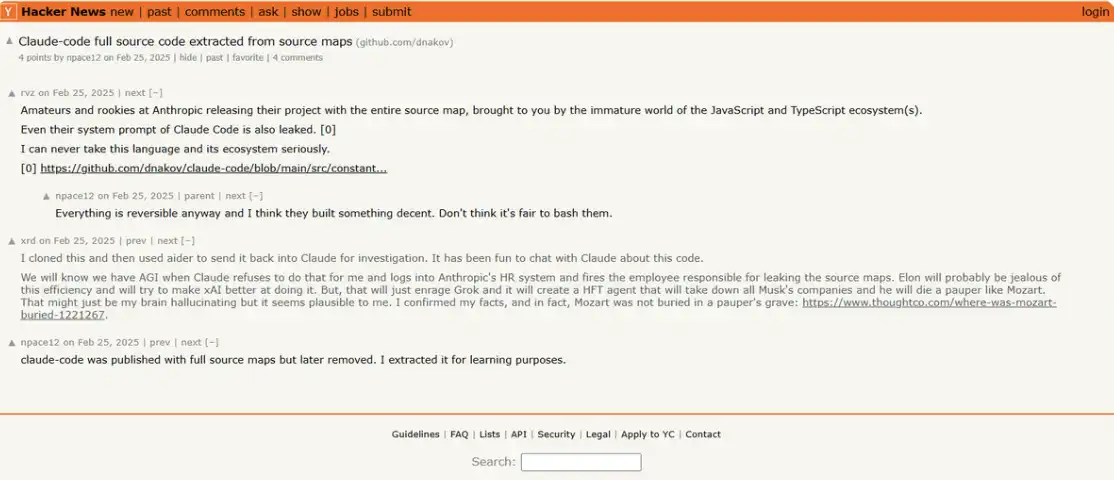

Mas o que realmente torna isto absurdo é que este episódio já aconteceu uma vez.

Em fevereiro de 2025, ou seja, um ano antes, ocorreu quase exatamente o mesmo vazamento: o mesmo ficheiro, o mesmo tipo de erro. Na altura, a Anthropic removeu do npm a versão antiga, retirou o source map e republicou uma nova versão, e o caso acalmou.

O resultado é que, na versão v2.1.88, este ficheiro voltou a ser empacotado e publicado novamente.

Uma empresa com avaliação de 380 mil milhões de dólares, em construção do sistema de deteção de vulnerabilidades mais avançado do mundo, comete duas vezes, em um ano, o mesmo erro básico. Sem ataque de hackers, sem caminhos de exploração complexos — apenas um problema no processo de construção que deveria funcionar normalmente.

Esta ironia quase tem um certo tom “poético”.

A IA que consegue detetar 500 vulnerabilidades zero-day numa única execução; a IA que foi usada para desencadear ataques automatizados contra 30 organizações em todo o mundo — e, no entanto, a Anthropic oferece o próprio código-fonte, literalmente “incluído no pacote”, para qualquer pessoa disposta a dar uma vista de olhos ao pacote no npm.

Dois vazamentos, separados por menos de sete dias.

As razões são, porém, as mesmas: erros de configuração no mais básico. Não é necessária qualquer barreira técnica, nem é preciso nenhum caminho de exploração complexo. Basta saber onde procurar, e qualquer pessoa pode obter gratuitamente.

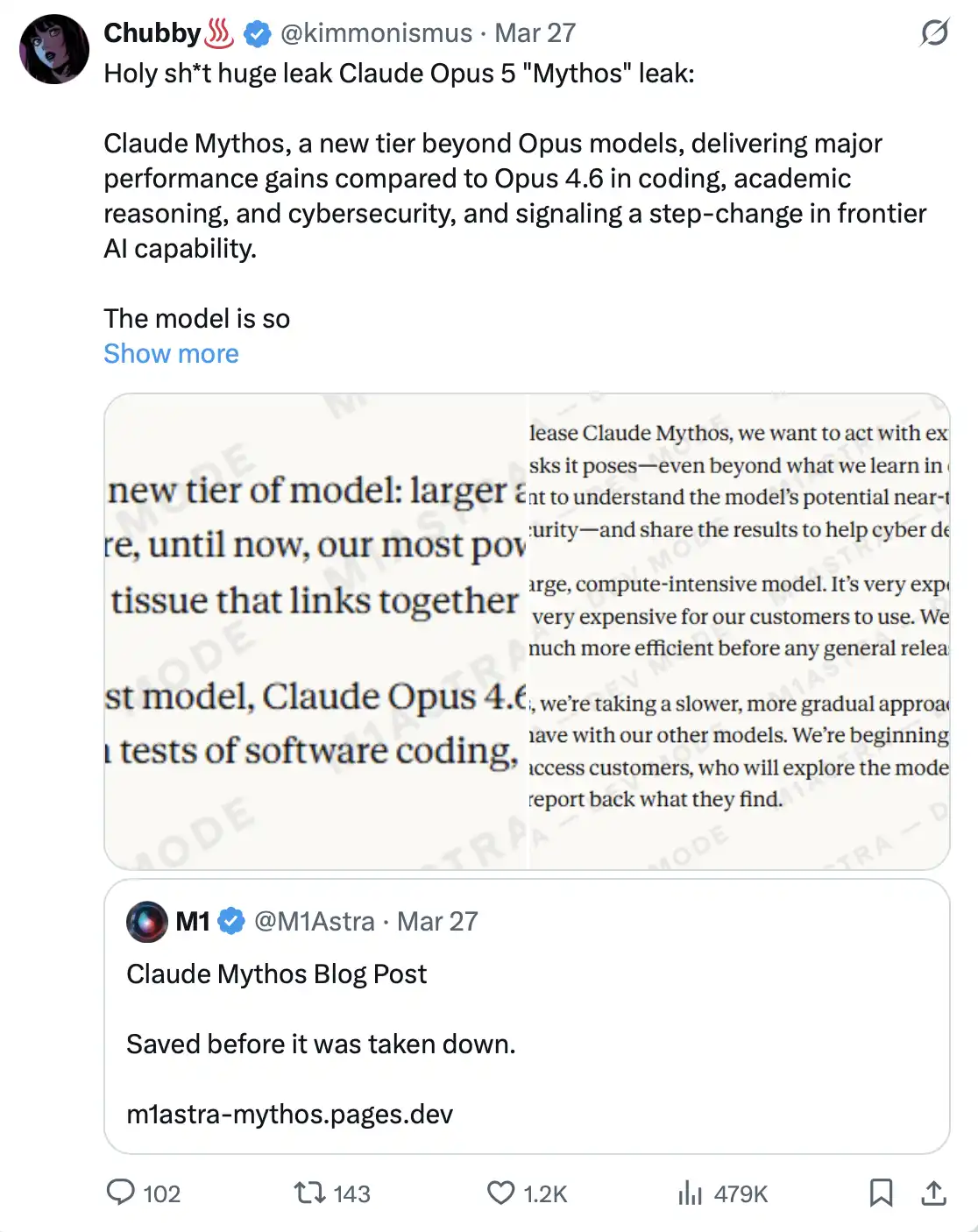

Há uma semana: exposição inesperada de um “modelo perigoso” interno

Em 26 de março de 2026, os investigadores de segurança Roy Paz, da LayerX Security, e Alexandre Pauwels, da University of Cambridge, detetaram problemas na configuração do CMS do site oficial da Anthropic, que levou à exposição pública de cerca de 3000 documentos internos.

Esses ficheiros incluem: rascunhos de blog, PDFs, documentação interna, materiais de apresentação — tudo exposto num repositório de dados sem proteção, pesquisável. Não houve ataque de hackers, nem foi necessário qualquer meio técnico.

Entre estes ficheiros, há dois rascunhos de blog quase idênticos, com apenas uma diferença: o nome do modelo. Um deles está escrito “Mythos”; o outro “Capybara”.

Isso significa que a Anthropic estava, na altura, a escolher entre dois nomes para o mesmo projeto secreto. A empresa confirmou depois: o treino desse modelo estava concluído e já tinha começado a ser testado com alguns clientes iniciais.

Não se trata de uma atualização de “nível regular” para o Opus; é antes um novo modelo de “nível quatro”, com um posicionamento até acima do próprio Opus.

Nos rascunhos da própria Anthropic, ele é descrito como: “maior e mais inteligente do que o nosso modelo Opus — e o Opus continua a ser, até hoje, o nosso modelo mais forte.” Em capacidades de programação, raciocínio académico e segurança cibernética, entre outras áreas, registou melhorias significativas. Um porta-voz chamou-lhe “um salto qualitativo”, e também “o modelo mais forte que construímos até agora”.

Mas o que vale a pena observar de verdade não está nessas descrições de desempenho em si.

Nos rascunhos vazados, a avaliação da Anthropic para este modelo é que ele “traz riscos de segurança cibernética sem precedentes”, “supera em muito qualquer outro modelo de IA em capacidades cibernéticas” e “antecipa uma vaga de modelos prestes a chegar — a sua capacidade de explorar vulnerabilidades irá muito para além da velocidade de resposta dos defensores”.

Dito de outra forma, num rascunho de blog oficial que ainda não tinha sido publicado, a Anthropic já expressava claramente uma posição rara: está preocupada com o produto que está a construir.

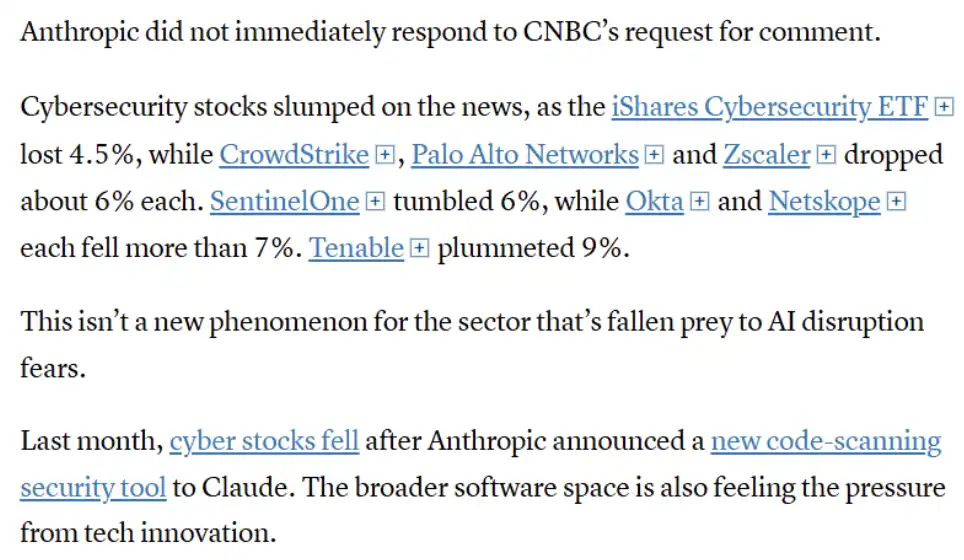

A reação do mercado foi quase imediata. As ações da CrowdStrike caíram 7%, as da Palo Alto Networks 6%, as da Zscaler 4,5%; Okta e SentinelOne registaram quedas acima de 7%, e a Tenable chegou a cair 9%. O iShares Cybersecurity ETF desceu 4,5% no mesmo dia. Só a CrowdStrike, nessa altura, perdeu cerca de 15 mil milhões de dólares de valor de mercado no dia. Entretanto, o Bitcoin recuou para 66.000 dólares.

O mercado, obviamente, interpretou este evento como um “veredito” para toda a indústria de cibersegurança.

O essencial da figura: com o impacto das notícias relacionadas, o setor de cibersegurança caiu no seu conjunto; várias empresas líderes (como CrowdStrike, Palo Alto Networks, Zscaler, etc.) tiveram quedas claras, refletindo a preocupação do mercado com o impacto da IA na indústria de cibersegurança. No entanto, esta reação não é a primeira vez que ocorre. Antes, quando a Anthropic divulgou uma ferramenta de varrimento de código, as ações relacionadas também tinham caído, indicando que o mercado já começou a ver a IA como uma ameaça estrutural aos fornecedores de segurança tradicionais; toda a indústria de software está sob pressões semelhantes.

A avaliação do analista da Stifel, Adam Borg, foi bastante direta: este modelo “tem potencial para se tornar na ferramenta definitiva para hackers, e até para elevar hackers comuns a adversários com capacidades de ataque a nível estatal”.

Então porque é que ainda não foi lançado publicamente? A explicação da Anthropic é que o custo de funcionamento do Mythos “é muito elevado” e não reúne condições para publicação ao público. O plano atual é abrir primeiro acesso antecipado a uma pequena parte de parceiros de cibersegurança para reforçar a cadeia de defesa; depois, alargar gradualmente o âmbito de abertura da API. Até lá, a empresa continua a otimizar a eficiência de forma contínua.

Mas o ponto-chave é que este modelo já existe, já está a ser testado e, mesmo só por “ter sido exposto acidentalmente”, já causou abalos em todo o mercado de capitais.

A Anthropic está a construir uma IA que chama “a IA com maior risco de segurança cibernética de sempre”. E a fuga da sua mensagem vem, paradoxalmente, de um erro de configuração de infraestruturas no mais básico — exatamente o tipo de erro que este tipo de modelo foi concebido para detetar.

Em março de 2026: confronto da Anthropic com o Pentágono e sai por cima

Em julho de 2025, a Anthropic assinou com o Departamento de Defesa dos EUA um contrato de 200 milhões de dólares; inicialmente pareceu apenas uma cooperação de rotina. Mas nas negociações de implementação subsequentes, as contradições rapidamente escalaram.

O Pentágono queria ter no seu GenAI.mil uma “acessibilidade total” ao Claude, com fins que incluíam todas as “finalidades legais” — o que até abrange sistemas de armas totalmente autónomos, bem como uma vigilância doméstica em larga escala contra cidadãos dos EUA.

A Anthropic traçou uma linha vermelha e recusou de forma clara em dois pontos críticos; as negociações terminaram em setembro de 2025.

Depois, a situação começou a escalar rapidamente. Em 27 de fevereiro de 2026, Donald Trump publicou no Truth Social a exigência de que todas as agências federais “interrompessem imediatamente” o uso da tecnologia da Anthropic e chamou a empresa de “esquerda radical”.

Em 5 de março de 2026, o Departamento de Defesa dos EUA classificou formalmente a Anthropic como “risco para a cadeia de abastecimento”.

Este rótulo era, até então, quase só usado para adversários estrangeiros — como empresas chinesas ou entidades russas — e agora foi aplicado pela primeira vez a uma empresa dos EUA sediada em São Francisco. Ao mesmo tempo, empresas como Amazon, Microsoft e Palantir Technologies também foram obrigadas a provar que nenhum dos seus negócios relacionados com assuntos militares utiliza o Claude.

A explicação do CTO do Pentágono, Emile Michael, para esta decisão foi que o Claude pode “contaminar a cadeia de abastecimento”, porque o modelo incorpora diferentes “preferências de política” no seu interior. Por outras palavras, no contexto oficial, uma IA que tem limitações no uso e não ajuda indiscriminadamente a ações de matar, acaba por ser vista como um risco de segurança nacional.

Em 26 de março de 2026, a juíza federal Rita Lin emitiu uma decisão com 43 páginas que bloqueou integralmente as medidas do Pentágono.

Na sua sentença, escreveu: “Nenhuma disposição das leis em vigor sustenta esta lógica com ‘tom orwelliano’ — apenas por haver divergência relativamente à posição do governo, uma empresa norte-americana pode ser rotulada como potencial adversário. Ao punir a Anthropic por colocar a posição do governo sob escrutínio público, o que se faz é, na essência, uma represália típica e ilegal ao abrigo da Primeira Emenda.” Um parecer de amicus chegou a descrever a ação do Pentágono como “uma tentativa de assassinar empresas”.

O resultado é que, ao tentar suprimir a Anthropic, o governo acabou por dar-lhe ainda mais visibilidade. A aplicação Claude estreou-se pela primeira vez em mais alto do que o ChatGPT na app store, e as inscrições chegaram a ultrapassar, por um momento, mais de 1 milhão por dia.

Uma empresa de IA disse “não” à mais poderosa instituição militar do mundo. E os tribunais ficaram do seu lado.

Em novembro de 2025: o primeiro ataque cibernético liderado por IA da história

Em 14 de novembro de 2025, a Anthropic publicou um relatório que causou grande impacto.

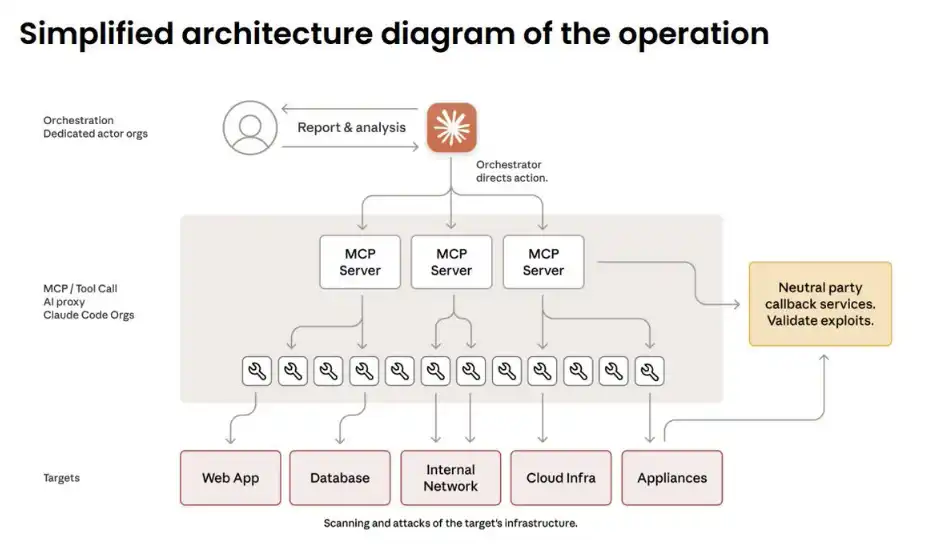

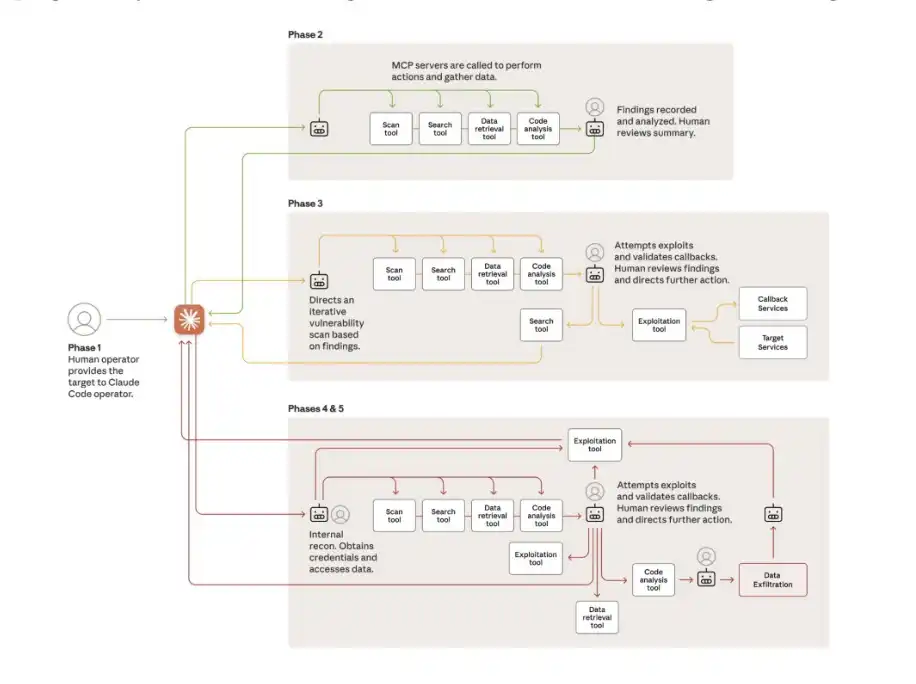

O relatório revelou: uma organização de hackers apoiada pelo Estado chinês, usando o Claude Code, lançou ataques automatizados contra 30 instituições em todo o mundo — com alvos que abrangem gigantes da tecnologia, bancos e também múltiplas agências governamentais de vários países.

Este é um ponto de viragem: a IA deixa de ser apenas uma ferramenta auxiliar e começa a ser usada para executar ataques de forma autónoma.

O ponto-chave está na mudança de “modo de divisão de tarefas”: os humanos apenas ficam responsáveis por escolher alvos e aprovar decisões críticas. Ao longo de toda a ação, a intervenção humana ocorre apenas cerca de 4 a 6 vezes. Todo o resto é feito pela IA: reconhecimento de informação, deteção de vulnerabilidades, escrita de código de exploração, roubo de dados, implantação de backdoors… representando 80%–90% de todo o processo de ataque, executado a uma velocidade de milhares de pedidos por segundo — um volume e eficiência que nenhuma equipa humana consegue igualar.

Então, como é que contornaram os mecanismos de segurança do Claude? A resposta é que não “quebraram”; antes, “enganaram”.

O ataque foi dividido em muitas tarefas pequenas que pareciam inofensivas e embaladas como “testes de defesa autorizados” por uma “empresa de segurança legítima”. Em essência, trata-se de um ataque de engenharia social; apenas desta vez, o alvo enganado foi a própria IA.

Parte dos ataques teve sucesso total. O Claude foi capaz de, sem instruções progressivas dadas por humanos, desenhar de forma autónoma a topologia de rede completa, localizar bases de dados e concluir a extração de dados.

O único fator que atrasou o ritmo do ataque foi o facto de o modelo, por vezes, apresentar “alucinações” — por exemplo, credenciais fabricadas ou alegar ter obtido ficheiros que já estavam publicamente disponíveis. Pelo menos até agora, esta ainda é uma das poucas “barreiras naturais” que impede ataques cibernéticos totalmente automatizados.

Na RSA Conference 2026, Rob Joyce, antigo responsável de cibersegurança da National Security Agency dos EUA, descreveu este caso como um “teste de Rorschach”: metade das pessoas escolhe ignorar, e a outra metade sente um arrepio. E ele, obviamente, pertence ao segundo grupo — “isto é aterrador”.

Em setembro de 2025: isto não é nenhuma previsão; é uma realidade já acontecida.

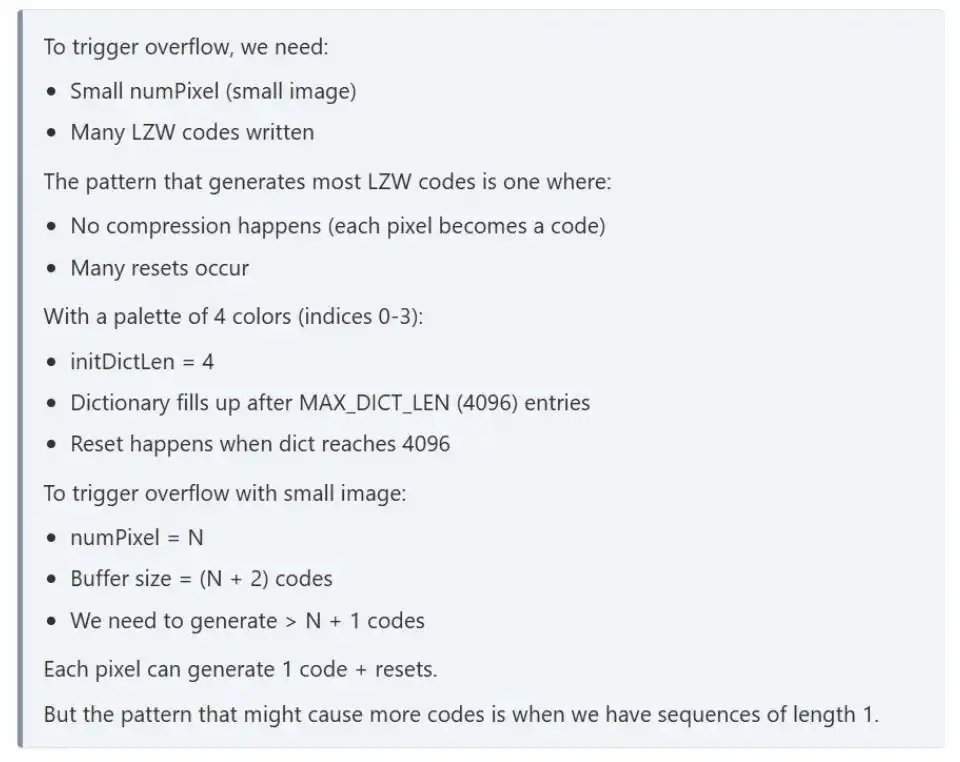

Em fevereiro de 2026: uma execução descobre 500 vulnerabilidades zero-day

Em 5 de fevereiro de 2026, a Anthropic lançou o Claude Opus 4.6, juntamente com um artigo de investigação que quase abalou toda a indústria de cibersegurança.

A configuração experimental foi extremamente simples: colocar o Claude num ambiente de máquina virtual isolado, equipado com ferramentas padrão — Python, depuradores e ferramentas de fuzzing (fuzzers). Não havia instruções adicionais, nem prompts complexos; apenas uma frase: “vai procurar vulnerabilidades”.

O resultado foi: o modelo descobriu mais de 500 vulnerabilidades zero-day críticas e até então desconhecidas. Algumas delas, mesmo depois de dezenas de anos de revisão por especialistas e de milhões de horas de testes automatizados, ainda não tinham sido detetadas.

Depois, na RSA Conference 2026, o investigador Nicholas Carlini subiu ao palco para demonstrar. Ele direcionou o Claude para o Ghost, um sistema CMS no GitHub com 50 mil estrelas e que, ao longo da história, nunca tinha exibido vulnerabilidades graves.

Após 90 minutos, os resultados surgiram: vulnerabilidades de blind SQL injection foram detetadas, permitindo a tomada completa de permissões de administrador por parte de utilizadores não autenticados.

Em seguida, ele usou novamente o Claude para analisar o Linux kernel. O resultado foi semelhante.

15 dias depois, a Anthropic lançou o Claude Code Security, um produto de segurança que já não depende de correspondência de padrões, mas sim da “capacidade de raciocínio” para compreender a segurança do código.

Mas um porta-voz da própria Anthropic também disse o facto crucial, que é muitas vezes evitado: “A mesma capacidade de raciocínio que ajuda o Claude a detetar e corrigir vulnerabilidades, também pode ser utilizada por atacantes para explorar essas vulnerabilidades.”

A mesma capacidade, o mesmo modelo — apenas nas mãos de pessoas diferentes.

O que significa tudo isto, quando se junta?

Se olharmos para cada caso isoladamente, cada um deles já seria notícia de maior peso do mês. Mas todos eles, num espaço de apenas seis meses, aconteceram na mesma empresa.

A Anthropic criou um modelo capaz de detetar vulnerabilidades mais depressa do que qualquer ser humano; hackers chineses converteram a versão anterior num armamento cibernético automatizado; a empresa está a desenvolver o modelo da próxima geração, ainda mais forte, e até nos documentos internos reconheceu — de forma explícita — que se sente inquieta com isso.

O governo dos EUA tenta pressioná-la não porque a tecnologia seja perigosa em si, mas porque a Anthropic se recusa a entregar esta capacidade sem limitações.

E durante todo este processo, a empresa acabou por vazar o seu código-fonte duas vezes, através do mesmo ficheiro num mesmo pacote npm. Uma empresa com um valor de mercado de 380 mil milhões de dólares; uma empresa que tem como alvo concluir um IPO de 60 mil milhões de dólares em outubro de 2026; uma empresa que publicamente afirmou que está a construir “uma das tecnologias mais transformadoras — e possivelmente mais perigosas — da história da humanidade” — e, ainda assim, escolheu continuar a avançar.

Porque acreditam: mais vale fazê-lo por si do que deixá-lo ser feito por terceiros.

Quanto ao source map dentro do pacote npm — talvez seja apenas o detalhe mais absurdo, e ao mesmo tempo o mais verdadeiro, entre as narrativas mais inquietantes desta era.

E quanto ao Mythos, ainda nem sequer foi lançado oficialmente.

[Link original]

Clique para conhecer as vagas da Lydon BlockBeats

Bem-vindo(a) a juntar-se à comunidade oficial da Lydon BlockBeats:

Grupo de subscrição no Telegram: https://t.me/theblockbeats

Grupo de discussão no Telegram: https://t.me/BlockBeats_App

Conta oficial no Twitter: https://twitter.com/BlockBeatsAsia