Máy tính của tôi có thể chạy mô hình AI cục bộ không? CanIRun.ai giúp bạn phân tích nhanh chóng

AI 工具 CanIRun.ai có thể tự động phát hiện cấu hình phần cứng của người dùng qua trình duyệt, giúp ước lượng các mô hình LLM có thể chạy và tốc độ suy luận, người dùng quan tâm có thể thử và tìm hiểu.

(Tiền đề: Clawdbot thần thánh, một quản gia AI 24/7 giúp Mac mini bán hết hàng)

(Bổ sung nền: Đừng theo đuổi OpenClaw một cách mù quáng, AI tôm hùm rất mạnh nhưng không nhất thiết phù hợp với bạn)

Mục lục bài viết

Toggle

- Nhược điểm nhỏ của Canirun.ai

- Giải pháp thay thế dòng lệnh llmfit ra mắt

- Những gì cộng đồng mong muốn nhất

Bạn có muốn tự cài đặt mô hình ngôn ngữ lớn (LLM) trên máy của mình không? Vấn đề phổ biến nhất của người mới bắt đầu là: Máy tính của tôi, thực sự có thể chạy được mô hình nào? Bài viết này giới thiệu một công cụ gần đây gây tranh luận trong cộng đồng Hacker News: CanIRun.ai.

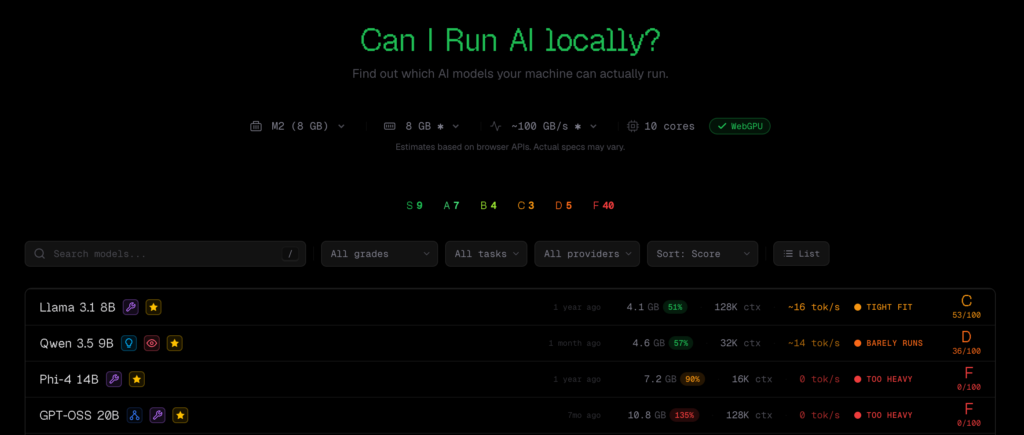

CanIRun.ai là một công cụ hoàn toàn dựa trên web, thao tác rất đơn giản: bạn chỉ cần mở trình duyệt, nó sẽ tự động sử dụng API WebGPU để phát hiện loại GPU và dung lượng bộ nhớ của bạn, sau đó dựa trên số lượng tham số của các mô hình, cấp độ lượng tử (Q4_K_M, Q8_0, F16, v.v.) và băng thông bộ nhớ để ước lượng khả năng thực thi và tốc độ suy luận (token/s) của từng mô hình, và hiển thị kết quả theo thang điểm từ S đến F.

Phạm vi bao gồm từ mô hình siêu nhẹ 0.8B tham số đến mô hình khổng lồ MoE (Mixture of Experts, kiến trúc trộn chuyên gia) 1T tham số, dữ liệu lấy từ các công cụ suy luận cục bộ phổ biến như llama.cpp, Ollama và LM Studio.

Nhược điểm nhỏ của Canirun.ai

Dù ý tưởng của công cụ nhận được sự ủng hộ của cộng đồng, nhưng cũng có một số ý kiến phê bình. Chủ yếu tập trung vào hai vấn đề: thiếu sót trong danh sách phần cứng và chênh lệch giữa ước lượng và thực tế.

Vấn đề phổ biến nhất là thiếu danh sách phần cứng. Các dòng RTX Pro 6000, RTX 5060 Ti 16GB, các GPU laptop của các hãng hiện chưa có trong danh sách. Về chip Apple, dù có liệt kê, nhưng chỉ tối đa 192GB bộ nhớ, trong khi M3 Ultra thực tế hỗ trợ tới 512GB.

Vấn đề sai số ước lượng cũng khá phổ biến: có người thử nghiệm thực tế và kết quả không khớp với kết quả của CanIRun.ai. Những trường hợp “chạy được nhưng trang web nói không” này thường xuyên xuất hiện trong các thảo luận, khiến một số người dùng bỏ qua kết quả của công cụ này.

Dù còn nhiều điểm có thể cải thiện, nhưng đối với người mới bắt đầu, công cụ này vẫn giúp nhanh chóng xác nhận thiết bị của mình.

Giải pháp thay thế dòng lệnh llmfit ra mắt

Trong cộng đồng còn có người đề xuất công cụ thay thế là llmfit: đây là một chương trình dòng lệnh, có thể gọi trực tiếp các công cụ hệ thống (bao gồm nvidia-smi) để lấy chính xác thông tin GPU, không phụ thuộc vào API trình duyệt, nhiều người cho rằng nó tiện dụng và chính xác hơn so với phiên bản web.

Tuy nhiên, llmfit cũng đặt ra một vấn đề khác: có người dùng ngạc nhiên khi biết rằng nó có thể xác định chính xác loại GPU mà không cần yêu cầu quyền truy cập rõ ràng. Điều này chạm đến vấn đề nhạy cảm về nhận dạng dấu vân tay trình duyệt và quyền riêng tư phần cứng: nếu một công cụ web có thể phát hiện card đồ họa của bạn qua API WebGPU, dữ liệu này sẽ được sử dụng như thế nào?

Có người đề xuất rằng, chức năng này lý tưởng nhất là tích hợp trực tiếp vào Ollama, để người dùng có thể tự động chọn mô hình phù hợp dựa trên phần cứng của máy từ dòng lệnh, tránh việc phải tìm kiếm thủ công.

Những gì cộng đồng mong muốn nhất

Phản hồi từ cộng đồng cho thấy, giới hạn chính của CanIRun.ai không chỉ nằm ở độ chính xác ước lượng, mà còn ở việc đánh giá quá đơn giản. Người dùng thực sự muốn biết là: trên phần cứng của tôi, mô hình nào có chất lượng tốt nhất và tốc độ chấp nhận được? Hiện tại, công cụ chỉ trả lời được câu hỏi “có thể chạy được hay không”, còn không thể trả lời “chạy có đủ tốt không”.

Cộng đồng hy vọng trong tương lai sẽ có thêm điểm chuẩn đánh giá năng lực của mô hình, kết hợp với ước lượng phần cứng, để cung cấp cơ sở lựa chọn toàn diện hơn. Các hướng cải tiến kỹ thuật khác bao gồm: tích hợp chiến lược chia sẻ bộ nhớ CPU (giúp GPU thiếu bộ nhớ có thể mượn bộ nhớ hệ thống), hỗ trợ kỹ thuật giảm tải KV cache, và sửa lỗi logic tính toán của các mô hình MoE.

Tổng thể, hướng đi của công cụ là đúng, và thị trường cũng có nhu cầu rõ ràng: rào cản để sử dụng AI cục bộ vẫn còn cao đối với người dùng phổ thông, việc nhanh chóng xác định “máy của tôi phù hợp chạy mô hình nào” là nhu cầu cấp thiết. CanIRun.ai đã chạm vào điểm này, chỉ là còn cần thêm nhiều hoàn thiện.