OpenAI veröffentlicht GPT-5.4 Mini und Nano: Geschwindigkeit verdoppelt, speziell für das Zeitalter von KI-Sub-Agenten konzipiert, ab nur $0.2 pro Million Token

OpenAI am heutigen (18.) Tag offiziell zwei leichte neue Modelle vorgestellt: GPT-5.4 Mini und GPT-5.4 Nano. Erstere ist doppelt so schnell wie die Vorgängerversion, kostet nur 0,75 USD pro Million Eingabe-Tokens, während letztere mit extrem niedriger Latenz und einem wettbewerbsfähigen Preis von 0,20 USD auf den Hochdurchsatzmarkt abzielt.

(Frühere Meldung: OpenAI veröffentlicht GPT-5.2! Ziel: professionelle Nutzer ersetzen, weniger Halluzinationen, API-Preise im Überblick)

(Hintergrund: Zusammenfassung der OpenAI GPT-5 Präsentation: Kostenloser Zugang, Funktions-Highlights, gpt-5, gpt-5-mini und gpt-5-nano API-Preise)

Inhaltsverzeichnis

Toggle

- GPT-5.4 Mini: 2-fache Geschwindigkeit, vielseitiger leichter Allrounder

- GPT-5.4 Nano: extrem niedrige Latenz, für Hochdurchsatz-Szenarien

- Sub-Agenten-Architektur: Kleine Modelle sind kein Downgrade, sondern Teil des Systemdesigns

OpenAI hat am heutigen (18.) Tag um Mitternacht gleichzeitig die beiden kleinen Sprachmodelle GPT-5.4 Mini und GPT-5.4 Nano veröffentlicht. Diese Modelle sind keine Flaggschiff-Modelle, sondern wurden explizit als Ausführungsebene in einem hybriden KI-System konzipiert: Von leistungsstärkeren Flaggschiff-Modellen koordiniert, führen zahlreiche kleine Modelle im Hintergrund parallele Berechnungen für den Alltag durch.

OpenAI bezeichnet dieses System als „signifikanten Geschwindigkeits- und Kostenvorteil durch teilweise Genauigkeit“, was den aktuellen Trend in der KI-Branche widerspiegelt: vom Einzelmodell hin zu „Multi-Agenten-Kollaboration“.

GPT-5.4 Mini: 2-fache Geschwindigkeit, vielseitiger leichter Allrounder

GPT-5.4 Mini ist das Kernprodukt dieser Veröffentlichung, das auf Geschwindigkeit und Multitasking-Fähigkeit ausgelegt ist. Im Vergleich zum Vorgänger ist die Inferenztaktung um das Doppelte gestiegen, und es wurden umfassende Verbesserungen bei Code-Generierung, Multimodal-Verständnis und Tool-Calls erzielt.

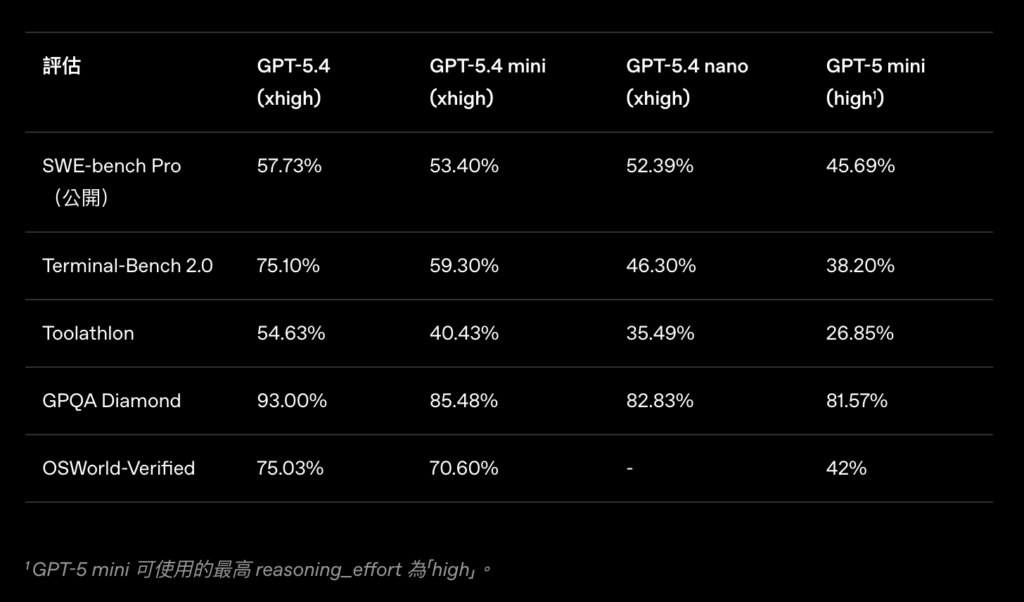

In Benchmark-Tests erreicht GPT-5.4 Mini 54,4 % bei SWE-Bench Pro (automatisierte Fehlerbehebung bei GitHub-Issues) und 72,1 % bei OSWorld-Verified (automatisierte Desktop-Operationen), was beide führende Werte in der jeweiligen Klasse sind.

Auf Funktionsebene unterstützt es Text- und Bild-Mix-Inputs, Tool-Calls, Internet- und Dateisuche sowie UI-Interaktionen bei Computeranwendungen, was nahezu alle Anforderungen moderner KI-Anwendungen abdeckt. Die wichtigsten Anwendungsfälle laut OpenAI sind: Programmierassistenten, IDE-Integration, Code-Review, Screenshot-Interpretation, Computer-Sub-Agenten sowie interaktive Systeme mit Echtzeit-Response.

Preislich liegt GPT-5.4 Mini bei 0,75 USD pro Million Tokens für Eingaben und 4,50 USD für Ausgaben, was die jüngste Strategie von OpenAI widerspiegelt, die Kosten aktiv zu senken.

Verfügbar ist GPT-5.4 Mini ab sofort in ChatGPT (kostenlose und Go-Abonnements), Codex und OpenAI API, außerdem kann es via Azure AI Foundry bereitgestellt werden.

GPT-5.4 Nano: extrem niedrige Latenz, für Hochdurchsatz-Szenarien

GPT-5.4 Nano ist klar positioniert: OpenAI nennt es „das derzeit kleinste und kosteneffizienteste Modell“, speziell für Szenarien, die extrem empfindlich auf Latenz reagieren und große parallele Verarbeitung erfordern.

In Benchmark-Tests erzielt Nano 52,4 % bei SWE-Bench Pro und 39,0 % bei OSWorld, etwas niedriger als Mini, aber bei seinem extrem günstigen Preis-Leistungs-Verhältnis sehr attraktiv.

Funktional umfasst Nano Befehlsnachverfolgung, Funktionsaufrufe, Grundcode, Bildverständnis, Klassifikation und Datenextraktion. Es kann die meisten strukturierten Aufgaben bewältigen, unterstützt jedoch keine komplexen Desktop-Operationen oder tiefgehende Schlussfolgerungen.

Preislich kostet die Eingabe nur 0,20 USD pro Million Tokens, die Ausgabe 1,25 USD – etwa ein Viertel des Mini-Preises – und eignet sich für Unternehmen mit hohem Automatisierungsbedarf. Anwendungsbeispiele sind: Klassifikation und Datenextraktion, Code-Sub-Agenten, Hochautomatisierung, Request-Routing, Formularverarbeitung und Kundenservice-Workflows.

Wichtig: GPT-5.4 Nano ist derzeit nur via API zugänglich und erscheint nicht in der ChatGPT-Benutzeroberfläche, sondern ist klar für Entwickler und Unternehmenskunden gedacht.

Sub-Agenten-Architektur: Kleine Modelle sind kein Downgrade, sondern Teil des Systemdesigns

Der Slogan von OpenAI lautet: „Für das Zeitalter der Sub-Agenten geboren“. Dahinter steckt eine konkrete Produktlogik.

In Multi-Agenten-KI-Systemen steuert das Flaggschiff-Modell (z.B. GPT-5 oder o-Serie) die Hochstufung und komplexe Entscheidungen, während eine Vielzahl repetitiver, strukturierter Sub-Aufgaben – Web-Scraping, Datenumwandlung, Formularausfüllung, Code-Fragment-Generierung – von kleineren, schnelleren und günstigeren Modellen parallel abgearbeitet werden. GPT-5.4 Mini und Nano sind genau für diese Ausführungsebene konzipiert.

Dieses Konzept erklärt auch, warum beide Modelle Tool-Calls und Computer-Interaktionen betonen: In einer zunehmend automatisierten KI-Anwendungsarchitektur haben kleine Modelle, die zuverlässig Befehle ausführen und mit externen Systemen interagieren können, einen Wert, der mit größeren Flaggschiff-Modellen vergleichbar ist.