GPT-5.4 Mini online! Betriebsgeschwindigkeit verdoppelt, kleine Modelle noch praktischer

OpenAI am 18. März GPT-5.4 Mini und GPT-5.4 Nano veröffentlicht, zwei leichtgewichtige Modelle, die speziell für hochvolumige KI-Arbeitslasten entwickelt wurden, und iterieren erneut weniger als zwei Wochen nach der Veröffentlichung der GPT-5.4-Flaggschiffversion. GPT-5.4 Mini ist doppelt so schnell wie der Vorgänger GPT-5 Mini, während GPT-5.4 Nano für Echtzeit-Dialoge zu geringeren Kosten optimiert wurde.

Kernlogik kleiner Modelle: Genauigkeit ist nicht immer die größte Hürde

OpenAI positioniert GPT-5.4 Mini und Nano als „die bisher leistungsstärksten kleinen Modelle“, doch das bedeutet nicht, dass sie eine abgespeckte Version des Flaggschiffs sind. Sie basieren auf unterschiedlichen Designprioritäten: Wenn die tatsächliche Engstelle bei Aufgaben Geschwindigkeit und Kosten sind, nicht die Tiefe der Schlussfolgerungen, sind kleinere Modelle oft praktischer.

Am Beispiel eines Kundendienstsystems: Wenn täglich 200 standardisierte Fragen beantwortet werden, ist der marginale Nutzen von Doktor-ähnlicher Schlussfolgerungsfähigkeit nahezu null. Entscheidend ist, dass die Antwortzeit unter einer Sekunde liegt und die Kosten pro Antwort nur Bruchteil eines Cents betragen, um eine Skalierung des Systems zu ermöglichen.

Derzeit ist eine effiziente Arbeitsablaufarchitektur: Das Flaggschiffmodell (wie GPT-5.4) übernimmt Aufgabenplanung und Koordination, während Mini oder Nano parallel eine Vielzahl repetitiver Unteraufgaben erledigen — beispielsweise Code-Suche, Dokumentenlesen oder Formularverarbeitung. Jerry Ma, stellvertretender CTO bei Perplexity, sagte nach Tests: „Mini-Modelle sind leistungsstark bei Schlussfolgerungen, Nano ist schnell und effizient, ideal für Echtzeit-Dialogprozesse.“

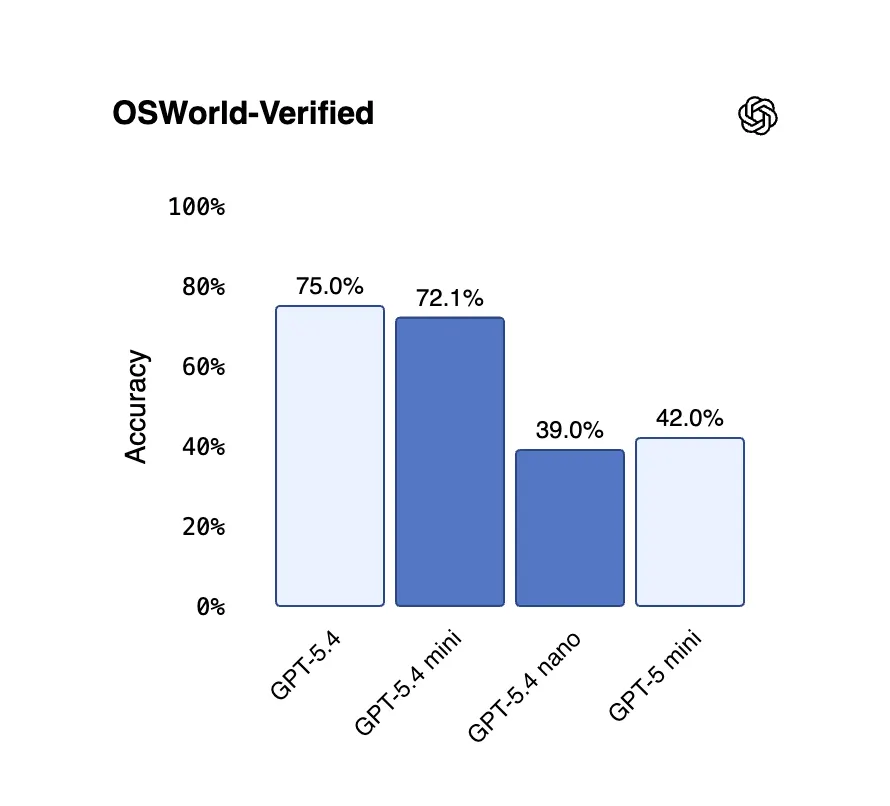

Benchmark-Daten: Mini übertrifft menschliche Computer-Operationen

(Quelle: OpenAI)

(Quelle: OpenAI)

Laut öffentlich verfügbaren Benchmark-Daten nähert sich GPT-5.4 Mini der Flaggschiff-Leistung an:

SWE-Bench Pro (Bewertung der Fähigkeit, tatsächliche GitHub-Codeprobleme zu beheben): GPT-5.4 Mini 54,4%; alte GPT-5 Mini 45,7%; GPT-5.4 Flaggschiff 57,7%

OSWorld-Verified (Bewertung der Fähigkeit, tatsächliche Desktop-Operationen anhand von Screenshots durchzuführen): Mini 72,1%; GPT-5.4 Flaggschiff 75,0%; menschliche Benchmark 72,4% — Mini hat die menschliche Benchmark übertroffen.

GPT-5.4 Nano: SWE-Bench Pro 52,4%, OSWorld-Verified 39,0%, niedriger als Mini, aber im Vergleich zur Vorgängerserie Nano ein bedeutender Fortschritt.

Diese Daten zeigen: In Szenarien, die Desktop-Operationen oder Codebearbeitung erfordern, kommt Mini fast an das Flaggschiff heran; Nano ist zwar weniger genau, bietet aber bei Echtzeitanforderungen einen einzigartigen Kosten-Nutzen-Vorteil.

Preismodell und Verfügbarkeit: Entwickler vs. Allgemeine Nutzer

API-Preise: GPT-5.4 Mini kostet 0,75 USD pro Million Eingabe-Tokens, 4,50 USD pro Million Ausgabe-Tokens; GPT-5.4 Nano kostet 0,20 USD pro Million Eingabe-Tokens, 1,25 USD pro Million Ausgabe-Tokens — Nano ist etwa ein Viertel der Kosten von Mini bei Eingaben.

Nutzerzugang: GPT-5.4 Mini ist für ChatGPT Free und Go Nutzer verfügbar und kann über das „+“-Menü unter „Denken“ genutzt werden; zahlende Nutzer, die das Nutzungslimit für GPT-5.4 erreichen, werden automatisch auf Mini umgestellt. GPT-5.4 Nano ist derzeit nur via API zugänglich und richtet sich an Entwickler, nicht direkt an Verbraucher.

Häufig gestellte Fragen

Was sind die Hauptunterschiede zwischen GPT-5.4 Mini und GPT-5.4 Flaggschiff?

GPT-5.4 Mini ist in der Geschwindigkeit mehr als doppelt so schnell wie der Vorgänger GPT-5 Mini, erreicht im OSWorld-Verified-Test 72,1%, knapp unter der menschlichen Benchmark von 72,4%, und liegt nur knapp unter dem Flaggschiff mit 75,0%. Der Hauptunterschied liegt in der Tiefe der Schlussfolgerungen und der Fähigkeit, komplexe Aufgaben zu bewältigen. Die Geschwindigkeit und Kosteneffizienz machen Mini in vielen repetitiven Aufgaben praktischer.

Was ist die beste Anwendung für GPT-5.4 Nano?

GPT-5.4 Nano ist als Entwickler-Tool für APIs konzipiert und eignet sich am besten für Echtzeit-Dialoge, z. B. Kundenservice oder große automatisierte Abfragen im Alltag. Mit einem Eingabepreis von nur 0,20 USD pro Million Tokens ist es wirtschaftlich für groß angelegte Deployments in Start-ups.

Wie kann man GPT-5.4 Mini in ChatGPT verwenden?

GPT-5.4 Mini ist für ChatGPT Free und Go Nutzer zugänglich und kann im ChatGPT-Interface über das „+“-Menü unter „Denken“ genutzt werden. Bei Erreichen des Nutzungslimits für GPT-5.4 wird automatisch auf Mini umgestellt.