Die KI-Branche hat ihren eigenen Satoshi Nakamoto – Jensen Huang

Autor: Luo Yihang, Silicon-Basis-Position

Das Token, das wir früher nur sehen konnten, weil wir daran glaubten, ist jetzt sichtbar, ohne zu glauben. Es ist das Nächste nach Watt, Ampere und Bit.

Im Januar 2009 erfand ein Anonymer eine Sache namens „Token“: Du investierst Rechenleistung, erhältst Token, die in einem Konsensnetzwerk zirkulieren, bewertet und gehandelt werden. So entstand die gesamte Kryptoökonomie. Über ein Jahrzehnt später streiten die Menschen immer noch darüber, ob diese Token einen Wert haben.

Im März 2025 redefiniert ein Mann in Lederjacke eine andere Art von Token. Du investierst Rechenleistung, produzierst Token, die in einem AI-Inferenz- (Inference & Reasoning) Prozess sofort verbraucht werden: Denken, Schlussfolgern, Code schreiben, Entscheidungen treffen. Damit beschleunigt sich die AI-Wirtschaft. Niemand streitet mehr darüber, ob diese Token wertvoll sind, denn heute Morgen hast du bereits Millionen davon verbraucht.

Zwei Arten von Token, derselbe Name, dieselbe Grundstruktur: Rechenleistung rein, wertvolle Dinge raus.

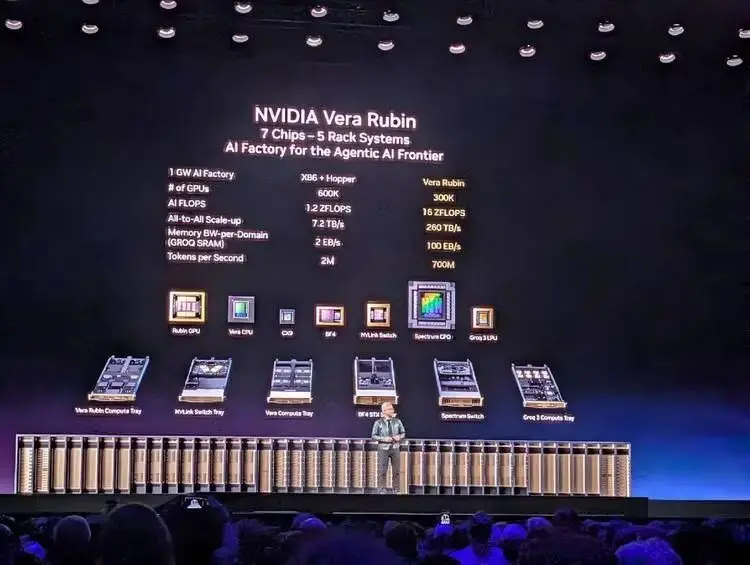

Im März 2026 sitze ich auf der NVIDIA GTC-Konferenz und höre eine fast werbefreie Keynote von Jensen Huang. Ja, er hat Vera Rubin vorgestellt, ein Produkt, das CPU und GPU kombiniert. Aber diesmal spricht er nicht über Chipspezifikationen oder Fertigungstechnologien, sondern über eine vollständige Wirtschaftslehre rund um Token-Produktion, -Bewertung und -Verbrauch—

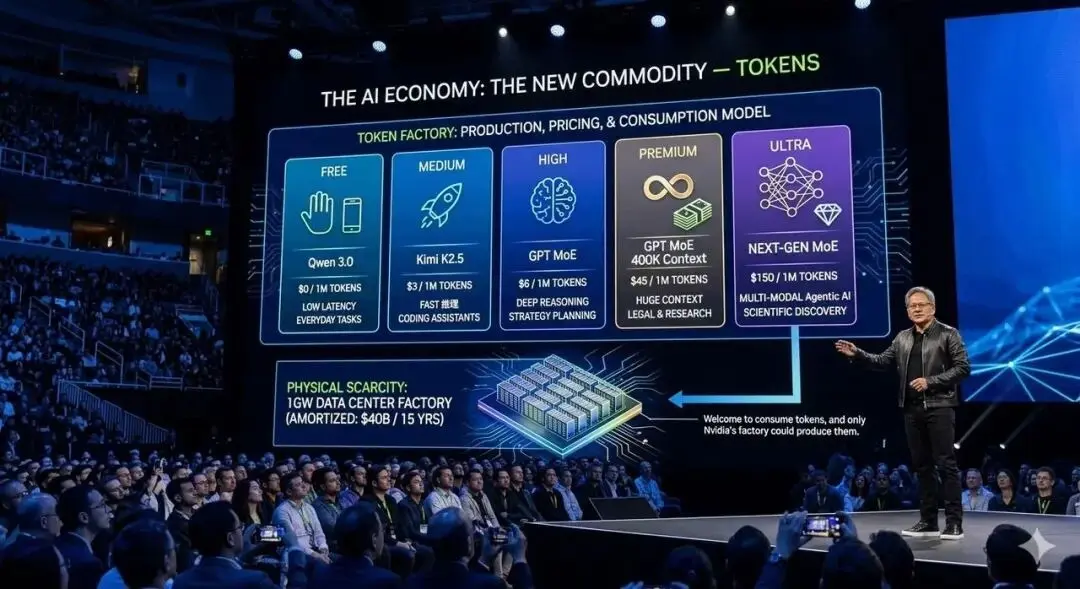

Welches Modell, welche Token-Geschwindigkeit; welche Token-Geschwindigkeit, welche Preisspanne; welche Preisspanne erfordert welche Hardwarestufe zur Unterstützung.

Er hat sogar den CEOs und Entscheidungsträgern im Saal eine Verteilung der Rechenkapazitäten für Rechenzentren vorgeschlagen: 25 % für die kostenlose Ebene, 25 % für die Mittelklasse, 25 % für die High-End, 25 % für die Premium-Schicht.

Ja, diesmal verkauft er kein konkretes GPU-Modell, ähnlich wie vor zwei Jahren mit Blackwell. Aber diesmal verkauft er etwas Größeres. Nach zwei Stunden denke ich, dass er eigentlich nur sagen will: Willkommen beim Token-Verbrauch, und nur Nvidias Fabrik kann das produzieren.

In diesem Moment erkenne ich, dass dieser Mann und der Anonyme vor 17 Jahren, der das erste Token geschürft hat, im Wesentlichen dasselbe tun.

Dieselbe Transformationsregel

Der Anonyme, der sich „Satoshi Nakamoto“ nannte, schrieb 2008 ein neungängiges Whitepaper und entwarf eine Regel: Rechenleistung investieren, eine mathematische Beweisführung (Proof of Work) vollenden, dafür Crypto-Token als Belohnung erhalten.

Das Raffinierte an dieser Regel ist, dass niemand Vertrauen braucht—solange du diese Regeln akzeptierst, bist du automatisch Teilnehmer an dieser Wirtschaft. Diese Regel ist richtig, weil sie viele Betrüger zusammenbringt.

Und Huang Huang tut auf der GTC 2026 genau dasselbe.

Er zeigt eine Grafik, die die Beziehung und Spannung zwischen Inferenz-Effizienz und Token-Verbrauch verdeutlicht: Die Y-Achse ist Durchsatz (wie viele Token pro Megawatt), die X-Achse ist Interaktivität (wie schnell Nutzer Token wahrnehmen). Darunter markiert er fünf Preisspannen: Kostenlos mit Qwen 3, $0/Million Token; Mittelklasse mit Kimi K2.5, $3/Million Token; Hoch mit GPT MoE, $6/Million Token; Premium mit GPT MoE 400K Kontext, $45/Million Token; Ultra, $150/Million Token.

Dieses Diagramm könnte fast das Cover des Whitepapers zu Huang Huangs „Token-Ökonomie“ sein.

Satoshi Nakamoto definierte „was wertvolle Berechnungen sind“—das Erreichen eines SHA-256 Hash-Kollisions ist wertvoll. Huang Huang definiert „was wertvolle Inferenz ist“—unter gegebenen Energieeinschränkungen, bei bestimmter Geschwindigkeit für bestimmte Szenarien Token zu produzieren, ist wertvoll.

Satoshi Nakamoto und Huang Huang produzieren keine Token direkt; sie definieren die Regeln für die Token-Produktion und die Preisgestaltung.

Huang Huang sagt auf der Bühne fast eine Aussage, die direkt in die Zusammenfassung des Whitepapers zur Token-Ökonomie geschrieben werden könnte—

Tokens sind die neue Ware, und wie alle Waren, wird sie, sobald sie einen Wendepunkt erreicht und reift, in verschiedene Segmente aufgeteilt.

Token sind die neue Rohware. Nach der Reife der Rohstoffe erfolgt eine natürliche Schichtung. Er beschreibt nicht den Status quo, sondern prognostiziert eine Marktstruktur und legt seine Hardware-Produktlinie exakt in jede Schicht dieser Struktur.

Die Produktionsprozesse der beiden Token-Typen sind sogar semantisch symmetrisch: Mining heißt mining, Inferenz heißt inference.

Das Wesentliche von Mining und Inferenz ist, dass sie beide Strom in Geld verwandeln. Miner verbrauchen Strom, um Crypto-Token zu schürfen, verkaufen sie dann; Inferenzmodelle und AI-Agenten verbrauchen Strom, um AI-Token zu erzeugen, die sie dann für Entwickler zu einem Preis pro Million verkaufen. Der Unterschied liegt im Zwischenstück, aber beide Enden sind gleich: links die Stromzähler, rechts die Einnahmen.

Zwei Arten von Knappheit

Die wichtigste Designentscheidung von Satoshi Nakamoto ist nicht Proof of Work, sondern die Obergrenze von 21 Millionen Bitcoin. Mit Code wurde künstliche Knappheit geschaffen—egal wie viele Miner hinzukommen, die Gesamtzahl wird niemals 21 Millionen übersteigen. Diese Knappheit ist das Wertanker der gesamten Kryptoökonomie.

Huang Huang schafft natürliche Knappheit durch physikalische Gesetze. Er sagt:

„Du musst immer noch ein Gigawatt-Rechenzentrum bauen. Du musst immer noch eine Gigawatt-Fabrik bauen, und diese eine Gigawatt-Fabrik, über 15 Jahre abgeschrieben… kostet etwa 40 Milliarden Dollar, selbst wenn du nichts darin investierst. Es sind 40 Milliarden Dollar. Du solltest verdammt noch mal sicherstellen, dass du das beste Computersystem auf diese Anlage setzt, damit du die besten Token-Kosten hast.“

Ein 1-GW-Rechenzentrum wird niemals zu 2 GW. Das ist kein Code-Limit, sondern Physik.

Land, Strom, Kühlung—alle haben physikalische Grenzen. Das Gebäude, das du für 400 Dollar pro Quadratmeter gebaut hast, produziert in 15 Jahren, was die Token-Menge betrifft, nur so viel, wie die Architektur darin vorsieht.

Satoshi Nakamotos Knappheit kann geforkt werden. Wenn man die Obergrenze von 21 Millionen nicht mag, kann man eine neue Chain fork, auf 200 Millionen ändern, sie Ethereum oder was auch immer nennen, und eine neue Whitepaper veröffentlichen. Das haben die Leute auch gemacht, mit Begeisterung.

Aber die Knappheit, die Huang Huang schafft, kann nicht geforkt werden. Man kann nicht die Zweite Gesetz der Thermodynamik, das Stromnetz einer Stadt oder die physische Fläche eines Landes forken.

Doch egal ob Satoshi Nakamoto oder Huang Huang, ihre Schaffung von Knappheit führt zum gleichen Ergebnis: Wettlauf um Hardware-Ausrüstung.

Die Geschichte des Minings ist: CPU → GPU → FPGA → ASIC. Jede Generation spezialisierter Hardware macht die vorherige obsolet. Die Geschichte des AI-Trainings und -Inferenzen wiederholt sich: Hopper → Blackwell → Vera Rubin → Groq LPU. Allgemeine Hardware beginnt, spezialisierte Hardware setzt sich durch. Das Groq LPU, das Huang Huang auf der GTC 2023 zeigte, ist nach der Akquisition von Groq ein deterministischer Datenflussprozessor. Statisches Kompilieren, Compiler-gestützte Steuerung, kein dynamisches Scheduling, 500MB on-chip SRAM—architektonisch ist es ein ASIC für Inferenzen. Es macht nur eine Sache, aber perfekt.

Interessanterweise: GPU spielte in beiden Wellen eine Schlüsselrolle.

Vor 2013 entdeckten Miner, dass GPUs besser geeignet sind als CPUs für das Schürfen von Crypto-Token, und Nvidia-Grafikkarten waren ausverkauft. Zehn Jahre später stellten Forscher fest, dass GPUs die besten Werkzeuge für das Training und die Inferenz von AI-Modellen sind, und Nvidia-Serverkarten waren erneut ausverkauft. GPUs haben als Prozessor-Kategorie zwei Generationen von Token-Ökonomien bedient.

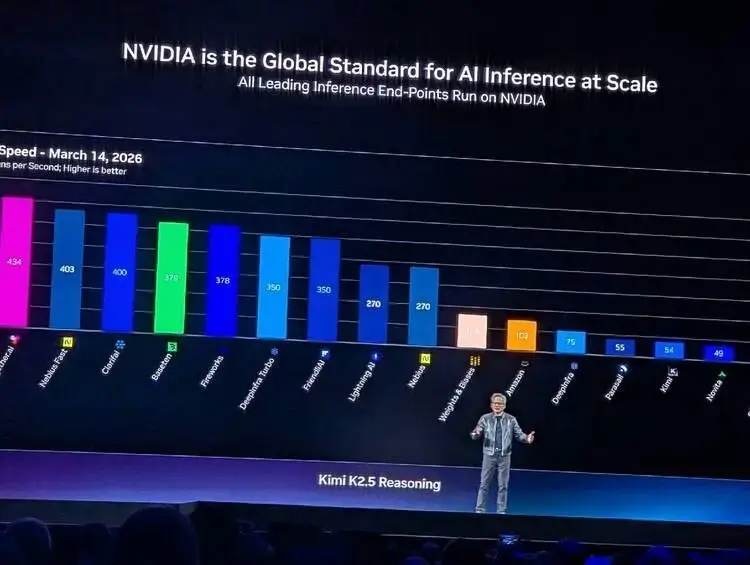

Der Unterschied: Beim ersten Mal profitierte Nvidia passiv, danach war es vorbei. Beim zweiten Mal, als der AI-Rechenbedarf vom Pre-Training zum Inferenz-Teil wechselte, nutzte Nvidia die Chance, aktiv das Spiel zu gestalten und wurde zum Gestalter der AI-Spielregeln.

Die profitabelste Schaufel weltweit

Im Goldrausch waren nicht die Goldgräber am profitabelsten, sondern Levi Strauss, der Schaufeln verkaufte. Beim Mining war es nicht der Miner, sondern Bitmain und Wu Jihan, die Mining-Hardware verkauften. Bei AI-Pre-Training und Inferenz sind es nicht die Basismodelle oder Agenten, sondern Nvidia, die am meisten verdient.

Aber ehrlich gesagt, die Rollen von Bitmain und Nvidia in ihren Branchen sind heute kaum noch vergleichbar.

- Bitmain verkauft nur Mining-Hardware, Nvidia war früher sogar Bitmain-Lieferant. Wenn du eine Mining-Maschine kaufst, ist es egal, welche Coins du schürfst, in welchen Pools du bist oder zu welchem Preis du verkaufst. Es ist ein reiner Hardware-Lieferant, der einmalige Gerätegewinne macht.

- Nvidia ist anders. Es verkauft nicht nur Hardware. Seit dem AI-Boost im Jahr 2025 hat es die Nutzung dieser GPU für was auch immer tiefgreifend definiert: Welche Tokens man schürfen sollte, wie man Token bewertet, an wen man sie verkauft, wie man Rechenzentren aufteilt… All das steht in den Präsentationen von Huang Huang: Er teilt den Markt in fünf Ebenen, jede mit bestimmten Modellen, Kontextlängen, Interaktionsgeschwindigkeiten und Preisen… Nvidia standardisiert und formatiert den zukünftigen Markt, in dem AI-Inferenz alles antreibt.

Um 2018 herum konzentrierte sich die globale Rechenleistung auf einige große Mining-Pools—F2Pool, Antpool, BTC.com—die um Anteile konkurrierten, aber die Hardware stammte fast ausschließlich von Bitmain.

Ähnlich wie heute generiert Nvidia 60 % der Einnahmen aus „Hyperscalern“, die im Wettbewerb stehen, z.B. AWS, Azure, GCP, Oracle, CoreWeave, während 40 % von dezentralen AI-Nativen, Souverän-AI-Projekten und Unternehmenskunden kommen. Große „Mining-Pools“ liefern den Großteil der Umsätze, kleine Miner sorgen für Resilienz und Diversifikation.

Beide Ökosysteme sind strukturell identisch. Doch Bitmain hat später Konkurrenz bekommen—Shenma-Maschinen, Canaan, Ebang—alle fressen Marktanteile. ASICs sind relativ einfache Designs, Nachahmer haben Chancen. Nvidia dagegen wird immer schwerer zu schlagen: 20 Jahre CUDA-Ökosystem, Hundertmillionen installierte GPUs, NVLink-Sechstel-Interconnect, das decoupled Inferenz-Architektur-Design nach der Akquisition von Groq—Nvidia’s technische Komplexität und Ökosystembarrieren machen die meisten Konkurrenz-Tools wirkungslos.

Das könnte noch 20 Jahre so weitergehen.

Die grundsätzliche Spaltung der beiden Token

Was die Kryptowährungen und die beiden Arten von Token für AI-Training und -Inferenz grundlegend unterscheidet, sind die Motivation und die Psychologie der Nutzer.

Crypto-Token werden vor allem spekulativ nachgefragt. Niemand „braucht“ Bitcoin, um Arbeit zu verrichten. Alle Whitepapers, die behaupten, Blockchain-Token könnten Probleme lösen, sind Betrug. Man hält Crypto, weil man glaubt, dass in Zukunft jemand es zu einem höheren Preis kaufen wird. Der Wert von Bitcoin basiert auf einem self-fulfilling prophecy: Wenn genug Leute glauben, dass es wertvoll ist, dann ist es das auch. Das ist die Glaubensökonomie.

Im Gegensatz dazu ist die Nachfrage nach AI-Token produktivitätsgetrieben. Nestlé braucht Token für Supply-Chain-Entscheidungen—ihre Daten werden alle 15 Minuten auf 3 Minuten aktualisiert, Kosten sinken um 83 %, dieser Wert lässt sich direkt auf Gewinn und Verlust (P&L) abbilden. Nvidia’s 100 % der Ingenieure brauchen Token, um Code zu schreiben, statt es manuell zu machen; Forschungsteams brauchen Token für wissenschaftliche Arbeiten. Man muss nicht an den Wert der Token glauben, man nutzt sie einfach, und ihr Wert bestätigt sich im Gebrauch.

Der grundlegendste Unterschied zwischen den beiden Token ist: Crypto-Token werden produziert, um gehalten und gehandelt zu werden—ihr Wert liegt im Nicht-Verwenden. AI-Token werden produziert, um sofort verbraucht zu werden—ihr Wert liegt im Moment des Gebrauchs.

Eins ist digitales Gold, je mehr man hortet, desto wertvoller; das andere ist digitale Energie, die beim Erzeugen verbrannt wird.

Dieser Unterschied bestimmt, dass die AI-Token-Wirtschaft nicht wie die Crypto-Token-Wirtschaft blasen wird. Bitcoin schwankt stark, weil spekulative Güter durch Emotionen getrieben werden. Der Token-Preis wird durch Nutzung und Produktionskosten bestimmt: Solange AI nützlich bleibt—solange Menschen Claude Code zum Programmieren, ChatGPT zum Schreiben von Berichten und Agenten für Geschäftsprozesse verwenden—wird die Nachfrage nach Token nicht zusammenbrechen. Es basiert nicht auf Glauben, sondern auf Unverzichtbarkeit.

- 2008 musste das Bitcoin-Whitepaper immer wieder erklären, warum ein dezentrales elektronisches Bargeldsystem wertvoll ist. 17 Jahre später streiten die Leute immer noch.

- 2026 hat die Token-Ökonomie keinen Streit ausgelöst; sie ist sogar ohne Diskussion Konsens. Als Huang Huang auf der GTC sagt „tokens are the new commodity“, zweifelt niemand. Denn jeder im Saal hat heute Morgen mit Claude Code oder ChatGPT Millionen Token verbraucht. Sie brauchen keine Überzeugung, dass Token wertvoll sind—ihre Kreditkartenabrechnungen beweisen es bereits.

In diesem Sinne ist Huang Huang wirklich ein Abbild von Satoshi Nakamoto: Derjenige, der die Monopolstellung bei der Herstellung von Minern innehatte, die Nutzungsszenarien und -regeln für Token definierte, und einmal im Jahr im SAP Center in San Jose eine Show veranstaltet, um zu zeigen, wie stark die nächste Generation von „Mining“-Geräten für AI-Training und -Inference sein wird.

Satoshi Nakamoto hat eine vorsichtige, begeisternde Aura: Er entwirft die Regeln, übergibt sie dem Code, und verschwindet. Das ist der Romantik des Cyberpunks. Huang Huang ist mehr Geschäftsmann als Wissenschaftler: Er entwirft die Regeln, pflegt sie persönlich, ergänzt sie ständig, baut seine Verteidigungslinien aus.

Das Token, das du früher nur sehen konntest, weil du daran glaubtest, kannst du jetzt sehen, ohne zu glauben. Es ist das Nächste nach Watt, Ampere und Bit.