La nueva función de Gen-2 "Magic Brush Ma Liang" explotó, internautas: Urgente

Fuente del artículo: qubits

Fuente de la imagen: Generado por Unbounded AI

Fuente de la imagen: Generado por Unbounded AI

¿La IA ha evolucionado hasta este punto para participar en la generación de videos?

¡Desliza el dedo sobre una foto para que el objetivo elegido se mueva!

Obviamente es un camión parado, pero se acerca con un cepillo, e incluso la luz y la sombra se restauran perfectamente:

Obviamente es un camión parado, pero se acerca con un cepillo, e incluso la luz y la sombra se restauran perfectamente:

Originalmente era solo una foto de un incendio, pero ahora puede hacer que las llamas se eleven hacia el cielo con un golpe de mano, y el calor está llegando:

Originalmente era solo una foto de un incendio, pero ahora puede hacer que las llamas se eleven hacia el cielo con un golpe de mano, y el calor está llegando:

Si sigues así, ¡no puedes notar la diferencia entre fotos y videos reales!

Si sigues así, ¡no puedes notar la diferencia entre fotos y videos reales!

Resulta que esta es una nueva característica creada por Runway para el software de video AI Gen-2, que puede hacer que los objetos de la imagen se muevan con una pintura y un pincel, y el grado de realismo no es menor que el del bolígrafo mágico Ma Liang.

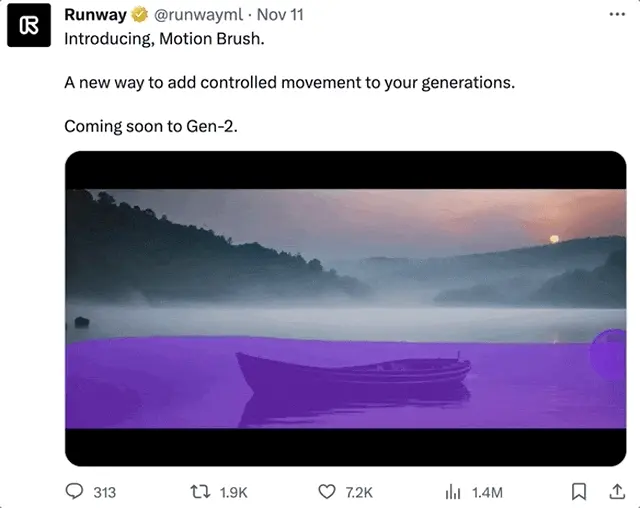

Aunque es solo un calentamiento de funciones, explotó en Internet tan pronto como salió el efecto:

Al ver que los internautas se convertían en reyes ansiosos uno por uno, gritaron “No puedo esperar para probar una ola”:

Al ver que los internautas se convertían en reyes ansiosos uno por uno, gritaron “No puedo esperar para probar una ola”:

Runway también ha lanzado más funciones para calentar el efecto, echemos un vistazo.

Runway también ha lanzado más funciones para calentar el efecto, echemos un vistazo.

De foto a vídeo, muévete a donde apuntes

Esta nueva característica en la pista se llama Motion Brush.

Como su nombre indica, solo necesitas usar este pincel para “pintar” cualquier objeto de la imagen para que se mueva.

No solo puede ser una persona estática, sino que incluso el movimiento de la falda y la cabeza es natural:

También puede ser un líquido que fluye como una cascada, e incluso se puede restaurar la niebla:

También puede ser un líquido que fluye como una cascada, e incluso se puede restaurar la niebla:

O un cigarrillo que aún no se ha apagado:

O un cigarrillo que aún no se ha apagado:

Una hoguera ardiendo delante de todos:

Una hoguera ardiendo delante de todos:

Los fondos más grandes también se pueden hacer dinámicos, incluso cambiando los efectos de luz y sombra de la imagen, como las nubes oscuras que se mueven rápidamente:

Los fondos más grandes también se pueden hacer dinámicos, incluso cambiando los efectos de luz y sombra de la imagen, como las nubes oscuras que se mueven rápidamente:

Por supuesto, todas estas son “tarjetas brillantes” de Runway que toman la iniciativa de decirte que “hicieron algo” con las fotos.

Por supuesto, todas estas son “tarjetas brillantes” de Runway que toman la iniciativa de decirte que “hicieron algo” con las fotos.

Los siguientes videos sin marcas de manchas son casi completamente indistinguibles de los ingredientes modificados por IA:

Una serie de efectos se han disparado, lo que también ha llevado al hecho de que la función no se haya lanzado oficialmente y los internautas no pueden esperar.

Una serie de efectos se han disparado, lo que también ha llevado al hecho de que la función no se haya lanzado oficialmente y los internautas no pueden esperar.

Mucha gente está tratando de entender cómo se implementa esta función. También hay internautas que prestan más atención a cuándo saldrá la función y esperan que el enlace esté directamente en 321 (cabeza de perro manual)

De hecho, puedes esperar una ola.

De hecho, puedes esperar una ola.

Pero no es solo esta nueva función de pincel de movimiento la que Runway ha introducido.

La reciente oleada de avances generados por IA parece indicar que el campo de la generación de vídeo está realmente a punto de marcar el comienzo de una explosión tecnológica.

¿Está realmente en auge el vídeo generado por IA?

Al igual que en los últimos días, algunos internautas han desarrollado una nueva forma de jugar el popular software de animación Wensheng Animatediff.

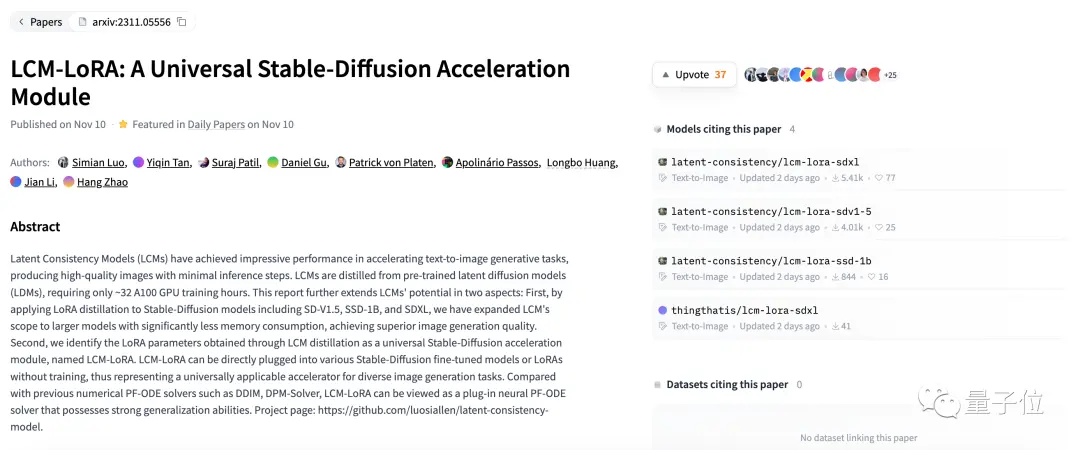

Combinado con la última investigación, LCM-LORA, solo se necesitan 7 segundos para generar un video animado con 16 fotogramas.

Combinado con la última investigación, LCM-LORA, solo se necesitan 7 segundos para generar un video animado con 16 fotogramas.

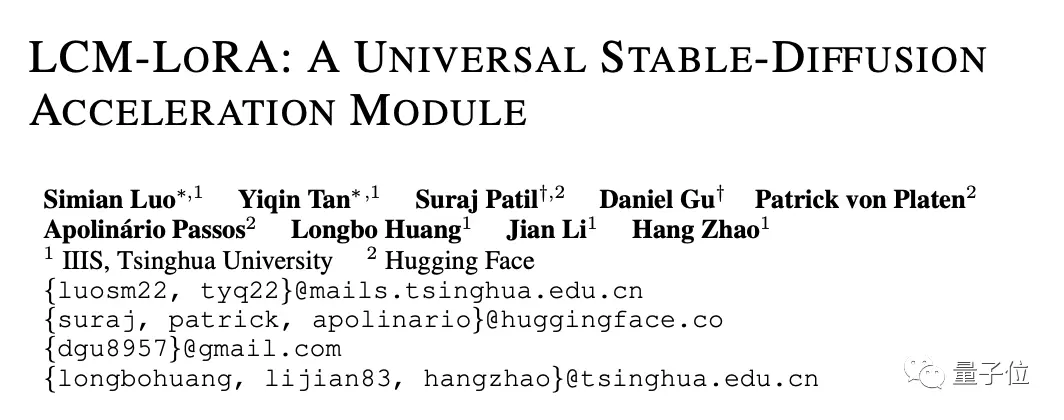

LCM-LoRa es una nueva tecnología de generación de imágenes de IA de la Universidad de Tsinghua y Hugging Face, que puede mejorar en gran medida la velocidad de generación de imágenes de Stable Diffusion.

Entre ellos, LCM (Latent Consistency Models) es un nuevo método de generación de imágenes basado en el “modelo de consistencia” de OpenAI a principios de este año, que puede generar rápidamente 768×768 imágenes de alta resolución.

Sin embargo, LCM no es compatible con los modelos existentes, por lo que la Universidad de Tsinghua y los miembros de Huhuyan han lanzado una nueva versión del modelo LCM-LoRa, que puede ser compatible con todos los modelos de difusión estable y acelerar la velocidad de dibujo.

Combinado con Animatediff, solo se tarda unos 7 segundos en generar una animación de este tipo:

Combinado con Animatediff, solo se tarda unos 7 segundos en generar una animación de este tipo:

En la actualidad, LCM-LORA ha sido de código abierto en Hug Face.

En la actualidad, LCM-LORA ha sido de código abierto en Hug Face.

¿Cómo te sientes acerca del progreso reciente en la generación de videos de IA y qué tan lejos estás de ser utilizable?

¿Cómo te sientes acerca del progreso reciente en la generación de videos de IA y qué tan lejos estás de ser utilizable?

Enlaces de referencia:

[1]

[2]