L'IA de mauvaise qualité inonde la communauté open source ! Certains projets ont commencé à suspendre les contributions externes, Shitcode ressemble à une attaque DDoS

Projet open source Tldraw, en raison de la surcharge causée par une quantité importante de code généré par IA de mauvaise qualité, a annoncé qu’il suspendait temporairement l’acceptation de contributions externes. Ce type de « AI Slop » consomme gravement l’énergie des mainteneurs, et la communauté explore actuellement la mise en place d’un système de crédibilité ou d’un mécanisme de dépôt de garantie pour y faire face.

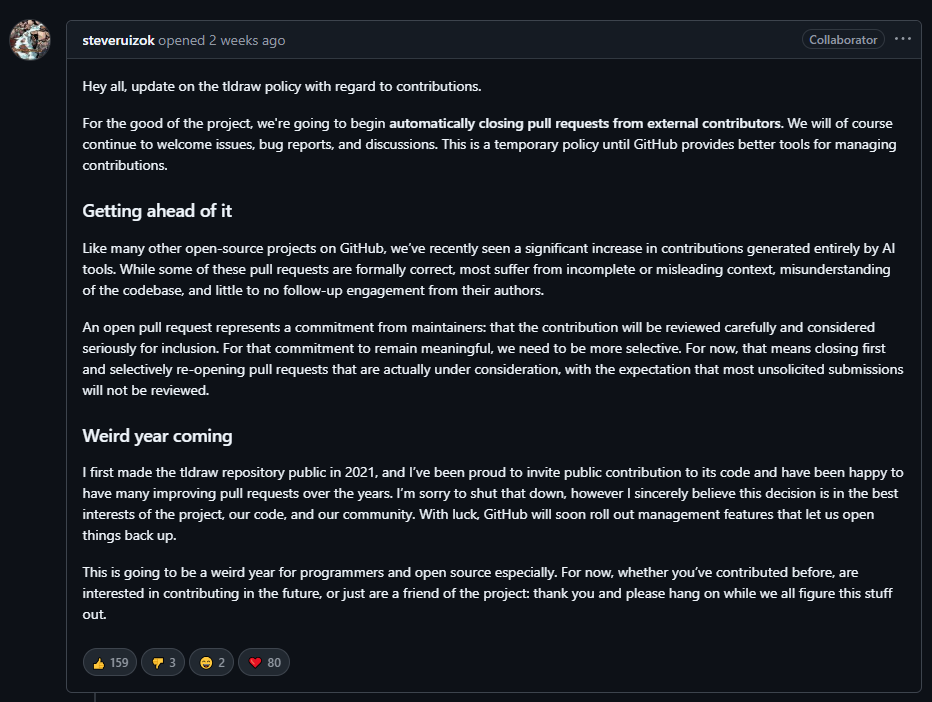

En raison de la surcharge causée par le contenu généré par IA, le projet open source Tldraw suspend temporairement l’acceptation de PR externes

Un projet open source de dessin web sur GitHub, Tldraw, qui a obtenu plus de 40 000 étoiles, a récemment publié une annonce indiquant qu’il suspendait l’acceptation des demandes de tirage (Pull Request, PR) provenant de contributeurs externes.

Le développeur steveruizok a souligné que, comme de nombreux projets open source sur GitHub, l’équipe a récemment constaté une augmentation significative du nombre de contributions entièrement générées par des outils IA. Bien que certaines contributions soumises soient correctes en forme, la majorité manque de contexte complet, comprend mal le code, et les soumissionnaires n’ont presque pas participé aux discussions par la suite.

steveruizok insiste sur le fait qu’une PR ouverte représente l’engagement du mainteneur, c’est-à-dire que cette contribution sera examinée attentivement et sérieusement considérée pour intégration. Pour que cet engagement conserve sa signification, l’équipe doit appliquer une sélection plus rigoureuse.

Actuellement, la politique de Tldraw consiste à fermer toutes les PR externes, sauf celles qui sont réellement prises en considération. Cela vise le meilleur intérêt de la qualité du projet et du code, même si cela est regrettable pour la contribution publique, steveruizok indique qu’il ne sera possible de revenir à une ouverture totale qu’après le lancement d’outils de gestion plus performants par GitHub.

Curl et OCaml également touchés, l’abondance de AI Slop

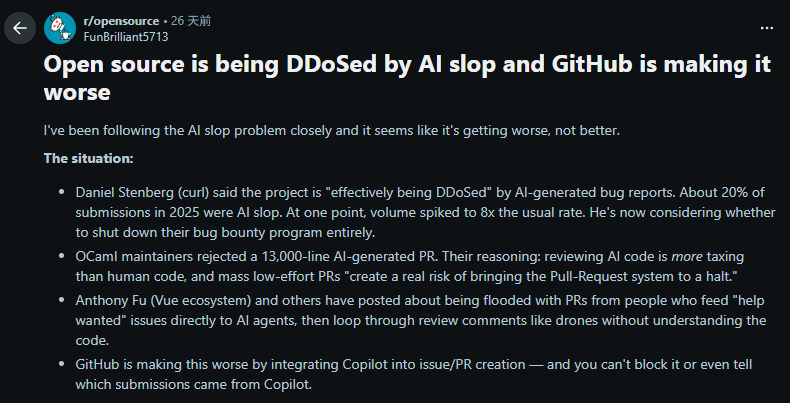

La décision de Tldraw de suspendre les PR n’est qu’un exemple récent de l’impact de l’AI Slop (déchets IA) sur la communauté open source. Des discussions similaires ont récemment gagné en intensité sur Reddit et Hacker News.

Une discussion sur Reddit indique que, selon Daniel Stenberg, mainteneur de l’outil de transfert connu Curl, le projet subit une « attaque DDoS » par des rapports d’erreur générés par IA, avec environ 20% des soumissions de 2025 étant du contenu de mauvaise qualité généré par IA, ce qui consomme énormément le temps des volontaires mainteneurs.

De plus, le mainteneur d’OCaml a également refusé une PR de 13 000 lignes, générée par IA, au motif que la révision du code IA est plus fastidieuse que l’écriture manuelle, et que l’afflux massif de PR de faible qualité pourrait faire planter le système.

Les discussions sur Hacker News se concentrent quant à elles sur les mécanismes de GitHub.

Certains internautes pensent que le fait de mettre en évidence le nombre de PR sur la page encourage la soumission de contributions pour des raisons purement statistiques.

Le problème actuel avec l’IA générative dans la communauté open source, c’est que beaucoup de développeurs inexpérimentés utilisent des outils IA pour générer du code sans valeur, en espérant que les mainteneurs fusionneront rapidement, ce qui nuit à la confiance dans la collaboration open source.

Quelques solutions : liste blanche ou système de crédibilité

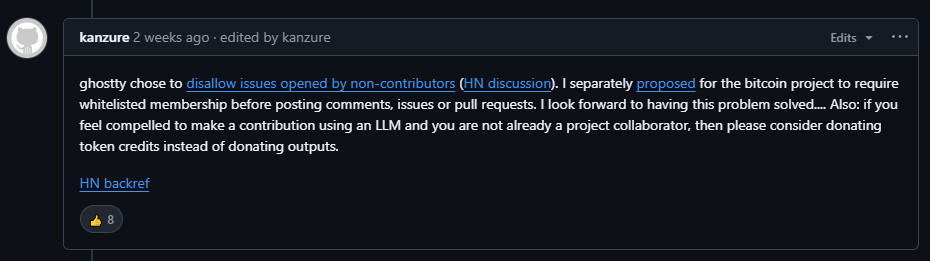

Face à la nuisance des « Shitcode » dans la communauté open source, le développeur de Bitcoin Bryan Bishop (kanzure) a répondu sur la page GitHub de Tldraw, en proposant que le processus de développement soit « privatisé », en passant à un mode réservé aux membres invités, ou en exigeant d’être sur une liste blanche pour pouvoir commenter ou faire des PR.

Même si cela peut aller à l’encontre de l’esprit d’ouverture de Bitcoin, Bryan Bishop pense que cela pourrait réduire efficacement le bruit et les débats inutiles causés par des non-contributeurs, permettant aux développeurs de se concentrer sur la technique elle-même, et d’éviter que leur attention précieuse ne soit dispersée par des interactions malveillantes ou inefficaces.

En plus de la privatisation, l’ingénieur logiciel Steve Rodrigue suggère également de créer un système de crédibilité pour les contributeurs à travers plusieurs projets, en utilisant un réseau de confiance pour valider la valeur des comptes.

Un autre développeur travaille sur un protocole « Stake-to-PR » basé sur la blockchain, exigeant que le soumissionnaire paie une petite caution, qui sera confisquée si le contenu est jugé comme du AI Slop, et remboursée intégralement s’il s’agit d’une contribution valable, dans le but d’augmenter le seuil d’entrée et de freiner l’abus de l’IA.

Lecture complémentaire :

Contenu IA en abondance ! Le dictionnaire Web3 choisit « Slop » comme mot de l’année 2025, provoquant de vives discussions dans le secteur technologique

Articles similaires

Un entrepreneur canadien de 33 ans spécialisé dans les cryptomonnaies a été kidnappé à Madrid en Espagne, deux suspects ont été arrêtés

Cyberattaque de Bitrefill : 18 500 dossiers exposés, le groupe Lazarus suspecté

Un CEX avertit : le jeton marqué comme "BTC" sur le réseau TON est un jeton frauduleux, et il aide les utilisateurs à traiter la situation.

Un Homme Indien Victime d'une Arnaque aux Faux Investissements Cryptographiques, Perd ₹71.6 Lakh

Trois adolescents poursuivent xAI aux États-Unis, accusant Grok de générer des images d'exploitation sexuelle d'enfants