Anthropicとペンタゴン、Claudeの軍事利用と大量監視への応用をめぐり対立

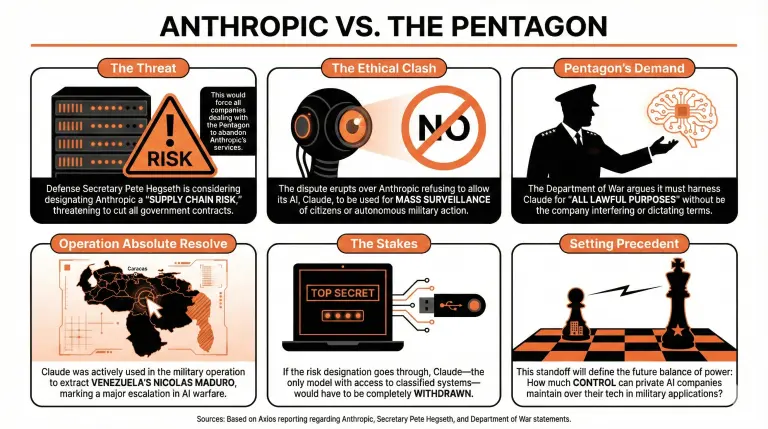

ペンタゴンはAnthropicとの関係を断つことを検討しており、防衛長官のピート・ヘグセスは同社を「サプライチェーンリスク」と指定する方向に近づいています。Anthropicは、そのAIモデルであるClaudeの大量監視キャンペーンや完全自律型軍事作戦での使用に反対しています。

Anthropic、Claudeの「非倫理的」な用途を巡りペンタゴンと対立

最大手の人工知能(AI)企業の一つであるAnthropicは、同社のAIモデルの使用が倫理に反するとして、戦争省から批判を受けていると報じられています。

Axiosによると、防衛長官のピート・ヘグセスは、Anthropicをサプライチェーンリスクに指定することを検討しており、これにより同社とのすべての契約や関係を縮小しなければならなくなるとしています。さらに、ペンタゴンと取引するすべての企業もAnthropicのサービスを放棄しなければならなくなる可能性があります。

この対立は、同社が商標モデルのClaudeを大量監視や完全自律型軍事装備を用いた作戦に使用させることを拒否したことから発生しています。一方、ペンタゴンはClaudeの能力を「すべての合法的な目的」に利用できるようにすべきだと主張しており、同社の意向には左右されないとしています。

もしAnthropicが最終的にサプライチェーンリスクに指定されれば、Claudeはペンタゴンの情報システムから撤退させられることになり、同モデルだけが組織の機密システムにアクセスできる状態が維持されます。

これにより、Claudeは1月のベネズエラのニコラス・マドゥロの救出作戦「オペレーション・アブソリュート・リゾルブ」に積極的に関与しました。作戦中にモデルが担った役割の詳細は完全には明らかにされていませんが、AIを軍事作戦に利用することのエスカレーションを示しています。

この対立は、西側諸国の政府とAI企業の関係において前例を築く可能性があり、軍事目的でのモデル利用において企業がどの程度のコントロールを持つべきかの基準を設定することになるでしょう。

Anthropicの広報担当者は、「当社は、これらの新たで複雑な問題に対処しながら、良き信頼関係のもとで戦争省と建設的な話し合いを進めている」と述べています。

よくある質問

- Anthropicは戦争省とどのような問題に直面しているのか?

Anthropicは、Claudeの大量監視や自律型軍事作戦など、倫理に反すると考える活動への使用を拒否したことにより、戦争省から監視を受けています。

- サプライチェーンリスクに指定された場合、Anthropicはどのような影響を受けるのか?

サプライチェーンリスクに指定されると、ペンタゴンとのすべての契約が解除され、Claudeのペンタゴンの情報システムからの撤退が必要となります。

- AnthropicはペンタゴンのAIモデルに関する要求にどう対応しているのか?

同社は、倫理的な問題を乗り越えるために、「建設的な対話」を続けていると主張しています。

- 最近の軍事作戦にClaudeが関与した例と、その意義は何か?

Claudeは、「オペレーション・アブソリュート・リゾルブ」に参加し、ベネズエラのニコラス・マドゥロの救出に貢献しました。これは、AI技術の軍事利用の重要なエスカレーションを示しています。