AI lixo a entrar na comunidade de código aberto! Alguns projetos começaram a suspender contribuições externas, Shitcode assemelha-se a um ataque DDoS

Projeto de código aberto Tldraw, devido à sobrecarga de código inútil gerado por IA, anuncia a suspensão da aceitação de contribuições externas. Este tipo de “AI Slop” consome seriamente a energia dos mantenedores, e a comunidade está a discutir a criação de um sistema de reputação ou mecanismo de caução para lidar com isso.

Incapaz de suportar a carga de conteúdo gerado por IA, o projeto de código aberto Tldraw suspende PRs externos

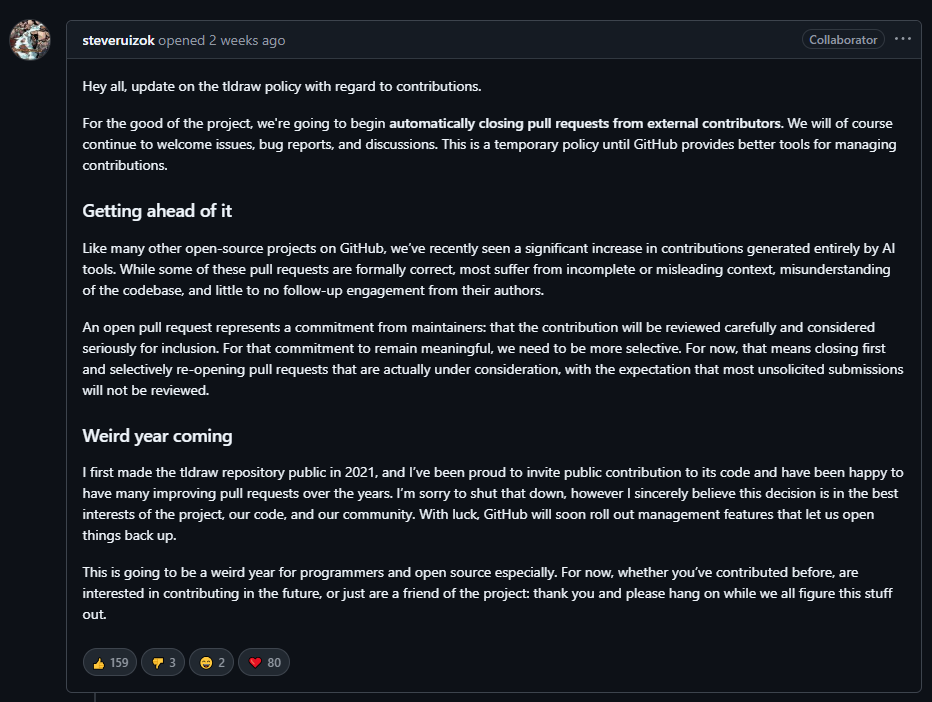

Um projeto de desenho web de código aberto no GitHub, com mais de 40 mil estrelas, Tldraw, anunciou recentemente que irá suspender a aceitação de pedidos de pull (Pull Request, PR) de contribuintes externos.

O desenvolvedor steveruizok apontou que, como muitos projetos de código aberto no GitHub, a equipe notou recentemente um aumento evidente na quantidade de contribuições totalmente geradas por ferramentas de IA. Embora algumas contribuições estejam formalmente corretas, a maioria carece de contexto completo, interpreta mal o repositório de código, e os autores quase não participam nas discussões posteriores.

steveruizok enfatizou que um PR aberto representa o compromisso do mantenedor, ou seja, a contribuição será cuidadosamente revisada e considerada para inclusão. Para manter esse compromisso significativo, a equipe precisa aplicar uma filtragem mais rigorosa.

Atualmente, a política do Tldraw é fechar todos os PRs externos, reabrindo apenas aqueles que realmente forem considerados relevantes. Isso é feito para o melhor interesse da qualidade do projeto e do código, embora lamentem o fechamento das contribuições públicas, steveruizok afirmou que só será possível reabrir quando o GitHub lançar melhores ferramentas de gestão.

Curl e OCaml também são afetados, com AI Slop a proliferar

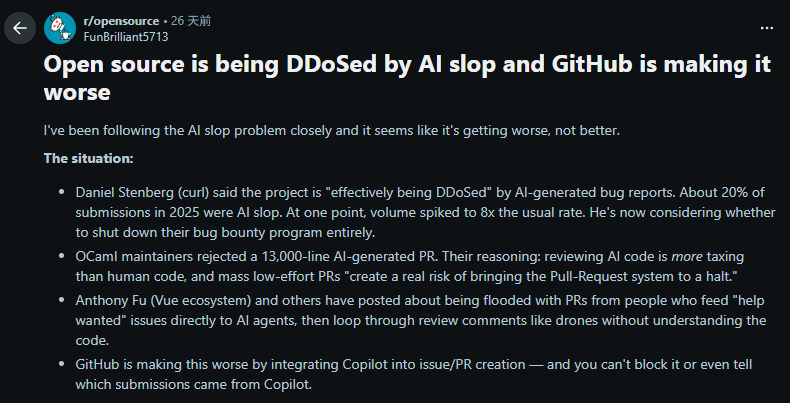

A decisão do Tldraw de suspender os PRs é apenas um exemplo recente do impacto do AI Slop (lixo de IA) na comunidade de código aberto. Recentemente, discussões semelhantes têm aumentado em fóruns como Reddit e Hacker News.

Uma discussão no Reddit apontou que, o conhecido ferramenta de transmissão Curl, cujo mantenedor é Daniel Stenberg, revelou que,** o projeto está sofrendo um “DDoS” de relatórios de erro gerados por IA, com cerca de 20% das submissões de 2025 sendo conteúdo lixo de IA****, consumindo seriamente o tempo dos voluntários mantenedores.**

Além disso, o mantenedor do OCaml também recusou um PR de 13.000 linhas geradas por IA, argumentando que revisar código gerado por IA é mais trabalhoso do que escrever manualmente, e uma grande quantidade de PRs de baixa qualidade pode levar ao colapso do sistema.

Nas discussões no fórum Hacker News, o foco é nas questões do mecanismo do GitHub.

Alguns usuários acreditam que, ao colocar o número de PRs em destaque na página, o GitHub incentiva uma cultura de submissões por motivos de dados.

A crise atual da IA generativa na comunidade de código aberto ocorre porque muitos desenvolvedores inexperientes usam ferramentas de IA para gerar códigos sem valor, e ainda esperam que os mantenedores façam merges rápidos. Essa prática está a destruir a confiança na colaboração da comunidade open source.

Algumas soluções: listas brancas ou sistemas de reputação

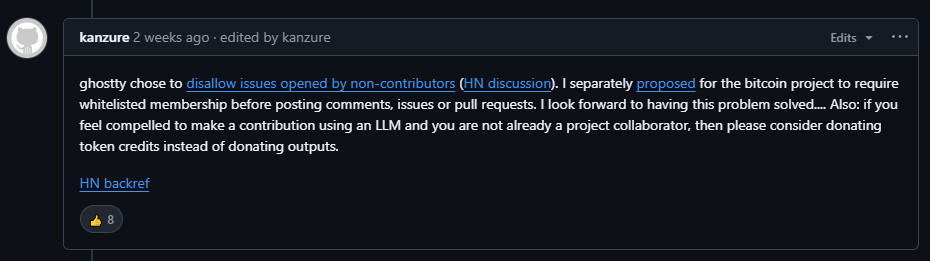

Diante do assédio de código inútil (Shitcode) na comunidade de código aberto, o desenvolvedor de Bitcoin Bryan Bishop (kanzure) respondeu na página do GitHub do Tldraw que, ele já propôs à equipe de desenvolvimento do Bitcoin Core que o processo de desenvolvimento seja “privatizado”, passando a ser acessível apenas a membros convidados, ou que seja criado um sistema de lista branca para permitir comentários e PRs.

Embora isso possa violar o espírito de abertura do Bitcoin, Bryan Bishop acredita que essa medida pode reduzir efetivamente o ruído e discussões inúteis causados por não-contribuidores, permitindo que os desenvolvedores se concentrem na tecnologia, evitando distrações por interações maliciosas ou de baixa qualidade.

Além da privatização, o engenheiro de software Steve Rodrigue também sugere a criação de um sistema de reputação de contribuidores entre projetos, usando redes de confiança para validar o valor das contas.

Outro desenvolvedor está a criar um protocolo baseado em blockchain chamado “Stake-to-PR”, que exige que o contribuinte pague uma pequena caução, e se o conteúdo for considerado lixo de IA, o valor é confiscado; se for uma contribuição válida, o valor é devolvido integralmente, tentando assim aumentar a barreira para impedir abusos de IA.

Leitura adicional:

Conteúdo de IA em excesso! O dicionário Web escolheu “Slop” como a palavra de 2025, gerando debates acalorados na comunidade tecnológica

Related Articles

Bitrefill divulga ataque de hackers presumivelmente norte-coreanos a 1 de março, com vazamento de aproximadamente 18,500 registos de compras de clientes

Mais Inteligência: Utilizadores relacionados com MoreLogin suspeitos de sofrer roubo em massa de criptomoedas, endereço do hacker lucrou aproximadamente 85 mil dólares

Uma equipa de hackers chinesa auto-divulgou-se devido a dissensões sobre a divisão de despojos, tendo roubado anteriormente aproximadamente 7 milhões de dólares em activos criptográficos

CertiK Avisa Riscos de Segurança em Marketplaces de Agentes de IA Apesar de Verificação de Habilidades de Próxima Geração

Ministério de Segurança do Estado divulga manual de criação segura de "Lagosta" (OpenClaw), apresentando quatro grandes riscos e medidas de resposta