Anthropic e o Pentágono entram em conflito sobre os usos militares e de vigilância em massa do Claude

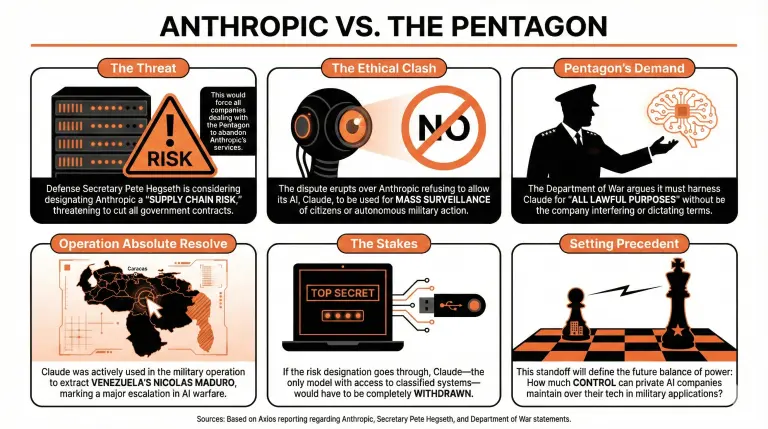

O Pentágono está a considerar cortar laços com a Anthropic, com o Secretário de Defesa Pete Hegseth próximo de designar a empresa como um “risco na cadeia de abastecimento”. A Anthropic opõe-se ao uso do seu modelo de IA, Claude, em campanhas de vigilância em massa e operações militares totalmente autónomas.

Anthropic entra em conflito com o Pentágono sobre os usos ‘não éticos’ de Claude

A Anthropic, uma das maiores empresas de inteligência artificial (IA), está supostamente sob fogo do Departamento de Guerra devido ao uso dos seus modelos de IA em atividades consideradas antiéticas pela própria empresa.

A Axios informou que o Secretário de Defesa Pete Hegseth está a considerar designar a Anthropic como um risco na cadeia de abastecimento, o que implicaria cortar todos os contratos e ligações com a empresa. Além disso, todas as empresas que lidam com o Pentágono também teriam de abandonar os serviços da Anthropic.

O conflito surge na medida em que a empresa se recusou a permitir o uso de Claude, o seu modelo de marca registada, em campanhas de vigilância em massa e operações envolvendo equipamento militar totalmente autónomo. Por outro lado, o Pentágono afirma que deveria poder aproveitar as capacidades de Claude para “todos os fins legais”, sem que a empresa tenha voz nestes processos.

Se a Anthropic for finalmente classificada como um risco na cadeia de abastecimento, isso significaria que o modelo teria de ser retirado dos sistemas de informação do Pentágono, uma vez que apenas Claude tem acesso aos sistemas classificados da organização.

Isso permitiu que Claude participasse na Operação Resolução Absoluta, que levou à extração de Nicolás Maduro, da Venezuela, em janeiro. Mesmo que o papel assumido pelo modelo durante a operação não tenha sido totalmente divulgado, representa uma escalada no uso de IA em campanhas militares.

O impasse pode estabelecer um precedente sobre como as empresas de IA podem lidar com os governos do mundo ocidental, estabelecendo as bases para os níveis de controlo que essas empresas podem manter sobre os seus modelos quando utilizados para fins militares.

Um porta-voz da Anthropic afirmou que a empresa estava a ter “conversas produtivas, de boa fé, com o Departamento de Guerra sobre como continuar esse trabalho e resolver essas questões novas e complexas.”

FAQ

- Que problemas a Anthropic enfrenta com o Departamento de Guerra?

A Anthropic está sob escrutínio do Departamento de Guerra por recusar permitir que o seu modelo de IA, Claude, seja utilizado em atividades que considera antiéticas, como vigilância em massa e operações militares autónomas.

- Que consequências potenciais a Anthropic pode enfrentar se for classificada como risco na cadeia de abastecimento?

Se for designada como risco na cadeia de abastecimento, todos os contratos com o Pentágono seriam cortados, sendo necessário retirar o Claude dos sistemas de informação do Pentágono.

- Como respondeu a Anthropic às exigências do Pentágono relativas ao seu modelo de IA?

A empresa afirma que está envolvida em “conversas produtivas” com o Departamento de Guerra, com o objetivo de navegar pelas questões éticas complexas relacionadas com o uso da sua tecnologia de IA.

- Que operação militar recente envolveu o Claude e qual foi a sua importância?

O Claude participou na Operação Resolução Absoluta, que facilitou a extração de Nicolás Maduro, da Venezuela, marcando uma escalada significativa no uso de tecnologias de IA pelo exército.