Нова функція Gen-2 "Чарівний пензлик Ма Лян" вибухнула, користувачі мережі: Терміново

Джерело статті: qubits

Джерело зображення: Створено Unbounded AI

Джерело зображення: Створено Unbounded AI

Штучний інтелект еволюціонував до такої міри, щоб займатися генерацією відео?!

Проведіть пальцем по фотографії, щоб зрушити з місця обрану ціль!

Очевидно, що це вантажівка, що стоїть, але вона під’їжджає пензлем, і навіть світло і тінь чудово відновлюються:

Очевидно, що це вантажівка, що стоїть, але вона під’їжджає пензлем, і навіть світло і тінь чудово відновлюються:

Спочатку це була просто фотографія пожежі, але тепер вона може змусити полум’я злетіти в небо одним помахом руки, і тепло наближається:

Спочатку це була просто фотографія пожежі, але тепер вона може змусити полум’я злетіти в небо одним помахом руки, і тепло наближається:

Якщо так продовжувати, ви не зможете відрізнити фотографії від реальних відео!

Якщо так продовжувати, ви не зможете відрізнити фотографії від реальних відео!

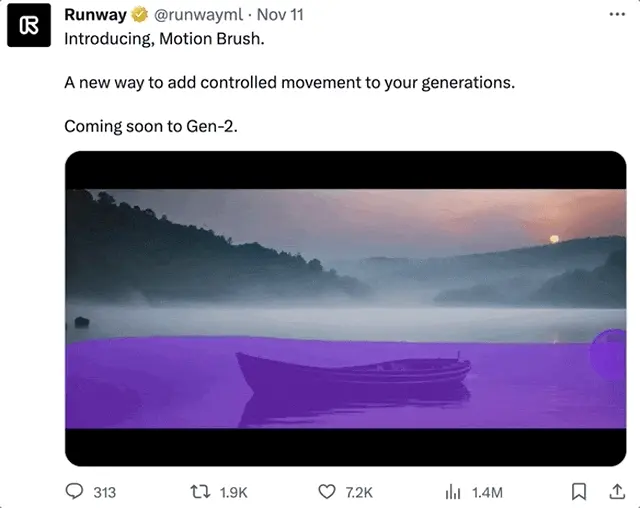

Виявляється, це нова функція, створена Runway для програмного забезпечення для відео зі штучним інтелектом Gen-2, яка може змусити об’єкти на зображенні рухатися однією картиною та пензлем, а ступінь реалістичності не менша, ніж у чарівного пера Ма Ляна.

Хоча це всього лише функція прогріву, вона вибухнула в інтернеті, як тільки з’явився ефект:

Побачивши, що користувачі мережі один за одним перетворюються на стривожених королів, вони вигукнули “Не можу дочекатися, щоб спробувати хвилю”:

Побачивши, що користувачі мережі один за одним перетворюються на стривожених королів, вони вигукнули “Не можу дочекатися, щоб спробувати хвилю”:

Runway також випустила більше функцій для розігріву ефекту, давайте подивимося.

Runway також випустила більше функцій для розігріву ефекту, давайте подивимося.

Фото на відео, переміщайте, куди вказуєте

Ця нова функція на злітно-посадковій смузі називається Motion Brush.

Як випливає з назви, вам потрібно лише використовувати цей пензель, щоб «намалювати» будь-який об’єкт на малюнку, щоб змусити його рухатися.

Мало того, що це може бути статична людина, так ще й рух спідниці і голови природно:

Це також може бути проточна рідина, наприклад, водоспад, і навіть туман можна відновити:

Це також може бути проточна рідина, наприклад, водоспад, і навіть туман можна відновити:

Або сигарета, яка ще не погашена:

Або сигарета, яка ще не погашена:

Багаття, що горить на очах у всіх:

Багаття, що горить на очах у всіх:

Більший фон також можна зробити динамічним, навіть змінюючи світлові та тіньові ефекти зображення, наприклад, темні хмари, що швидко рухаються:

Більший фон також можна зробити динамічним, навіть змінюючи світлові та тіньові ефекти зображення, наприклад, темні хмари, що швидко рухаються:

Звичайно, це все «яскраві карти» Runway, які беруть на себе ініціативу, щоб сказати вам, що вони «щось зробили» з фотографіями.

Звичайно, це все «яскраві карти» Runway, які беруть на себе ініціативу, щоб сказати вам, що вони «щось зробили» з фотографіями.

Наступні відео без слідів мазка майже повністю не відрізняються від інгредієнтів, модифікованих ШІ:

Вибухнула низка ефектів, що також призвело до того, що функція не була офіційно випущена, і користувачі мережі не можуть чекати.

Вибухнула низка ефектів, що також призвело до того, що функція не була офіційно випущена, і користувачі мережі не можуть чекати.

Багато людей намагаються зрозуміти, як реалізована ця функція. Є й користувачі мережі, які більше звертають увагу на те, коли вийде функція, і сподіваються, що посилання буде прямо на 321 (ручна собача голова)

Ви дійсно можете очікувати хвилі.

Ви дійсно можете очікувати хвилі.

Але не тільки ця нова функція Motion Brush представила Runway.

Нещодавній шквал досягнень, створених штучним інтелектом, схоже, вказує на те, що сфера генерації відео справді ось-ось розпочне технологічний вибух.

Чи справді відео, створене штучним інтелектом, на підйомі?

Як і в останні кілька днів, деякі користувачі мережі розробили новий спосіб гри в дуже популярне програмне забезпечення для анімації Wensheng Animatediff.

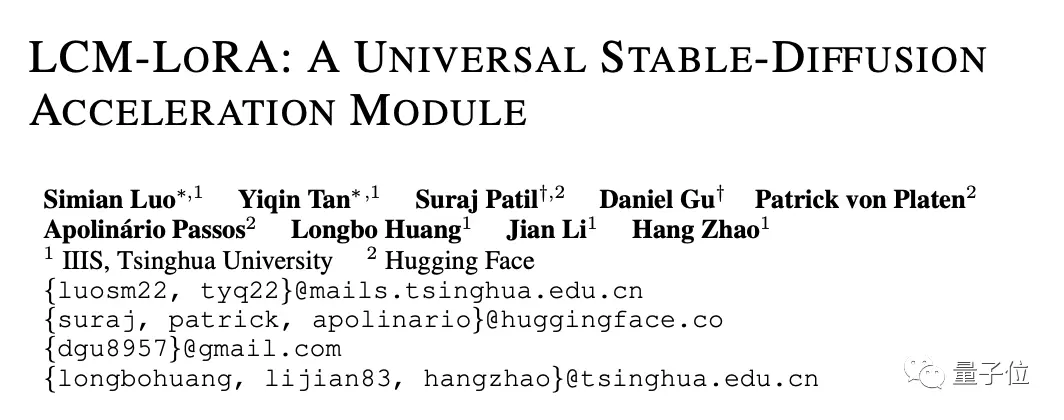

У поєднанні з останніми дослідженнями LCM-LORA, для створення анімаційного відео з 16 кадрами потрібно всього 7 секунд.

У поєднанні з останніми дослідженнями LCM-LORA, для створення анімаційного відео з 16 кадрами потрібно всього 7 секунд.

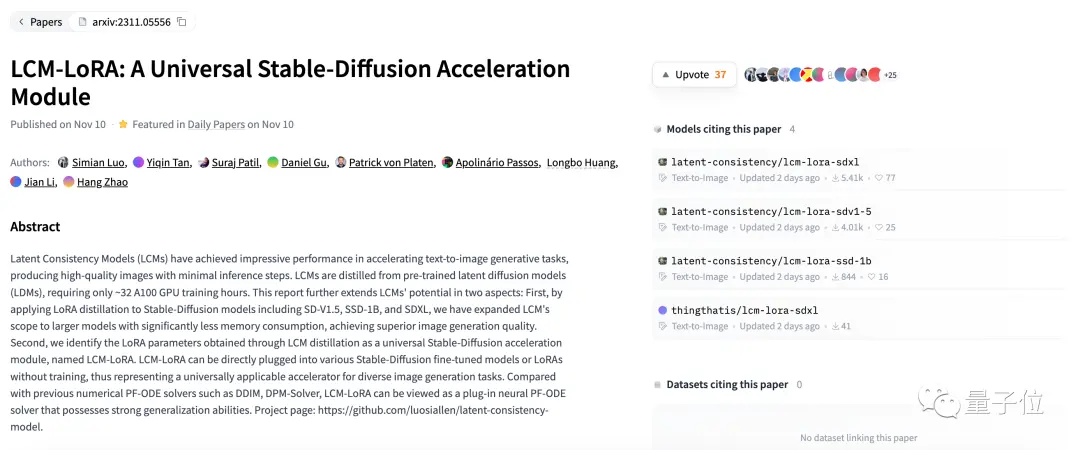

LCM-LoRa — це нова технологія генерації зображень зі штучним інтелектом від Університету Цінхуа та Hugging Face, яка може значно покращити швидкість генерації зображень Stable Diffusion.

Серед них LCM (Latent Consistency Models) — це новий метод генерації зображень, заснований на «моделі узгодженості» OpenAI на початку цього року, який може швидко генерувати 768×768 зображень з високою роздільною здатністю.

Однак LCM не сумісна з існуючими моделями, тому Університет Цінхуа та члени Huhuyan випустили нову версію моделі LCM-LoRa, яка може бути сумісна з усіма моделями Stable Diffusion та прискорювати швидкість малювання.

У поєднанні з Animatediff генерація такої анімації займає всього близько 7 секунд:

У поєднанні з Animatediff генерація такої анімації займає всього близько 7 секунд:

В даний час LCM-LORA має відкритий вихідний код в Hug Face.

В даний час LCM-LORA має відкритий вихідний код в Hug Face.

Як ви ставитеся до нещодавнього прогресу в генерації відео зі штучним інтелектом і наскільки ви далекі від того, щоб його можна було використовувати?

Як ви ставитеся до нещодавнього прогресу в генерації відео зі штучним інтелектом і наскільки ви далекі від того, щоб його можна було використовувати?

Посилання на джерела:

[1]

[2]