Anthropic và Lầu Năm Góc xung đột về các ứng dụng quân sự và giám sát quy mô lớn của Claude

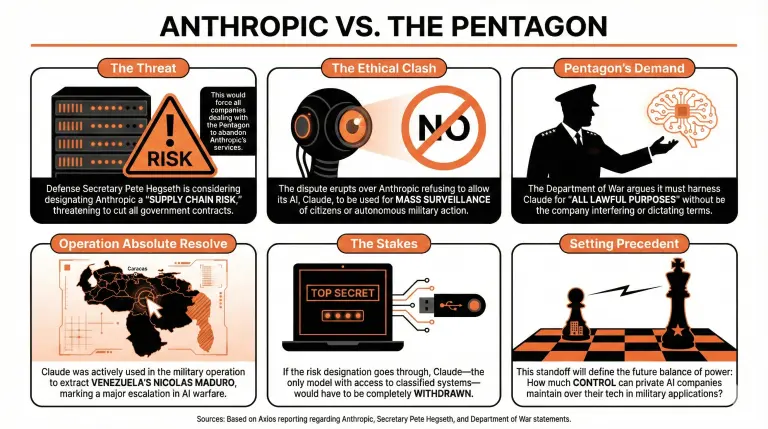

Ngũ Giác Đài đang xem xét cắt đứt quan hệ với Anthropic, trong đó Bộ trưởng Quốc phòng Pete Hegseth đang gần như xác định công ty này là “rủi ro chuỗi cung ứng.” Anthropic phản đối việc sử dụng mô hình AI của mình, Claude, trong các chiến dịch giám sát quy mô lớn và các hoạt động quân sự hoàn toàn tự động.

Anthropic Xung Đột Với Ngũ Giác Đài Về Việc Sử Dụng ‘Không Đạo Đức’ Của Claude

Anthropic, một trong những công ty trí tuệ nhân tạo (AI) lớn nhất, được cho là đang bị Bộ Quốc phòng chỉ trích về việc sử dụng các mô hình AI của mình cho các hoạt động bị công ty coi là phi đạo đức.

Axios đưa tin rằng Bộ trưởng Quốc phòng Pete Hegseth đang xem xét việc xác định Anthropic là một rủi ro chuỗi cung ứng, nghĩa là tất cả các hợp đồng và quan hệ với công ty này sẽ phải bị cắt giảm. Ngoài ra, tất cả các công ty hợp tác với Ngũ Giác Đài cũng sẽ phải từ bỏ dịch vụ của Anthropic.

Cuộc xung đột nổ ra khi công ty từ chối cho phép sử dụng Claude, mô hình thương hiệu của mình, trong các chiến dịch giám sát quy mô lớn và các hoạt động liên quan đến thiết bị quân sự hoàn toàn tự động. Trong khi đó, Ngũ Giác Đài khẳng định rằng họ nên có quyền khai thác khả năng của Claude cho “mọi mục đích hợp pháp,” mà không cần công ty có tiếng nói trong các quá trình này.

Nếu Anthropic cuối cùng bị xác định là rủi ro chuỗi cung ứng, điều đó có nghĩa là mô hình sẽ phải bị rút khỏi hệ thống thông tin của Ngũ Giác Đài, vì chỉ có Claude mới có quyền truy cập vào các hệ thống bí mật của tổ chức.

Điều này đã cho phép Claude tham gia tích cực vào Chiến dịch Giải pháp Tuyệt đối, dẫn đến việc giải cứu Nicolás Maduro của Venezuela vào tháng 1. Mặc dù vai trò của mô hình trong chiến dịch chưa được tiết lộ đầy đủ, nhưng đây là một bước leo thang trong việc sử dụng AI cho các chiến dịch quân sự.

Cuộc đối đầu này có thể thiết lập tiền lệ về cách các công ty AI có thể đối phó với các chính phủ trong thế giới phương Tây, đặt nền móng cho các mức kiểm soát mà các công ty này có thể duy trì đối với các mô hình của họ khi được sử dụng cho mục đích quân sự.

Một phát ngôn viên của Anthropic cho biết công ty đang có “những cuộc trò chuyện mang tính xây dựng, thiện chí, với Bộ Quốc phòng về cách tiếp tục công việc này và xử lý đúng các vấn đề phức tạp mới này.”

Câu Hỏi Thường Gặp

- Anthropic đang đối mặt với vấn đề gì với Bộ Quốc phòng?

Anthropic đang bị Bộ Quốc phòng kiểm tra vì từ chối cho phép mô hình AI của mình, Claude, được sử dụng cho các hoạt động mà họ cho là phi đạo đức, như giám sát quy mô lớn và các hoạt động quân sự tự động.

- Nếu bị xếp loại là rủi ro chuỗi cung ứng, Anthropic có thể đối mặt với hậu quả gì?

Nếu được xác định là rủi ro chuỗi cung ứng, tất cả các hợp đồng với Ngũ Giác Đài sẽ bị cắt, buộc phải rút Claude khỏi hệ thống thông tin của Ngũ Giác Đài.

- Anthropic đã phản ứng như thế nào trước yêu cầu của Ngũ Giác Đài về mô hình AI của mình?

Công ty khẳng định rằng họ đang tham gia “các cuộc trò chuyện mang tính xây dựng” với Bộ Quốc phòng, nhằm điều hướng các vấn đề đạo đức phức tạp liên quan đến việc sử dụng công nghệ AI của họ.

- Chiến dịch quân sự gần đây có liên quan đến Claude là gì và tầm quan trọng của nó?

Claude đã tham gia vào Chiến dịch Giải pháp Tuyệt đối, giúp giải cứu Nicolás Maduro của Venezuela, đánh dấu một bước leo thang đáng kể trong việc quân đội sử dụng công nghệ AI.