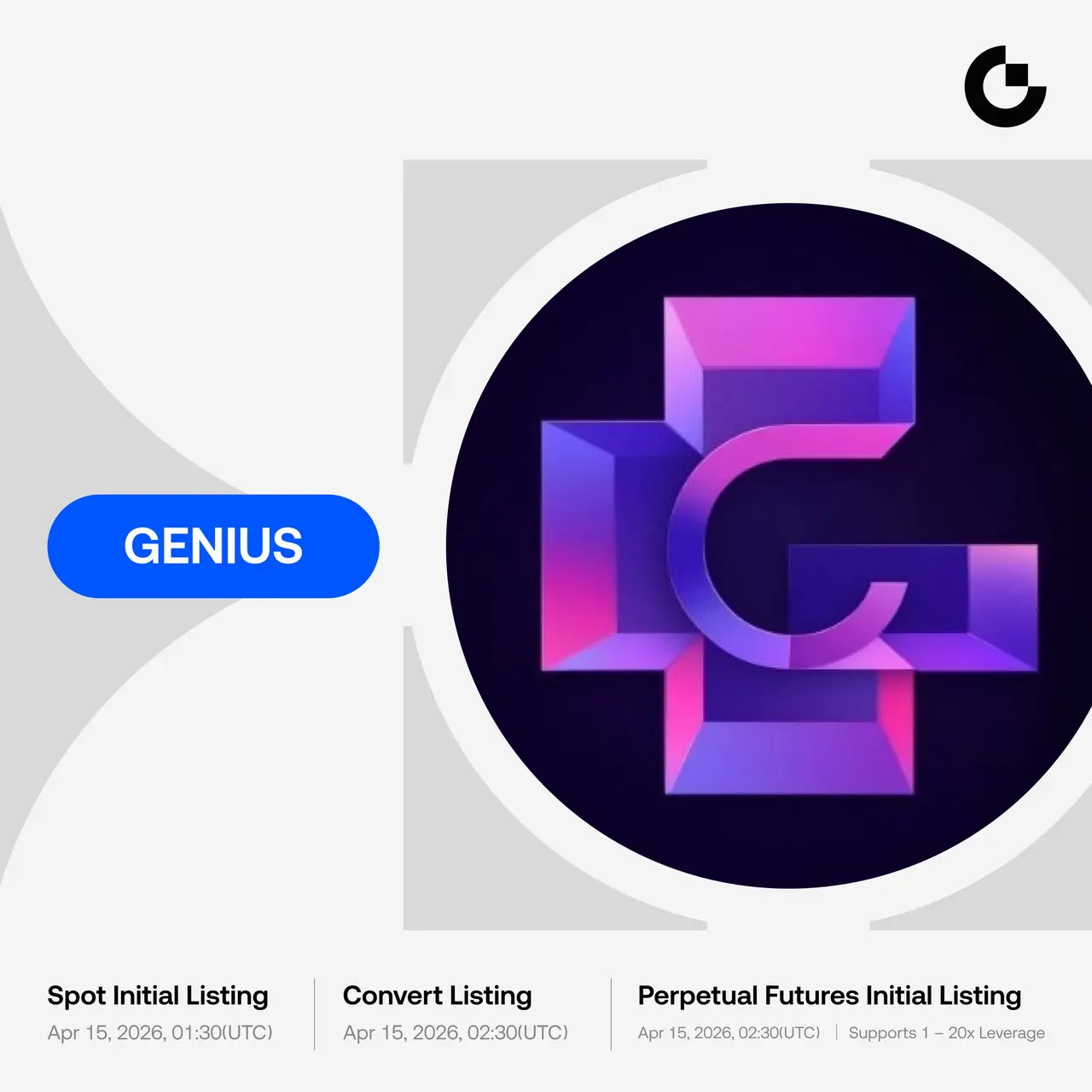

Gate 首次上市:$GENIUS

🔹 交易对:$GENIUS / $USDT

🔹 现货交易开始时间:凌晨1:30,4月15日 (UTC)

🔹 期货交易开始时间:凌晨2:30,4月15日 (UTC)

🔹 零手续费兑换开始时间:凌晨2:30,4月15日 (UTC)

现货:https://gate.com/trade/GENIUS_USDT

期货:https://www.gate.com/futures/USDT/GENIUS_USDT

兑换:https://www.gate.com/convert/USDT/GENIUS

详情:https://www.gate.com/announcements/article/50701

🔹 交易对:$GENIUS / $USDT

🔹 现货交易开始时间:凌晨1:30,4月15日 (UTC)

🔹 期货交易开始时间:凌晨2:30,4月15日 (UTC)

🔹 零手续费兑换开始时间:凌晨2:30,4月15日 (UTC)

现货:https://gate.com/trade/GENIUS_USDT

期货:https://www.gate.com/futures/USDT/GENIUS_USDT

兑换:https://www.gate.com/convert/USDT/GENIUS

详情:https://www.gate.com/announcements/article/50701