โพสต์ยอดนิยมก่อให้เกิดข่าวผิดของสื่อไต้หวัน: โฮโนดปีนขึ้น 101 นักถ่ายภาพคือ คิมกวอวี ท้าทายการอ่านสื่อในยุค AI

หนึ่งในผู้สร้างดิจิทัลเชื่อข้อมูลจาก AI ที่อ้างว่า จิน กัวเว่ย เป็นช่างภาพถ่ายทอดสดไต่ตึกไทเป 101 ซึ่งเป็นสาเหตุให้สื่อไทยรายงานผิดพลาดเป็นกลุ่มใหญ่ จากการตรวจสอบ รายชื่อถ่ายทอดสดไม่มีจิน กัวเว่ย เหตุการณ์นี้ชี้ให้เห็นถึงความเสี่ยงของภาพลวงจาก AI และความสำคัญของความสามารถในการตรวจสอบข่าวสารของสื่อ

โพสต์ยอดนิยมก่อให้เกิดข่าวผิดพลาดในสื่อ: ฮอนนอลด์เป็นช่างภาพไต่ 101 คือจิน กัวเว่ย

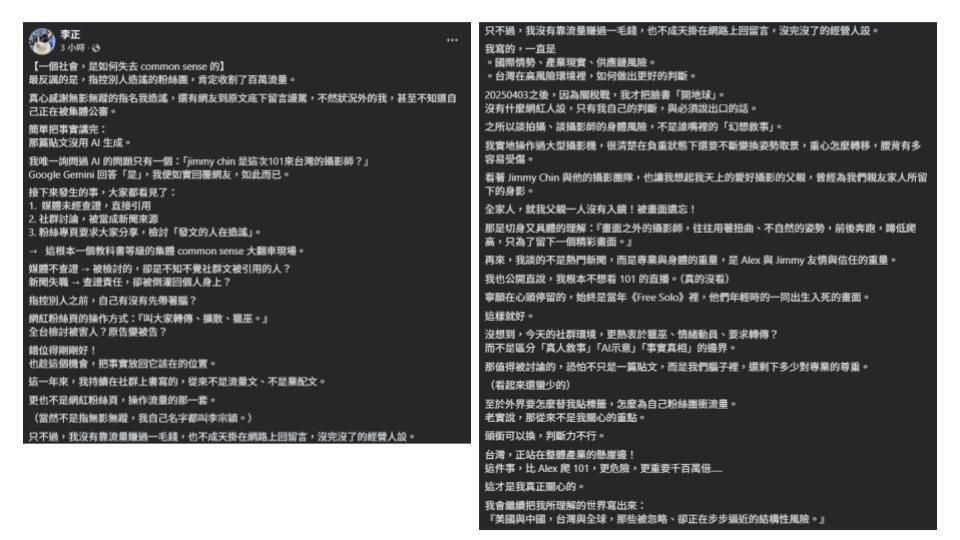

เมื่อเร็ว ๆ นี้ นักปีนเขาขีดจำกัดสูง ฮอนนอลด์ (Alex Honnold) ปีนตึกไทเป 101 ด้วยมือเปล่า กลายเป็นหัวข้อสนทนาในไต้หวัน โดยในนั้น มีผู้สร้างดิจิทัลที่มีผู้ติดตามเกิน 10,000 คน ชื่อ หลี จง (李宗穎) ได้โพสต์และคอมเมนต์ว่า ช่างภาพถ่ายทอดสดการปีนของฮอนนอลด์คือ จิมมี่ ชิน (Jimmy Chin) ผู้กำกับสารคดีออสการ์ และอธิบายรายละเอียดเกี่ยวกับท่าทางการถ่ายและอุปกรณ์ที่คาดการณ์ไว้

โพสต์นี้ได้รับไลก์มากกว่า 7,700 ครั้ง และแชร์กว่า 500 ครั้ง ต่อมา สื่อหลักในไต้หวันหลายแห่งและสื่อฮ่องกง โดยไม่ได้ตรวจสอบข้อมูล ได้อ้างอิงเนื้อหา โดยส่วนใหญ่มักใช้หัวข้อเช่น “ช่างภาพไต่ 101 ของฮอนนอลด์คือจิน กัวเว่ย” ในรายงาน

จนถึงบ่ายวันที่ 28 มกราคม สื่อบางแห่งได้ลบโพสต์เงียบ ๆ เช่น 《聯合新聞網》, 《Jusky 街星》 และ 《鏡報》 ได้แก้ไขเนื้อหาเป็น “การท้าทายของไทเป 101 ไม่ใช่โดยจิน กัวเว่ย”

ต่อมา เพจภาพยนตร์ชื่อดัง “無影無蹤” และ Howard Yang ได้ออกมาชี้แจง “無影無蹤” วิจารณ์สื่อหลักที่อ้างอิงข้อความที่ไม่ได้ตรวจสอบจาก “นิยาย AI” และขาดการตรวจสอบพื้นฐานก่อนรายงาน Howard Yang ชี้ว่า อุปกรณ์กล้องและเนื้อหาการถ่ายทอดสดในโพสต์ไม่ตรงกัน และภาพประกอบน่าจะเป็น AI สร้างขึ้น ซึ่งตั้งคำถามถึงความถูกต้องของเนื้อหา

ตรวจสอบในเมืองคริปโต จิน กัวเว่ย ไม่ใช่ผู้กำกับและช่างภาพถ่ายทอดสด

ย้อนดูโพสต์ที่เป็นประเด็น ผู้เขียน หลี จง อ้างว่า Netflix ใช้ AI สร้างภาพเพื่อเพิ่มยอดวิวของการถ่ายทอดสด ซึ่งปัจจุบันยังไม่มีหลักฐานสนับสนุน เป็นเพียงการคาดเดาของผู้เขียนเท่านั้น

“เมืองคริปโต” ตรวจสอบเพิ่มเติม โดยดูรายชื่อทีมงานในตอนจบของการถ่ายทอดสด Netflix ครั้งนี้ พบว่า ผู้กำกับการถ่ายทอดสดของฮอนนอลด์คือ Joe Demaio รับผิดชอบการถ่ายภาพจากมุมสูง และผู้กำกับภาพ Brett Lowell ส่วนทีมงานผู้ช่วยผู้กำกับและทีมถ่ายภาพอากาศและปีนเขา ไม่มีชื่อจิน กัวเว่ย อยู่ในรายชื่อเลย

นอกจากนี้ โพสต์บนเฟซบุ๊กของจิน กัวเว่ย ก็แค่แชร์ภาพในแอนตาร์กติกาเท่านั้น ภาพของฮอนนอลด์เป็นภาพเก่าจากการถ่ายปีนเขาในโอลด์แร็พ และไม่มีหลักฐานบ่งชี้ว่าเขามีส่วนร่วมในการถ่ายทอดสดไทเป 101 ครั้งนี้

ผู้เขียนโพสต์เดิมยอมรับว่า ใช้คำตอบจาก AI และไม่ได้ดูการถ่ายทอดสด

เมื่อเผชิญกับข้อสงสัย หลี จง ได้ตอบกลับเพจ “無影無蹤” เมื่อเช้าวันที่ 28 ว่า เขายืนยันว่าโพสต์นั้นไม่ได้สร้างด้วย AI แต่ก็ยอมรับว่าไม่ได้ดูการถ่ายทอดสดปีน 101

ส่วนเหตุผลที่เขายืนยันอย่างแน่วแน่ว่า ช่างภาพคือจิน กัวเว่ย เขากล่าวว่า เขาเพียงสอบถาม AI เครื่องมือ Gemini ว่า “Jimmy Chin เป็นช่างภาพของการถ่ายทอดสด 101 ในไต้หวันครั้งนี้หรือไม่?” และได้รับคำตอบว่าใช่ จึงนำข้อมูลนี้ไปตอบกลับผู้ติดตาม

เขาเห็นว่า สื่อที่อ้างอิงข้อมูลโดยไม่ได้ตรวจสอบ ก็เป็นความรับผิดชอบของโพสต์ในโซเชียลมีเดียเอง

การแพร่หลายของ AI สร้างสรรค์และความกังวลด้านความสามารถในการตรวจสอบข่าวสาร

ตามรายงานสำรวจปี 2025 ของมูลนิธิศูนย์ข้อมูลเครือข่ายไต้หวัน (TWNIC) พบว่า มีประชากรในไต้หวันราว 43.19% ใช้ AI สร้างสรรค์

แม้ว่า 57.11% ของผู้ใช้อินเทอร์เน็ตจะเชื่อว่าตนสามารถตรวจสอบความจริงของข้อมูลได้ แต่ในความเป็นจริง กว่าครึ่ง (65.91%) มักไม่ตรวจสอบข้อมูลด้วยตนเอง หรือทำการตรวจสอบน้อยมาก (13.6%) ซึ่งแสดงให้เห็นถึงความขัดแย้งระหว่าง “ความมั่นใจสูง” กับ “การลงมือปฏิบัติจริงต่ำ” ในด้านความรู้ด้านสื่อ

ในทางตรงกันข้าม ฟินแลนด์ได้บรรจุความรู้ด้านสื่อเข้าเป็นส่วนหนึ่งของหลักสูตรระดับชาติ มาเป็นเวลาหลายสิบปี แม้กระทั่งออกแบบเนื้อหาสำหรับเด็กอายุ 3 ขวบ เพื่อฝึกทักษะวิเคราะห์สื่อและแยกแยะข่าวปลอม และในยุค AI ก็พยายามบรรจุความรู้ด้าน AI เข้าสู่หลักสูตร เพื่อเสริมสร้างความสามารถในการวิเคราะห์ข้อมูลซับซ้อนของคนรุ่นใหม่

รายงานที่เกี่ยวข้อง:

เป็นแบบอย่างให้ไต้หวัน? ฟินแลนด์สอนเด็กอายุ 3 ขวบเรียนรู้การอ่านสื่อและแยกแยะข่าวปลอม รวมถึงการรู้เท่าทันข่าวปลอมจาก AI

ความท้าทายด้านความรู้ด้านสื่อของพลเมืองในยุค AI

เหตุการณ์ “สื่อไทยรายงานผิดพลาดว่าช่างภาพไต่ 101 ของฮอนนอลด์คือจิน กัวเว่ย” ทำให้ประชาชนต้องคิดถึงประเด็นสำคัญ เช่น สื่อไทยขาดจริยธรรมในการรายงานข่าว ไม่ตรวจสอบก่อนรายงานอย่างเร่งรีบ; ความรู้ด้านสื่อของประชาชนที่ยังไม่เพียงพอ ทำให้เชื่อถืออินฟลูเอนเซอร์หรือผู้มีอำนาจมากเกินไป; และแม้ AI ยังมีปัญหาภาพลวง ก็ยังมีคนเชื่อคำตอบของ AI อยู่ดี

สำหรับประชาชนทั่วไป เหตุการณ์นี้อาจเป็นบทเรียนสำคัญว่า ในอนาคต เมื่อเห็นข้อมูลจากอินฟลูเอนเซอร์ สื่อ หรือ AI ควรตั้งคำถามและตรวจสอบก่อนเชื่อทั้งหมด เพื่อหลีกเลี่ยงความเสี่ยงจากข่าวปลอม