Prof. Jia Da analysiert generative KI: Ist Vibe Coding wirklich so genial? Was ist die beste Methode, um mit KI zu programmieren?

In der heutigen Zeit des rasanten Fortschritts generativer KI fühlen sich viele Menschen unsicher, ob sie weiterhin Programmieren lernen sollten. Professor 加大 erklärt in der GQ-Zeitschrift die Prinzipien hinter ChatGPTs LLM und weist auf die Grenzen des Vibe Coding hin.

Professor 加大 analysiert generative KI und lehrt dich, Vibe Coding richtig zu verstehen

Kürzlich teilt GQ Taiwan auf seinem YouTube-Kanal ein Video, in dem Professor Sarah Chasins von der University of California, Berkeley (UC Berkeley) auf zahlreiche Fragen von Internetnutzern zu Programmierung und KI eingeht.

In einer Zeit, in der generative KI sich rasant entwickelt, sind viele unsicher, ob sie weiterhin Programmieren lernen sollen. Professor Chasins erklärt im Video nicht nur die technischen Prinzipien, sondern gibt auch eine realistische Einschätzung zum aktuellen Trend des „Vibe Coding“.

Professor erklärt die LLM-Technologie hinter ChatGPT

Professor Sarah Chasins erklärt zunächst auf verständliche Weise, wie ChatGPT funktioniert.

ChatGPT basiert auf großen Sprachmodellen (LLM). Das Kernprinzip ist ziemlich simpel: Es ist ein Programm, das Wörter, die zusammenpassen, miteinander kombiniert.

Die Entwickler der LLM sammeln zunächst alle von Menschen geschriebenen Dokumente und Webseiten im Internet. Diese Daten repräsentieren die vernünftigen Wortkombinationen im menschlichen Verständnis.

Anschließend wird das Programm in großem Maßstab mit „Lückentext“-Training trainiert. Zum Beispiel sieht das System Sätze wie „Der Hund hat vier [Leerzeichen]“, wobei die menschliche Antwort „Beine“ ist. Wenn das Programm falsch rät, wird es korrigiert, bis es richtig liegt.

Nach einem Trainingsprozess, der etwa 300 bis 400 Jahre an Rechenzeit auf der Erde entspricht, generiert das Programm schließlich eine äußerst große „Schummel-Papier“, also die sogenannten „Parameter“ in der Tech-Branche.

Danach reicht es aus, eine Dialogdatei bereitzustellen. Dieses auf Lückentext spezialisierte Programm kann dann in einen Chatbot umgewandelt werden, der automatisch die verbleibende Antwort auf menschliche Fragen ergänzt.

Bildquelle: KI-generiertes Bild von Nanobanana, nur zur Veranschaulichung. Bitte entschuldigen Sie, falls einige chinesische Zeichen unscharf sind.

Die beste Art, Programmieren im KI-Zeitalter zu lernen

Angesichts der mächtigen KI-Tools hinterfragen viele die Notwendigkeit, Programmieren zu lernen. Professor ist der Meinung, dass die wichtigste Fähigkeit im Programmierunterricht darin besteht, „Probleme zu zerlegen“, also ein vages großes Problem in kleinere Teile zu zerlegen, bis jeder Teil mit wenigen Zeilen Code gelöst werden kann.

Ohne diese Übung wird es für Nutzer schwierig, komplexe Programme zu erstellen, die tatsächlich funktionieren, wenn sie KI-Tools verwenden. Zudem basiert das Training der LLM auf technischen Sprachbeschreibungen, die oft nicht der Alltagssprache von Laien entsprechen. Das führt dazu, dass KI keine nützlichen Codes generieren kann.

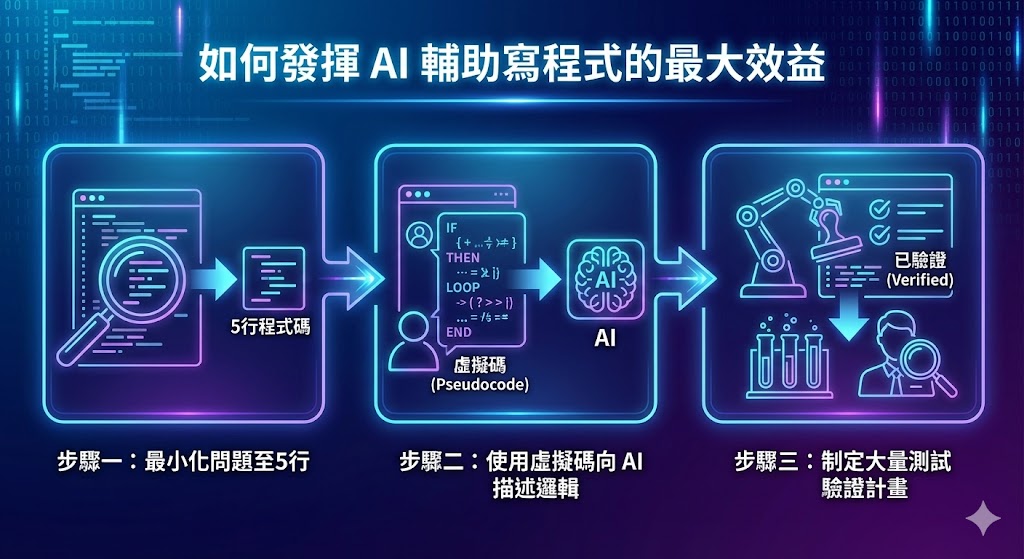

Um das maximale Potenzial von KI beim Programmieren zu nutzen, empfiehlt Professor Chasins drei Schritte:

- Problem minimieren: Das Problem auf etwa 5 Zeilen Code reduzieren.

- Pseudocode verwenden: Eine Art Beschreibung der Logik, die verschiedene Programmiersprachen und Schlüsselwörter kombiniert, um die Logik an die KI zu übermitteln. Obwohl Pseudocode wie natürliche Sprache wirkt, ist es keine Alltagssprache, sondern soll die Maschine präziser verstehen lassen.

- Validierungsplan erstellen: Durch umfangreiche Tests oder professionelle Überprüfungen die Richtigkeit der KI-Ausgaben sicherstellen.

Bildquelle: KI-generiertes Bild von Nanobanana, nur zur Veranschaulichung. Bitte entschuldigen Sie, falls einige chinesische Zeichen unscharf sind.

Vibe Coding ist nicht so magisch?

Bezüglich des aktuellen Trends, LLMs direkt Code generieren zu lassen, anstatt ihn manuell zu schreiben, bleibt Professor Sarah Chasins skeptisch.

Sie analysiert, dass diese Tools bei der Verarbeitung routinemäßiger Inhalte, die bereits tausendfach von Menschen geschrieben wurden, gut funktionieren. Für innovative Projekte sind sie jedoch meist ungeeignet.

Der Professor verweist auf Studien, die zeigen, dass Nutzer von LLM-Tools zwar behaupten, ihre Effizienz um 20 % gesteigert zu haben, tatsächlich aber die Entwicklungszeit im Vergleich zu Nicht-Nutzern um 20 % langsamer ist.

Dies zeigt, dass eine zu starke Abhängigkeit von Tools eine Effizienzillusion erzeugen kann. Wenn man auf noch nie dagewesene Programmieranforderungen stößt, fehlt es an grundlegender Logikzerlegung und physikalischem Verständnis, um Fehler der KI zu korrigieren, was letztlich zu längeren Entwicklungszeiten führt.

Ein einfaches Beispiel: LLM ist wie ein hochentwickeltes autonomes Fahrzeug, das bei bekannten Routen hilft. Wenn man jedoch die Strecke nicht zerlegen oder die physikalischen Prinzipien des Fahrzeugs nicht versteht – ähnlich wie bei Programmierlogik – und auf unbekannte, schwierige Kurven stößt, ist das autonome Fahrzeug anfällig für Fehler. Ohne Grundkenntnisse weiß man dann nicht, wie man es korrigiert.

Weiterführende Lektüre:

KI lässt Ein-Personen-Unternehmen aufsteigen! „Atmosphärisches Coding“ revolutioniert die Branche, kleine Teams können jährlich über 100 Millionen verdienen

Verwandte Artikel

Dogecoin-Gründer fragt sich, ob Krypto zurück ist - U.Today

Dogecoin-Preis steigt auf 0,10 US-Dollar zurück, Wale häufen kumulativ 470 Millionen DOGE an

Memecoin: DOGE, SHIB, PEPE schnellen in die Höhe, während der Aufwärtstrend gestärkt wird

Bitdeer startet SEALMINER DL1 Air zum Schürfen von Litecoin und Dogecoin, Aktie steigt um 9%

Dogecoin Futures-Daten zeigen $0 Short Liquidationen während Reset